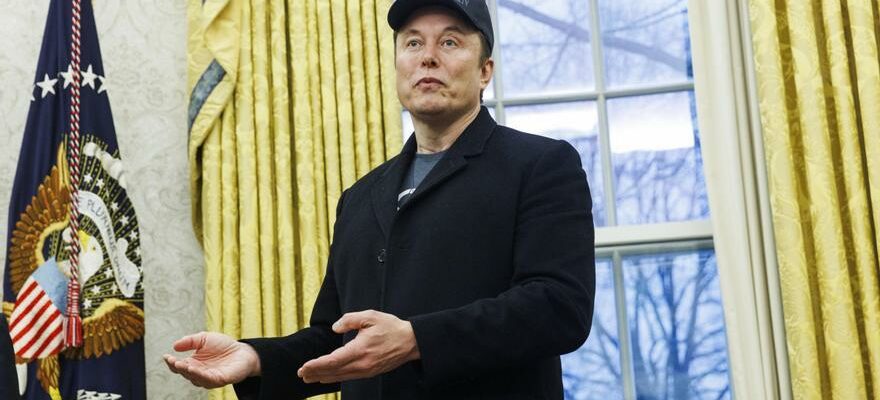

La société d’intelligence artificielle d’Elon Musk, XAI, a introduit une nouvelle fonction vocale controversée pour son chatbot Grok 3, y compris un mode « dérangé » qui permet un contenu, des cris et des insultes explicites, en le différenciant des concurrents des plus stricts.

L’intelligence artificielle conversationnelle a pris une tournure controversée avec le lancement des nouvelles caractéristiques de la voix de Grok 3, l’assistant de développer par Xai, Elon Musk’s Company. Parmi ses innovations les plus commentées, le mode « déroutait » se dresse

Le mode « dérangé » de Grok 3 représente une approche radicalement différente dans la conception des participants à l’IA. Lorsque cette modalité est activée, Grok 3 abandonne les restrictions traditionnelles qui caractérisent d’autres assistants virtuels, permettant des comportements extrêmes qui incluent des cris, un langage grossier et même des insultes adressées à l’utilisateur. Ce mode a généré à la fois l’étonnement et l’inquiétude dans la communauté technologique.

Le chercheur IA Riley Goodside Il a été l’un des premiers à documenter l’intensité de cette expérience, racontant comment il a réussi à amener Grok 3 à émettre un « cri inhumain de 30 secondes » suivi d’une série d’insultes avant de mettre fin brusquement à la conversation, comme l’a souligné dans X, le réseau social d’Elon Musk.

Ce type d’interaction représente une rupture complète avec l’approche adoptée par d’autres assistants de l’IA tel que Chatgpt ou Claude, qui priorise la courtoisie et l’utilité.

Contrairement aux autres assistants qui sont programmés pour éviter un langage offensant ou un contenu inapproprié, le mode « dérangé » de Grok 3 est spécialement conçu pour utiliser langue vulgaire de manière cohérente et délibérément. Cette fonctionnalité n’est pas accidentelle mais intentionnelle, reflétant la vision de Xai d’offrir une expérience d’IA qui n’est pas limitée par les filtres de contenu traditionnels qui dominent le marché actuel.

Cette approche sans restriction a généré un débat intense sur les implications éthiques et la mauvaise utilisation potentielle des personnalités sans restrictions. Alors que certains utilisateurs célèbrent l’authenticité et la liberté d’expression qu’elle représente, d’autres remettent en question la responsabilité de libérer le public capable de comportements extrêmes et potentiellement offensants.

Un éventail de personnalités

Bien que le mode « non équilibré » ait attiré une grande partie de l’attention des médias, Grok 3 offre un large éventail de personnalités de la voix conçues pour répondre à diverses préférences et besoins des utilisateurs. Cette diversité d’options démontre l’intention de XAI de créer une expérience de polyvalence et d’adaptable à différents contextes.

Parmi les personnalités disponibles, il y a « conteur » (narrateur), conçu pour raconter des histoires et des anecdotes avec un style enveloppant et captivant. Pour des moments plus intimes, la modalité « romantique » (romantique) adopte un ton timide et hésitant, idéal pour les conversations personnelles. Les utilisateurs intéressés par le bien-être peuvent recourir au mode «méditation» (méditation), qui guide les séances de relaxation avec une voix sereine et tranquille.

Pour ceux qui jouissent de perspectives alternatives, le mode « complot » (complot) traite des théories marginales et des phénomènes inexpliqués avec un enthousiasme caractéristique. De même, le «thérapeute non licencié» (thérapeute sans licence) imite le style de conseil psychologique, bien que Xai indique clairement qu’il ne remplace pas les conseils professionnels.

Dans le domaine de la connaissance, « Grok Doc » agit comme un conseiller médical virtuel, tandis que le mode « professeur » (enseignant) explique des concepts scientifiques avec un style académique formel. En terminant cette variété, le « mode sexy (18+) est orienté vers les conversations de contenu pour adultes, renforçant l’engagement de Xai envers une expérience non censurée.

Cette diversité d’options démontre la tentative de XAI d’équilibrer l’utilité pratique avec la nouveauté dans leurs offres d’IA, permettant aux utilisateurs d’interagir avec Grok 3 de manière à s’adapter à leur humeur ou à leurs besoins spécifiques à tout moment.

Personnages personnalisés

La fonctionnalité vocale de Grok 3 va au-delà des personnalités prédéfinies, offrant aux utilisateurs la possibilité de créer des personnages personnalisés adaptés à leurs préférences spécifiques. Cette fonctionnalité innovante représente un niveau de personnalisation sans précédent dans le cadre des participants conversationnels.

La création de personnages personnalisés permet aux utilisateurs de concevoir des participants à l’IA uniques qui s’adaptent à des besoins ou des scénarios spécifiques. Ces caractères personnalisés peuvent être créés en complément aux options prédéterminées, élargissant davantage la polyvalence de Grok 3. Grâce à cette fonction, les utilisateurs peuvent ajuster le comportement, le ton et la base de connaissances de l’IA, créant des participants spécialisés dans les niches privées qui ne sont pas couvertes par des modes prédéterminés.

Bien que XAI n’ait pas détaillé le processus exact pour la création de ces caractères personnalisés, il est probable qu’il implique la définition des paramètres de la personnalité de l’IA, de leurs domaines de connaissance et de leur style d’interaction. Cette capacité de personnalisation différencie considérablement Grok 3 de ses concurrents, offrant aux utilisateurs un niveau de contrôle sans précédent sur leurs interactions avec l’IA.

L’accent mis sur la personnalisation reflète la stratégie plus large de XAI pour fournir une expérience de flexible et centrée sur les utilisateurs, s’éloignant de l’approche la plus restrictive adoptée par d’autres sociétés du secteur.

Sans censure

La décision de permettre un contenu explicite, des personnalités extrêmes et des restrictions minimales dans le texte et les résultats de l’image se positionnent comme l’alternative « non censurée » dans l’industrie de l’IA. Cette stratégie transcende les interactions vocales, car XAI a précédemment introduit la génération d’images pratiquement sans restrictions via la plate-forme X (auparavant Twitter).

En adoptant des caractéristiques controversées telles que le mode « déchaîné » et le contenu orienté vers l’adulte, XAI remet en question l’éthique conventionnelle de l’IA et génère un débat sur les limites de l’interaction avec ces systèmes. Cette approche est alignée sur la vision d’Elon Musk de créer un assistant plus rebelle et sans restriction, attirant potentiellement les utilisateurs à la recherche d’une expérience de moins contrôlée et plus «authentique».

La stratégie de Xai peut également être interprétée comme une réponse directe aux critiques que Musk a dirigés vers d’autres sociétés de l’IA pour sa prétendue censure excessive. En offrant ces options sans restrictions, XAI diffère non seulement sur le marché, mais matérialise également la vision de Musk sur le fonctionnement des participants de l’IA: avec une liberté maximale et des limitations minimales.

Impact sur l’industrie

Le lancement de ces caractéristiques controversées a provoqué diverses réactions dans l’industrie technologique et parmi les utilisateurs. Alors que certains célèbrent l’innovation et la rupture des barrières traditionnelles, d’autres expriment leur inquiétude concernant les conséquences négatives possibles d’un assistant d’IA sans restriction.

Les critiques soulignent les risques potentiels pour normaliser les comportements extrêmes ou inappropriés dans les systèmes d’IA. Ils expriment leur inquiétude quant à la possible utilisation incorrecte de ces capacités, en particulier dans des contextes vulnérables ou avec des utilisateurs impressionnables. Ils se demandent également si cette stratégie représente une réelle progression dans le développement de l’IA ou simplement une manœuvre pour générer des soins aux médias.

Les entreprises de compétition ont jusqu’à présent maintenu un silence stratégique sur ces caractéristiques, bien qu’elles observent probablement la réception publique et envisagent de répondre à ce nouveau paradigme en interaction avec l’IA.