Hollywood könnte darin verwickelt sein in laufenden Arbeitskonflikten, bei denen es um KI geht, aber die Technologie hat Film und Fernsehen schon vor langer, langer Zeit infiltriert. Bei SIGGRAPH In LA wurden algorithmische und generative Werkzeuge in unzähligen Vorträgen und Ankündigungen gezeigt. Wir wissen vielleicht noch nicht, wo Dinge wie GPT-4 und Stable Diffusion hineinpassen, aber die kreative Seite der Produktion ist bereit, sie anzunehmen – Wenn Dies kann auf eine Art und Weise erfolgen, die Künstler eher fördert als ersetzt.

SIGGRAPH ist keine Film- und Fernsehproduktionskonferenz, sondern eine über Computergrafik und visuelle Effekte (seit nunmehr 50 Jahren!), und die Themen überschneiden sich in den letzten Jahren naturgemäß immer mehr.

Der Elefant im Raum war in diesem Jahr der Streik, und es gab nur wenige Präsentationen oder Vorträge; Bei Afterpartys und Networking-Veranstaltungen war es jedoch mehr oder weniger das erste, was jemand zur Sprache brachte. Trotzdem ist die SIGGRAPH vor allem eine Konferenz, bei der es darum geht, technische und kreative Köpfe zusammenzubringen, und die Stimmung, die ich bekam, war: „Es ist scheiße, aber in der Zwischenzeit können wir unser Handwerk weiter verbessern.“

Die Befürchtungen rund um KI in der Produktion sind zwar nicht illusorisch, aber sicherlich etwas irreführend. Generative KI wie Bild- und Textmodelle haben sich stark verbessert, was zu der Sorge führt, dass sie Schriftsteller und Künstler ersetzen werden. Und sicherlich haben Studiomanager schädliche – und unrealistische – Hoffnungen geäußert, Autoren und Schauspieler teilweise durch KI-Tools zu ersetzen. Aber KI ist in Film und Fernsehen schon seit geraumer Zeit präsent und übernimmt wichtige und von Künstlern vorangetriebene Aufgaben.

Das habe ich in zahlreichen Panels, Fachvorträgen und Interviews deutlich gesehen. Natürlich wäre eine Geschichte der KI in VFX interessant, aber hier sind vorerst einige Möglichkeiten, wie KI in ihren verschiedenen Formen auf dem neuesten Stand der Effekte und Produktionsarbeit gezeigt wurde.

Die Künstler von Pixar nutzen ML und Simulationen

Ein frühes Beispiel waren zwei Pixar-Präsentationen über Animationstechniken, die in ihrem neuesten Film Elemental verwendet wurden. Die Charaktere in diesem Film sind abstrakter als andere, und die Aussicht, eine Person zu erschaffen, die aus Feuer, Wasser oder Luft besteht, ist keine leichte Aufgabe. Stellen Sie sich vor, Sie würden die fraktale Komplexität dieser Substanzen in einen Körper verwandeln, der klar agieren und sich ausdrücken kann und dennoch „echt“ aussieht.

Wie Animatoren und Effektkoordinatoren nacheinander erklärten, war die prozedurale Generierung der Kern des Prozesses, bei der die Flammen, Wellen oder Dämpfe simuliert und parametrisiert wurden, aus denen Dutzende von Charakteren bestanden. Das manuelle Formen und Animieren jedes kleinen Flammen- oder Wolkenhaufens, der von einer Figur ausgeht, war nie eine Option – das wäre äußerst mühsam, arbeitsintensiv und eher technisch als kreativ.

Aber wie die Präsentationen deutlich machten, waren das künstlerische Team und der Prozess eng mit der technischen Seite verflochten, obwohl sie sich stark auf Simulationen und ausgefeilte Material-Shader stützten, um die gewünschten Effekte zu erzielen. (Zu diesem Zweck arbeiteten sie auch mit Forschern der ETH Zürich zusammen.)

Ein Beispiel war das Gesamtbild einer der Hauptfiguren, Ember, die aus Flammen besteht. Es reichte nicht aus, Flammen zu simulieren oder die Farben zu optimieren oder die vielen Regler anzupassen, um das Ergebnis zu beeinflussen. Letztendlich mussten die Flammen das vom Künstler gewünschte Aussehen widerspiegeln und nicht nur die Art und Weise, wie Flammen im wirklichen Leben erscheinen. Zu diesem Zweck verwendeten sie den „volumetrischen neuronalen Stiltransfer“ oder NST; Stilübertragung ist eine Technik des maschinellen Lernens, die die meisten bereits kennengelernt haben, indem sie beispielsweise ein Selfie in den Stil von Edvard Munch oder Ähnlichem verwandelt haben.

In diesem Fall nahm das Team die Rohvoxel der „Pyro-Simulation“ oder erzeugten Flammen und leitete sie durch ein Stilübertragungsnetzwerk, das auf dem Ausdruck eines Künstlers trainiert wurde, der zeigte, wie die Flammen der Figur aussehen sollten: stilisierter, weniger simuliert. Die resultierenden Voxel haben das natürliche, unvorhersehbare Aussehen einer Simulation, aber auch die unverwechselbare Besetzung der Wahl des Künstlers.

Vereinfachtes Beispiel von NST in Aktion, das den Flammen von Ember Stil verleiht. Bildnachweis: Pixar

Natürlich reagieren die Animatoren sensibel auf die Vorstellung, dass sie den Film lediglich mithilfe von KI erstellt haben, was nicht der Fall ist.

„Wenn Ihnen jemals jemand sagt, dass Pixar KI verwendet hat, um Elemental zu erschaffen, dann ist das falsch“, sagte Paul Kanyuk von Pixar während der Präsentation deutlich. „Wir haben volumetrisches NST verwendet, um ihre Silhouettenkanten zu formen.“

(Um es klar auszudrücken: NST ist eine Technik des maschinellen Lernens, die wir als unter den Begriff KI fallend bezeichnen würden, aber Kanyuk wollte damit sagen, dass es als Werkzeug zur Erzielung eines künstlerischen Ergebnisses verwendet wurde – nichts wurde einfach „mit KI gemacht“.) )

Später erklärten andere Mitglieder des Animations- und Designteams, wie sie prozedurale, generative oder Stilübertragungswerkzeuge verwendeten, um beispielsweise eine Landschaft neu einzufärben, um sie an die Palette oder das Moodboard eines Künstlers anzupassen, oder Stadtblöcke mit einzigartigen, aus „Helden“ mutierten Gebäuden zu füllen. handgezeichnete. Das klare Thema war, dass KI und KI-nahe Tools dazu da waren, den Zwecken der Künstler zu dienen, mühsame manuelle Prozesse zu beschleunigen und eine bessere Übereinstimmung mit dem gewünschten Look zu ermöglichen.

KI beschleunigt den Dialog

Bilder von Nimona, die DNEG animiert hat. Bildnachweis: DNEG

Eine ähnliche Bemerkung habe ich zuletzt von Martine Bertrand gehört, leitende KI-Forscherin bei DNEG, dem VFX- und Postproduktionsunternehmen animierte die hervorragende und visuell atemberaubende Nimona. Er erklärte, dass viele bestehende Effekte und Produktionspipelines unglaublich arbeitsintensiv seien, insbesondere die Look-Entwicklung und das Umgebungsdesign. (DNEG hielt auch eine Präsentation, „Wo Prozeduralismus auf Leistung trifft“ das diese Themen berührt.)

„Den Leuten ist nicht bewusst, dass der Erstellungsprozess enorm viel Zeit verschwendet“, sagte mir Bertrand. Die Zusammenarbeit mit einem Regisseur, um den richtigen Look für eine Aufnahme zu finden, kann Wochen pro Versuch dauern, wobei unregelmäßige oder schlechte Kommunikation oft dazu führt, dass diese Wochen der Arbeit zunichte gemacht werden. Es sei unglaublich frustrierend, fuhr er fort, und KI sei eine großartige Möglichkeit, diesen und andere Prozesse zu beschleunigen, bei denen es sich bei weitem nicht um Endprodukte, sondern lediglich um explorative und allgemeine Prozesse handelt.

Künstler, die KI nutzen, um ihre Bemühungen zu vervielfachen, „ermöglichen den Dialog zwischen Schöpfern und Regisseuren“, sagte er. Sicherlich ein Alien-Dschungel – aber so? Oder so Das? So eine geheimnisvolle Höhle? Oder so Das? Für eine vom Autor geleitete, visuell komplexe Geschichte wie Nimona ist es besonders wichtig, schnelles Feedback zu erhalten. Eine Woche damit zu verschwenden, einen Look darzustellen, den der Regisseur eine Woche später ablehnt, ist eine ernsthafte Produktionsverzögerung.

Tatsächlich werden in frühen kreativen Arbeiten wie der Vorvisualisierung neue Ebenen der Zusammenarbeit und Interaktivität erreicht Ein Vortrag von Sokrispy-CEO Sam Wickert erklärt. Seine Firma wurde mit der Vorabaufnahme der Ausbruchsszene zu Beginn der HBO-Serie „The Last of Us“ beauftragt – einem komplexen „Oner“ in einem Auto mit unzähligen Extras, Kamerabewegungen und Effekten.

Während der Einsatz von KI in dieser eher bodenständigen Szene begrenzt war, ist es leicht zu erkennen, wie verbesserte Sprachsynthese, prozedurale Umgebungsgenerierung und andere Tools zu diesem zunehmend technologieorientierten Prozess beitragen konnten und auch tatsächlich dazu beigetragen haben.

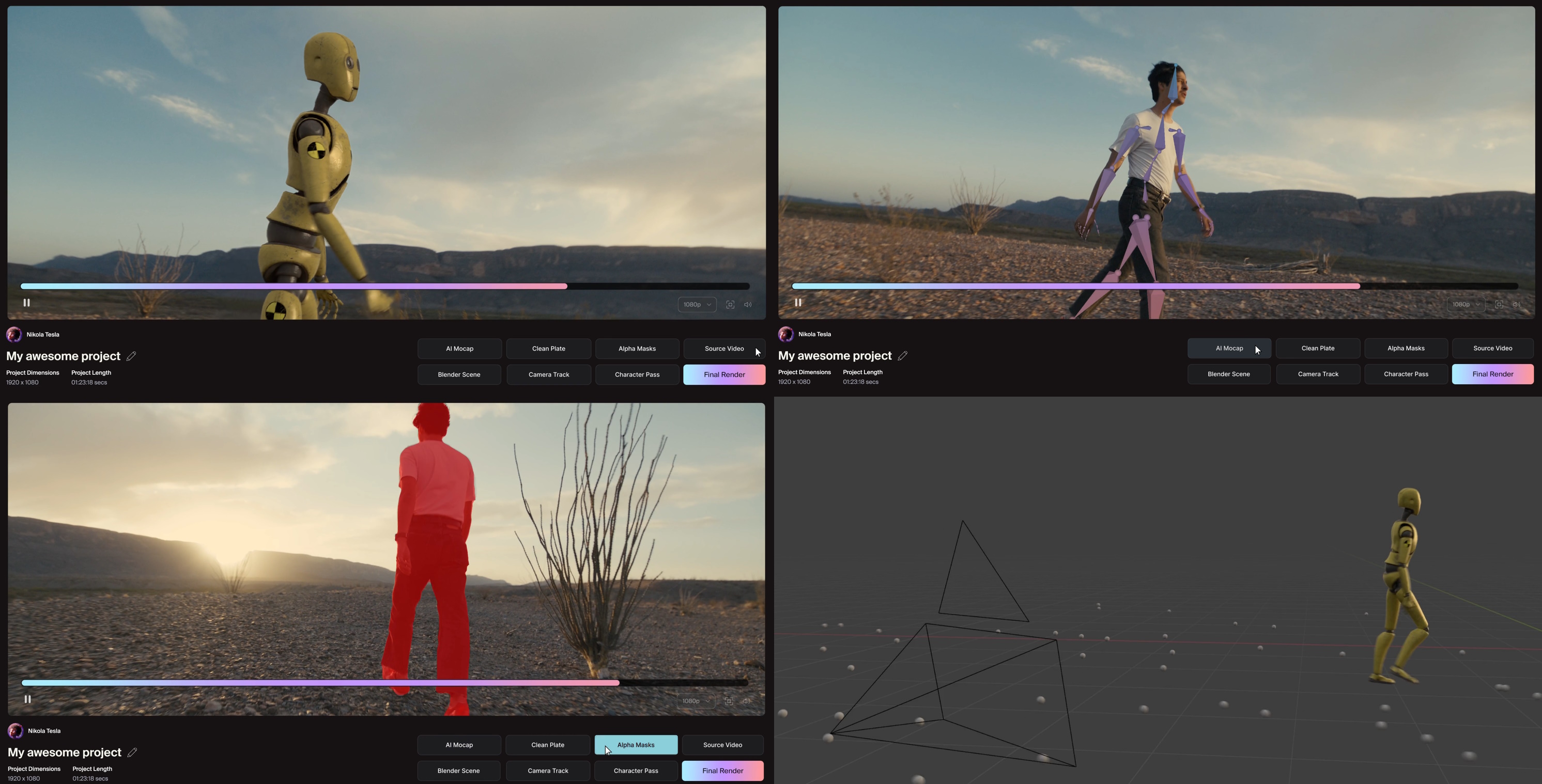

Endgültige Aufnahme, Mocap-Daten, Maske und 3D-Umgebung, generiert von Wonder Studio. Bildnachweis: Wonder Studio

Wonder Dynamics, das in mehreren Keynotes und Präsentationen zitiert wurde, bietet ein weiteres Beispiel für den Einsatz maschineller Lernprozesse in der Produktion – vollständig unter der Kontrolle der Künstler. Fortschrittliche Szenen- und Objekterkennungsmodelle analysieren normales Filmmaterial und ersetzen menschliche Schauspieler sofort durch 3D-Modelle, ein Prozess, der früher Wochen oder Monate dauerte.

Aber wie sie mir vor ein paar Monaten sagten, handelt es sich bei den Aufgaben, die sie automatisieren, nicht um kreative Aufgaben – es handelt sich um zermürbende Routinearbeit (manchmal auch Roto-Arbeit), die fast keine kreativen Entscheidungen erfordert. „Das stört nicht, was sie tun; Es automatisiert 80–90 % der objektiven VFX-Arbeit und überlässt ihnen die subjektive Arbeit“, sagte Mitbegründer Nikola Todorovic damals. Ich traf ihn und seinen Mitbegründer, den Schauspieler Tye Sheridan bei SIGGRAPH, und sie genossen es, der Star der Stadt zu sein: Es war klar, dass sich die Branche in die Richtung bewegte, in die sie vor Jahren begonnen hatte. (Besuchen Sie Sheridan übrigens im September auf der KI-Bühne bei Tech Disrupt.)

Dennoch werden die Warnungen der streikenden Autoren und Schauspieler von der VFX-Community keineswegs zurückgewiesen. Sie spiegeln sie tatsächlich wider, und ihre Sorgen sind ähnlich – wenn auch nicht ganz so existenziell. Für einen Schauspieler ist das eigene Abbild oder seine Leistung (oder für einen Schriftsteller die eigene Vorstellungskraft und Stimme) der Lebensunterhalt, und die Gefahr, dass es angeeignet und vollständig automatisiert wird, ist erschreckend.

Auch für Künstler an anderen Stellen im Produktionsprozess ist die Gefahr der Automatisierung real, und zwar eher ein menschliches als ein technologisches Problem. Viele Menschen, mit denen ich gesprochen habe, waren sich einig, dass Fehlentscheidungen uninformierter Führungskräfte das eigentliche Problem sind.

„KI scheint so intelligent zu sein, dass man die Entscheidungsfindung vielleicht der Maschine überlassen könnte“, sagte Bertrand. „Und wenn Menschen ihre Verantwortung den Maschinen überlassen, das ist wo es gruselig wird.“

Wenn KI genutzt werden kann, um den kreativen Prozess zu verbessern oder zu rationalisieren, indem beispielsweise der Zeitaufwand für sich wiederholende Aufgaben reduziert wird oder Kreative mit kleineren Teams oder Budgets in die Lage versetzt werden, mit ihren besser ausgestatteten Kollegen mitzuhalten, könnte dies einen Wandel bewirken. Aber wenn der kreative Prozess der KI untergeordnet wird – ein Weg, den einige Führungskräfte offenbar gerne beschreiten –, dann werden die Streiks trotz der Technologie, die Hollywood bereits durchdringt, gerade erst beginnen.