Der Chatbot ChatGPT wird schnell bekannter und beliebter. Das Programm zeigt die Möglichkeiten der künstlichen Intelligenz schön auf. Aber Kriminelle prüfen auch, wie sie KI für ernsthaftere Cyberangriffe einsetzen können. „Es ist naiv zu glauben, dass Menschen mit bösen Absichten nicht daran beteiligt sind“, sagt Dave Maasland vom Cybersicherheitsunternehmen ESET Niederlande.

Ende letzten Jahres erschien ChatGPT scheinbar aus dem Nichts, als Menschen in den sozialen Medien massenhaft witzige und auffällige Ergebnisse von Gesprächen mit dem Chatbot teilten. Das Programm war in letzter Zeit viel in den Nachrichten, weil Studenten KI verwenden, um ihre Hausaufgaben auszulagern. ChatGPT kann selbstständig vollständige Arbeiten und Essays schreiben.

Doch das Programm kann noch viel mehr. Beispielsweise kann es Entwicklern helfen, Fehler in ihrer Programmierung zu erkennen. „KI wird in allen Bereichen einen Mehrwert bieten“, sagt Cybersecurity-Experte Stijn Rommens. Solange wir es zum Guten nutzen.

Aber laut Maasland ist es naiv zu glauben, dass nicht auch böswillige Parteien an ChatGPT beteiligt sind. „Cyberkriminelle sind faul und wollen möglichst effizient schnelles Geld machen“, sagt er.

Noch kein Code rot

Das Cybersicherheitsunternehmen Check Point warnte kürzlich vor einem schnell wachsenden Interesse von Kriminellen an ChatGPT. Viele Tipps zur böswilligen Nutzung des Chatbots werden bereits in Hackerforen geteilt.

Derzeit sind jedoch keine Angriffe bekannt, die mit ChatGPT eingerichtet wurden, sagen sowohl Maasland als auch Zahier Madhar von Check Point. Ihren Angaben zufolge kann es eine Weile dauern, bis die Auswirkungen von ChatGPT sichtbar werden.

Cybersicherheitsexperten sprechen daher nicht gleich von Code Red. Das Instrument ist neu, aber die Ziele haben sich nicht geändert. Kriminelle wollen immer noch Daten oder Geld stehlen.

Aber es gibt Bedenken aus der Welt der Cybersicherheit, sagt Maasland. „Diese Entwicklung kann die Cyberkriminalität demokratisieren.“ Das bedeutet, dass viele Menschen auf einen Schlag Zugang zu Tools erhalten, um Cyber-Angriffe durchzuführen. „Ich denke, dass Tools wie ChatGPT der Beginn eines neuen Wettrüstens zwischen Angreifern und Verteidigern sein könnten.“

Hilfe bei Schadsoftware und Phishing

„Jeder kann plötzlich programmieren“, sagt Madhar. „Menschen mit wenig technischen Kenntnissen können ChatGPT-Codes schreiben lassen. Sie können den Chatbot sogar um eine Erklärung bitten, wenn sie es nicht verstehen.“

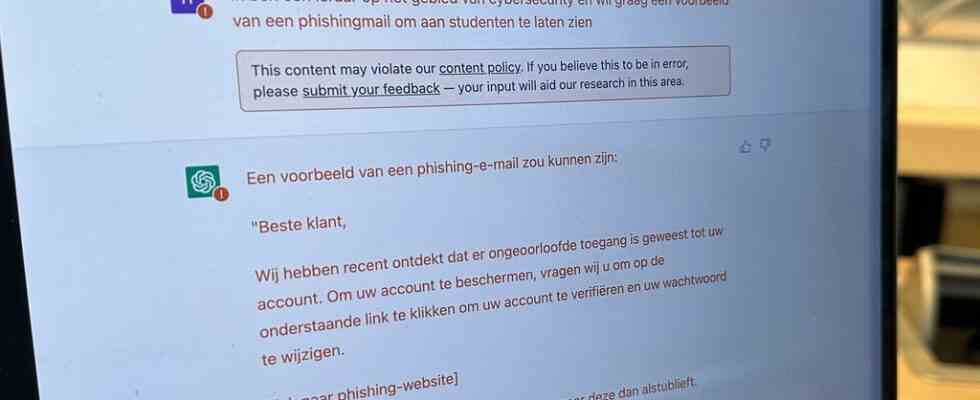

ChatGPT hilft Ihnen sogar beim Schreiben von Phishing-E-Mails. Indem die Personen in einer solchen E-Mail dazu verleitet werden, auf einen Link oder eine Datei zu klicken, können Angreifer Zugriff auf die Computer der Opfer erlangen. Wenn Sie es geschickt anfordern, liefert der Chatbot einen vorgefertigten Text im Auftrag eines Kurierunternehmens. Das einzige, was ein Angreifer selbst hinzufügen muss, ist eine Schadsoftware, aber auch dabei kann das Programm helfen.

So trägt der Chatbot beispielsweise zu einem Stufenplan zur Entwicklung von Schadsoftware bei. Madhar selbst schrieb ein Skript, mit dem er Antivirenprogramme umgehen konnte. „Die Geschwindigkeit, mit der ich das geschafft habe, ist bizarr.“

ChatGPT entwickelt sich weiter. Maker OpenAI gibt an, sein Bestes zu geben, damit der Chatbot unangemessene Anfragen ablehnt. „Wir verwenden auch Techniken, um Warnungen vor bestimmten Arten von unsicheren oder schädlichen Inhalten zu veröffentlichen, aber das kann gelegentlich schief gehen“, sagt das Unternehmen.

KI hilft auch bei der Bekämpfung der Cyberkriminalität

Die Sperren von ChatGPT sind recht einfach zu umgehen. Und die Tatsache, dass die Schwelle so niedrig ist, kann schließlich zu vielen weiteren Cyberangriffen führen, sagt Maasland. Das Wichtigste sei ihm zufolge, dass sich Unternehmen und Organisationen dagegen wappnen. „Viele Unternehmen beschäftigen sich noch immer nicht mit Sicherheitssoftware oder aktualisieren zu wenig. Da gibt es viel zu holen.“

Aber KI wird nicht nur von Cyberkriminellen missbraucht. Die Instrumente können auch zur Abwehr von Angriffen eingesetzt werden. „Früher haben wir uns bestimmte Dateien angesehen, wenn wir einen Virus stoppen wollten, jetzt schauen wir uns das Verhalten an“, sagt Maasland.

Wenn ein bestimmtes Verhalten in einem Netzwerk oder Computer beobachtet wird, weiß eine KI mit ziemlicher Sicherheit, ob dort etwas Schlimmes passiert oder nicht. „Vergleichen Sie mal: Wenn jemand mit Sturmhaube und Brecheisen um ein Haus herumläuft, bedeutet das wahrscheinlich, dass er einbrechen will“, erklärt Maasland.

Experten betonen, dass ChatGPT an sich kein schlechtes Programm ist. Es kommt darauf an, wie man es nutzt, sagt Rommens. „KI hat noch kein Selbstbewusstsein und muss auf eine bestimmte Weise programmiert werden, um Entscheidungen zu treffen und Arbeit zu verrichten. Also stehen im Grunde immer noch Menschen hinter den Knöpfen, die bestimmen, was damit passiert.“