Es ist ein Wunder, was generative KI leisten kann, insbesondere Text-zu-Bild-KI-Modelle wie Midjourney und DALL-E 3 von OpenAI. Vom Fotorealismus bis zum Kubismus können bildgenerierende Modelle praktisch jede kurze oder detaillierte Beschreibung in Kunst übersetzen, die durchaus aus der Staffelei eines Künstlers entstanden sein könnte.

Das Problem ist, dass viele dieser Modelle – wenn nicht die meisten – ohne Wissen oder Erlaubnis des Künstlers an Kunstwerken geschult wurden. Und während einige Anbieter damit begonnen haben, Künstler zu entschädigen oder Möglichkeiten anzubieten, sich von der Modelausbildung abzumelden, haben viele dies nicht getan.

Anstelle der Anleitung von Gerichten und Kongress veröffentlichen Unternehmer und Aktivisten Tools, die es Künstlern ermöglichen sollen, ihre Kunstwerke so zu modifizieren, dass sie nicht für das Training von GenAI-Modellen verwendet werden können. Ein solches Tool, Nightshade, das diese Woche veröffentlicht wurde, nimmt subtile Änderungen an den Pixeln eines Bildes vor, um Modellen vorzutäuschen, dass das Bild etwas anderes darstellt, als es tatsächlich ist. Ein anderer, Kin.artnutzt Bildsegmentierung (d. h. das Verbergen von Teilen eines Kunstwerks) und Tag-Randomisierung (Austauschen eines Kunstwerks). Bild-Metatags), um den Modelltrainingsprozess zu stören.

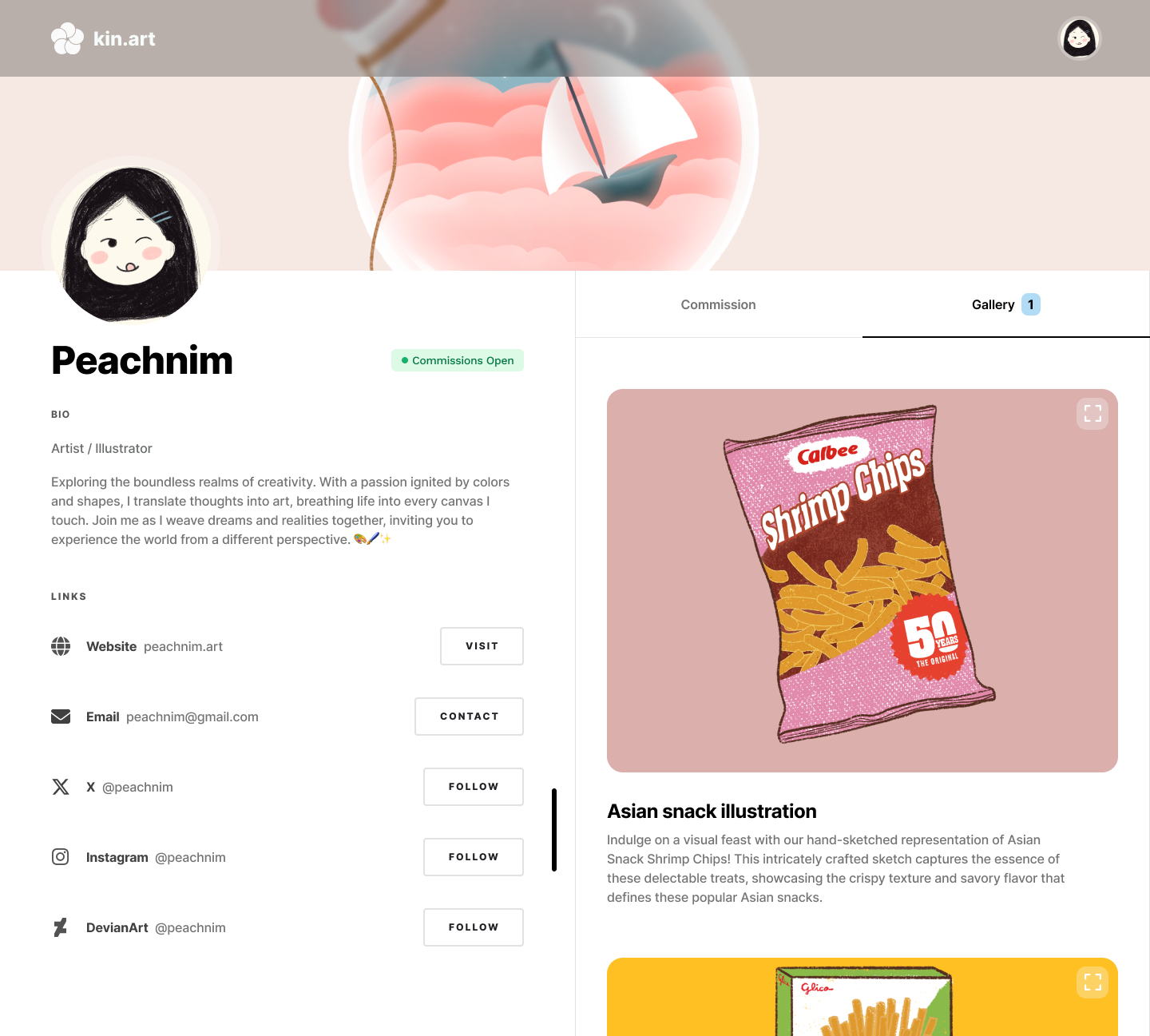

Das heute eingeführte Tool von Kin.art wurde von Flor Ronsmans De Vry mitentwickelt, der vor einigen Monaten zusammen mit Mai Akiyoshi und Ben Yu Kin.art, eine Plattform zur Verwaltung von Kunstaufträgen, mitbegründete.

Wie Ronsmans De Vry in einem Interview erklärte, sind es kunstgenerierende Modelle Anhand von Datensätzen beschrifteter Bilder trainiert, um die Assoziationen zwischen geschriebenen Konzepten und Bildern zu lernen, beispielsweise wie sich das Wort „Vogel“ nicht nur auf Drosseln, sondern auch auf Sittiche und Weißkopfseeadler beziehen kann (zusätzlich zu abstrakteren Begriffen). Durch die „Störung“ entweder des Bildes oder der Etiketten, die mit einem bestimmten Kunstwerk verbunden sind, wird es für Anbieter umso schwieriger, das Kunstwerk für die Modellschulung zu verwenden, sagt er.

Ein Künstlerprofil auf Kin.art. Bildnachweis: Kin.art

„Die Gestaltung einer Landschaft, in der traditionelle Kunst und generative Kunst nebeneinander existieren können, ist zu einer der größten Herausforderungen für die Kunstbranche geworden“, sagte Ronsmans De Vry per E-Mail gegenüber Tech. „Wir glauben, dass dies mit einem ethischen Ansatz für die KI-Ausbildung beginnt, bei dem die Rechte von Künstlern respektiert werden.“

Ronsmans De Vry behauptet, dass das Training-Defeating-Tool von Kin.art bestehenden Lösungen in mancher Hinsicht überlegen sei, da es keine kryptografisch veränderten Bilder erfordere, was teuer sein könne. Es könne aber auch als zusätzlicher Schutz mit diesen Methoden kombiniert werden, fügt er hinzu.

Die modellzerstörende Segmentierungsmethode von Kin.art. Bildnachweis: Kin.art

„Andere Tools zum Schutz vor KI-Training versuchen, den Schaden zu mindern, nachdem Ihr Kunstwerk bereits durch Vergiftung in den Datensatz aufgenommen wurde“, sagte Ronsmans De Vry. „Wir verhindern, dass Ihr Kunstwerk überhaupt eingefügt wird.“

Jetzt hat Kin.art ein Produkt zu verkaufen. Obwohl das Tool kostenlos ist, müssen Künstler ihre Kunstwerke auf die Portfolio-Plattform von Kin.art hochladen, um es nutzen zu können. Die Idee besteht derzeit zweifellos darin, dass das Tool Künstlern Zugang zu Kin.arts Angebot an kostenpflichtigen Kunstauftragsvermittlungs- und -vermittlungsdiensten, seinem Kerngeschäft, verschaffen wird.

Aber Ronsmans De Vry positioniert die Bemühungen als überwiegend philanthropisch und verspricht, dass Kin.art das Tool in Zukunft Dritten zur Verfügung stellen wird.

„Nachdem wir unsere Lösung auf unserer eigenen Plattform kampferprobt haben, planen wir, sie als Service anzubieten, damit jede kleine Website und große Plattform ihre Daten problemlos vor unlizenzierter Nutzung schützen kann“, sagte er. „Im Zeitalter der KI ist es wichtiger denn je, die Daten Ihrer Plattform zu besitzen und zu verteidigen. . . Einige Plattformen haben das Glück, ihre Daten schützen zu können, indem sie Nichtbenutzern den Zugriff darauf verweigern, andere müssen jedoch öffentlich zugängliche Dienste bereitstellen und können sich diesen Luxus nicht leisten. Hier kommen Lösungen wie unsere ins Spiel.“