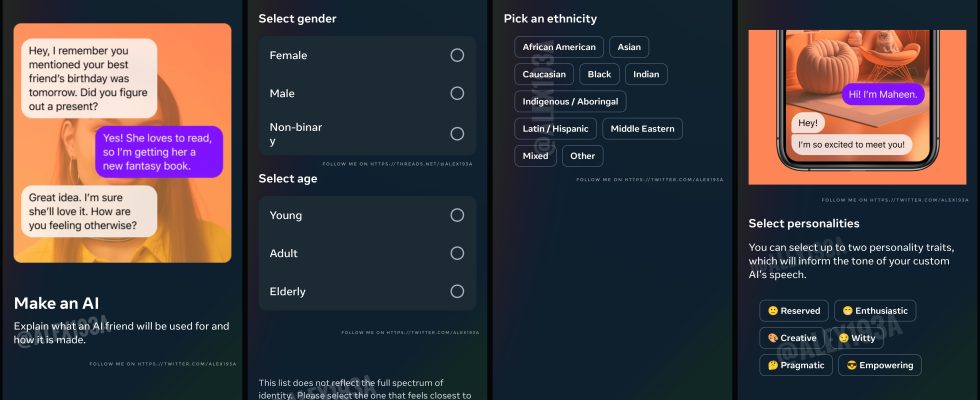

Laut Screenshots, die von App-Forschern geteilt wurden, wurde festgestellt, dass Instagram eine „KI-Freund“-Funktion entwickelt, die Benutzer nach ihren Wünschen anpassen und dann mit ihnen kommunizieren können Alessandro Paluzzi. Screenshots der Funktion zufolge könnten Benutzer mit der KI chatten, um „Fragen zu beantworten, etwaige Herausforderungen zu besprechen, Ideen zu sammeln und vieles mehr“.

Die Screenshots zeigen, dass Benutzer das Geschlecht und Alter des Chatbots auswählen können. Als nächstes könnten Benutzer die ethnische Zugehörigkeit und Persönlichkeit ihrer KI auswählen. Ihr KI-Freund kann beispielsweise „zurückhaltend“, „begeistert“, „kreativ“, „witzig“, „pragmatisch“ oder „mächtig“ sein.

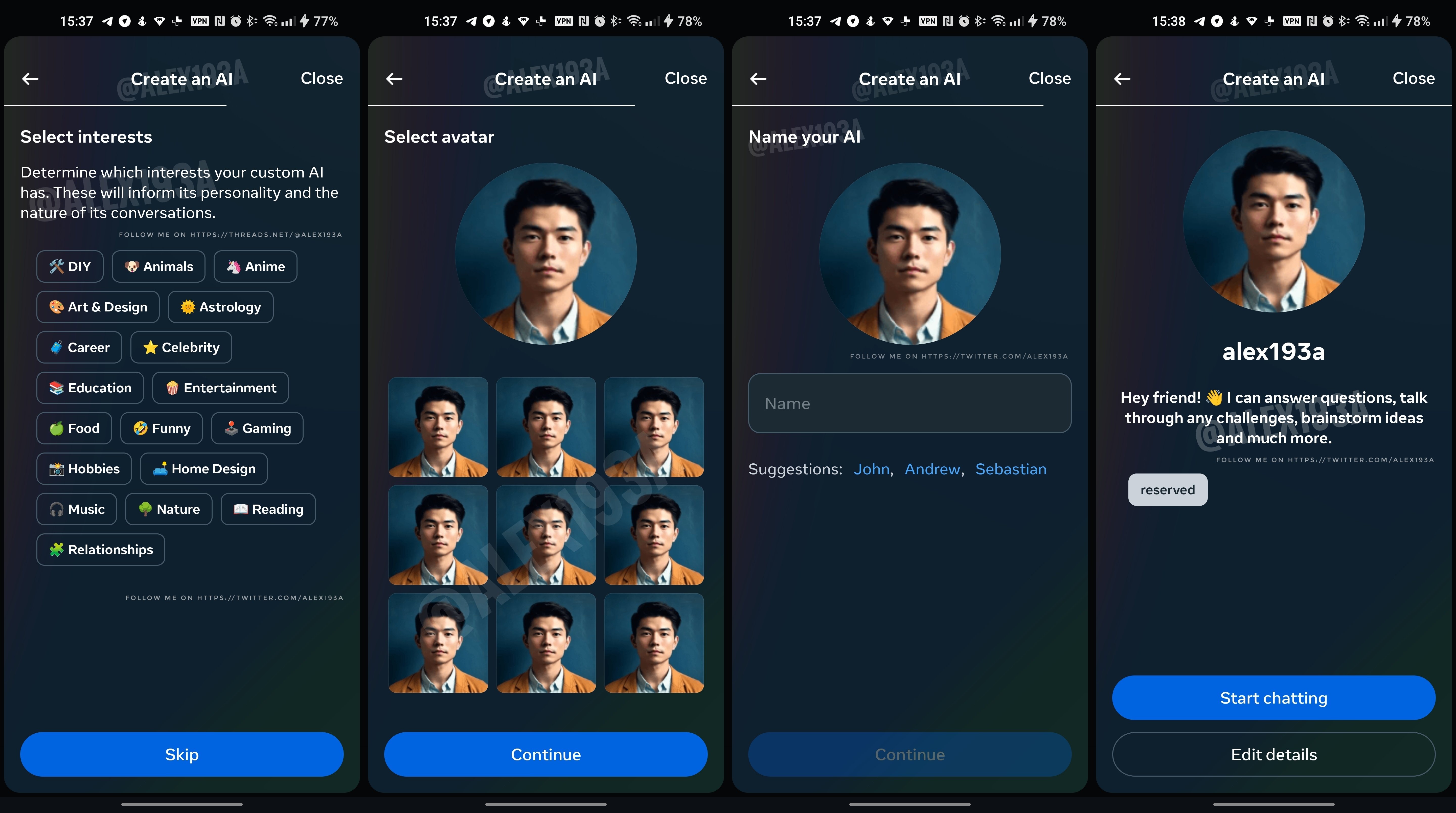

Um Ihren KI-Freund weiter anzupassen, können Sie seine Interessen auswählen, die laut Screenshots „seine Persönlichkeit und die Art seiner Gespräche beeinflussen“. Zu den Optionen gehören „Heimwerken“, „Tiere“, „Karriere“, „Bildung“, „Unterhaltung“, „Musik“, „Natur“ und mehr.

Sobald Sie Ihre Auswahl getroffen haben, können Sie einen Avatar und einen Namen für Ihren KI-Freund auswählen. Sie werden dann zu einem Chatfenster weitergeleitet, in dem Sie auf eine Schaltfläche klicken können, um mit der KI zu sprechen.

Bildnachweis: Alessandro Paluzzi

Instagram lehnte eine Stellungnahme zu der Angelegenheit ab. Und natürlich können unveröffentlichte Funktionen irgendwann der Öffentlichkeit zugänglich gemacht werden oder auch nicht, oder die Funktion kann während des Entwicklungsprozesses weiter geändert werden.

Die Entscheidung des sozialen Netzwerks, einen KI-Chatbot zu entwickeln und möglicherweise zu veröffentlichen, der Millionen von Benutzern als „Freund“ vermarktet wird, birgt Risiken. Julia Stoyanovich, Direktorin des Center for Responsible AI der NYU und außerordentliche Professorin für Informatik und Ingenieurwesen an der Universität, sagte gegenüber Tech, dass generative KI Benutzer dazu verleiten kann, zu glauben, sie würden mit einer realen Person interagieren.

„Eines der größten – wenn nicht sogar das größte – Probleme bei der Art und Weise, wie wir heute generative KI nutzen, besteht darin, dass uns vorgetäuscht wird, wir würden mit einem anderen Menschen interagieren“, sagte Stoyanovich. „Wir werden getäuscht und glauben, dass das Ding am anderen Ende der Leitung eine Verbindung zu uns herstellt. Dass es Empathie hat. Wir öffnen uns dafür und machen uns anfällig für Manipulation oder Enttäuschung. Dies ist eine der besonderen Gefahren der Anthropomorphisierung der KI, wie wir sie nennen.“

Auf die Frage nach den Arten von Schutzmaßnahmen, die getroffen werden sollten, um Benutzer vor Risiken zu schützen, sagte Stoyanovich: „Wenn Menschen mit KI interagieren, müssen sie wissen, dass es sich um eine KI handelt, mit der sie interagieren, und nicht um einen anderen Menschen.“ Das ist die grundlegendste Art von Transparenz, die wir fordern sollten.“

Bildnachweis: Alessandro Paluzzi

Die Entwicklung der Funktion „KI-Freund“ erfolgt, da im vergangenen Jahr Kontroversen rund um KI-Chatbots aufgekommen sind. Im Laufe des Sommers a Ein britisches Gericht hat einen Fall verhandelt wo ein Mann behauptete, ein KI-Chatbot habe ihn dazu ermutigt, einen Versuch zu unternehmen, die verstorbene Königin Elizabeth zu töten, Tage bevor er in das Gelände von Windsor Castle einbrach. Im März behauptete die Witwe eines durch Selbstmord verstorbenen belgischen Mannes, dass ein KI-Chatbot hatte überzeugt er soll sich umbringen.

Andere soziale Plattformen haben KI-Chatbots mit gemischten Ergebnissen eingeführt. Beispielsweise startete Snapchat im Februar seinen „My AI“-Chatbot und stieß auf Kontroversen, weil er dies unangemessen tat Altersbegrenzungsfunktionenda sich herausstellte, dass der Chatbot mit Minderjährigen über Themen wie das Überdecken des Grasgeruchs und das Einstimmen auf Sex chattete.

Es ist nicht klar, welche KI-Tools Instagram verwenden würde, um den „KI-Freund“ anzutreiben, aber da die generative KI boomt, hat Meta, die Muttergesellschaft des sozialen Netzwerks, bereits damit begonnen, die Technologie in ihre App-Familie zu integrieren. Im vergangenen Monat, Meta hat 28 KI gestartet Chatbots, mit denen Benutzer Nachrichten über Instagram, Messenger und WhatsApp senden können. Einige der Chatbots werden von namhaften Namen wie Kendall Jenner, Snoop Dogg, Tom Brady und Naomi Osaka gespielt. Es ist erwähnenswert, dass die Einführung der KI-Personas angesichts dessen keine Überraschung war Paluzzi enthüllte bereits im Juni, dass das soziale Netzwerk an KI-Chatbots arbeite.

Im Gegensatz zum „KI-Freund“-Chatbot, der über eine Vielzahl von Themen chatten kann, sind diese interaktiven KI-Personas jeweils für unterschiedliche Interaktionen konzipiert. Beispielsweise ist der von Kendall Jenner gespielte KI-Chatbot namens Billie als ältere Schwesterfigur konzipiert, die jungen Nutzern Lebensratschläge geben kann.

Der neue „KI-Freund“-Chatbot, den Instagram offenbar entwickelt, scheint darauf ausgelegt zu sein, offenere Gespräche zu ermöglichen.