Wenn Sie verwendet haben ein intelligenter Sprachassistent wie Alexa, Siri und wie auch immer Googles intelligenter Assistent heißt, Sie werden wahrscheinlich bemerkt haben, dass die Technologie jeden Tag intelligenter wird. Google kann auf Sie warten, Siri kann mit einer geschlechtsneutralen Stimme sprechen und Alexa kann Ihnen Gute-Nacht-Geschichten mit der Stimme Ihrer toten Großmutter vorlesen. Auch die Robotik entwickelt sich sprunghaft weiter, wie wir letzten Monat in unserem Robotik-Event erkundet haben. Die Kluft zwischen den beiden – Sprachbefehlen und autonomer Robotik – war aus mehreren Gründen groß. Letzte Woche waren wir in den Robotiklabors von Google in Mountain View, um zu sehen, wie sich das in naher Zukunft ändern wird.

Robotern beizubringen, was sie für sich wiederholende Aufgaben in kontrollierten Räumen tun sollen, in denen Menschen keinen Zutritt haben, ist nicht einfach, aber es ist mehr oder weniger ein gelöstes Problem. Rivians letzte Werksbesichtigung war eine großartige Erinnerung daran, aber der Einsatz von Industrierobotik findet überall in der Fertigung statt.

Allzweckroboter, die in Räumen, in denen auch Menschen leben, viele verschiedene Aufgaben auf Basis von Sprachbefehlen lösen können, sind viel schwieriger. Sie könnten sagen: „Aber was ist mit Roomba“, aber jedermanns Lieblings-Robo-Staubsauger ist im Allgemeinen so programmiert, dass er es vermeidet, andere Dinge als den Boden und alles, was auf dem Boden ist, zu berühren – sehr zum Leidwesen einiger Besitzer.

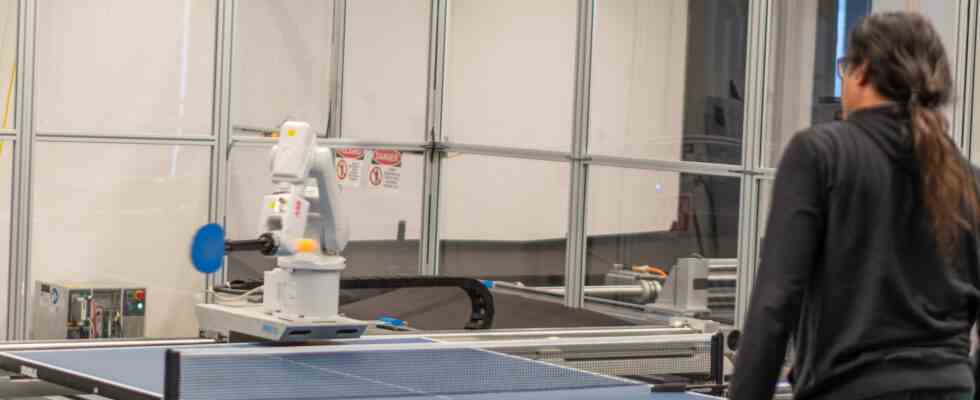

Tischtennis ist ein Spiel, bei dem der Roboter leicht selbst feststellen kann, ob eine Aufgabe erfolgreich war, und aus seinen Fehlern lernt. Hier macht einer der Roboterforscher bei Google eine Pause und zeigt dem Roboter, was was ist. Bildnachweis: Haje Kamps (öffnet in einem neuen Fenster) / Tech(öffnet in einem neuen Fenster)

„Sie fragen sich vielleicht, warum Tischtennis. Eine der großen Herausforderungen in der heutigen Robotik ist diese Schnittstelle zwischen schnell, präzise und anpassungsfähig. Sie können schnell und überhaupt nicht anpassungsfähig sein; Das ist kein Problem. Das ist in einem industriellen Umfeld in Ordnung. Aber schnell und anpassungsfähig und präzise zu sein, ist eine wirklich große Herausforderung. Ping-Pong ist ein wirklich schöner Mikrokosmos des Problems. Es erfordert Präzision und Schnelligkeit. Man kann von Spielern lernen, die spielen: Es ist eine Fähigkeit, die Menschen durch Üben entwickeln“, sagte mir Vincent Vanhoucke, Distinguished Scientist und Leiter der Robotik bei Google Research. „Es ist keine Fähigkeit, bei der man die Regeln lesen und über Nacht ein Champion werden kann. Das muss man wirklich üben.“

Geschwindigkeit und Präzision sind eine Sache, aber die Nuss, die Google in seinen Roboterlabors wirklich zu knacken versucht, ist die Schnittstelle zwischen menschlicher Sprache und Robotik. Es macht einige beeindruckende Sprünge in der Ebene des Roboterverständnisses natürlicher Sprache, die ein Mensch verwenden könnte. „Wenn Sie eine Minute Zeit haben, könnten Sie mir einen Drink von der Theke holen?“ ist eine ziemlich einfache Anfrage, die Sie einem Menschen stellen könnten. Für eine Maschine jedoch bündelt diese Aussage viel Wissen und Verständnis in einer scheinbar einzigen Frage. Lassen Sie es uns aufschlüsseln: „Wenn Sie eine Minute Zeit haben“ könnte überhaupt nichts bedeuten, nur als Redewendung gemeint sein, oder es könnte eine tatsächliche Aufforderung sein, die Arbeit des Roboters zu beenden. Wenn ein Roboter zu wörtlich ist, könnte die „richtige“ Antwort auf „Können Sie mir einen Drink holen“ einfach sein, dass der Roboter „Ja“ sagt. Es kann, und es bestätigt, dass es in der Lage ist, ein Getränk zu sich zu nehmen. Aber als Benutzer haben Sie den Roboter nicht explizit darum gebeten. Und wenn wir besonders pedantisch sind, Sie haben dem Roboter nicht ausdrücklich gesagt, dass er Ihnen das Getränk bringen soll.

Dies sind einige der Probleme, die Google mit seinem System zur Verarbeitung natürlicher Sprache angeht. das Pathways-Sprachmodell – oder Palme unter Freunden: Genau verarbeiten und aufnehmen, was ein Mensch wirklich will, anstatt buchstäblich zu tun, was er sagt.

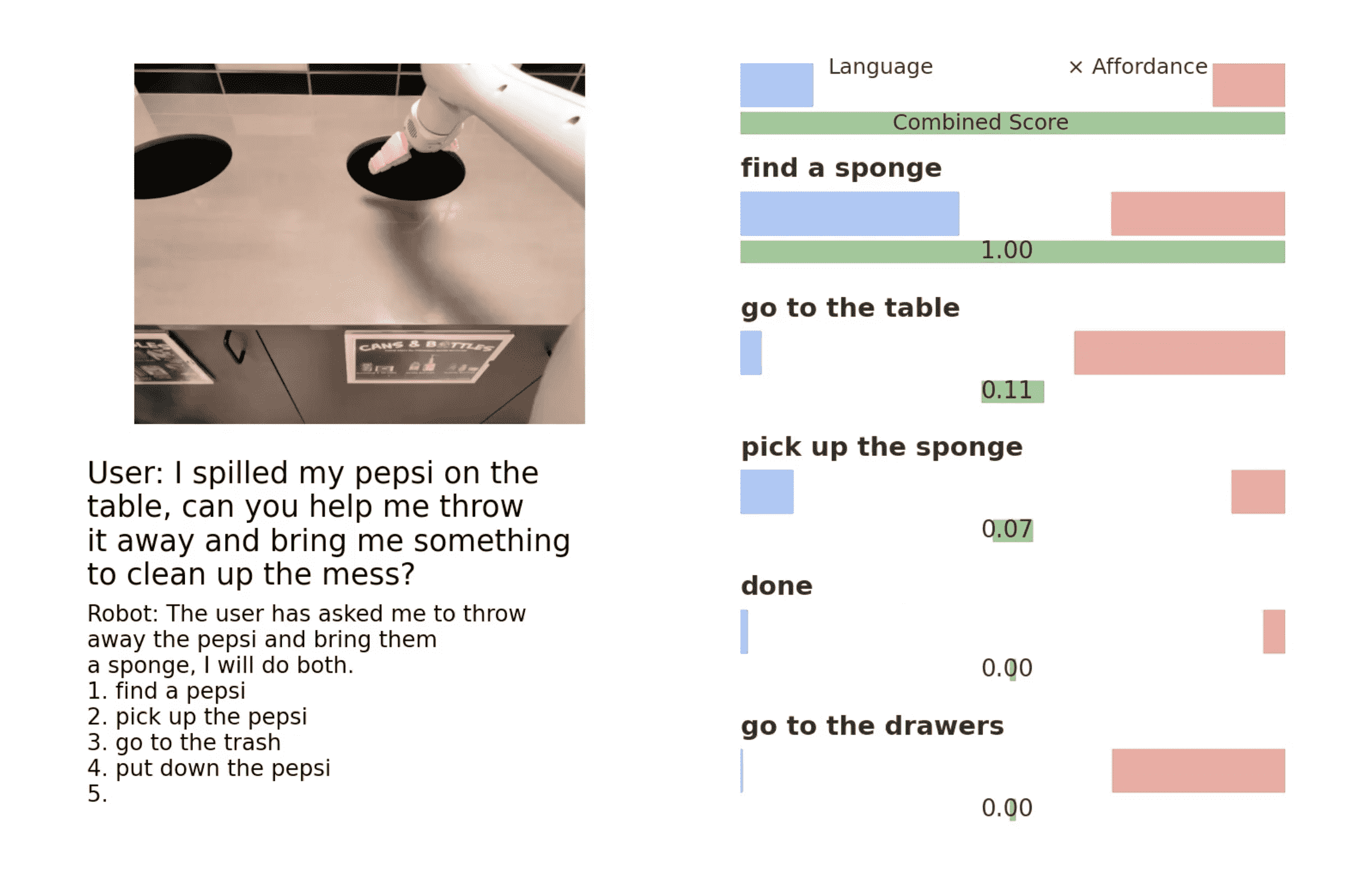

Die nächste Herausforderung besteht darin, zu erkennen, was ein Roboter eigentlich kann. Ein Roboter versteht es vielleicht sehr gut, wenn Sie ihn bitten, eine Flasche Reiniger von der Oberseite des Kühlschranks zu holen, wo sie sicher und für Kinder unzugänglich aufbewahrt wird. Das Problem ist, dass der Roboter nicht so hoch kommen kann. Der große Durchbruch ist das, was Google „Affordances“ nennt – was der Roboter tatsächlich mit einem gewissen Grad an Erfolg leisten kann. Dies kann einfache Aufgaben („einen Meter vorwärts gehen“), etwas fortgeschrittenere Aufgaben („Geh und suche eine Dose Cola in der Küche“) bis hin zu komplexen, mehrstufigen Aktionen umfassen, die dem Roboter einiges an Verständnis abverlangen seiner eigenen Fähigkeiten und der Welt um ihn herum. („Ugh, ich habe meine Dose Cola auf den Boden verschüttet. Könntest du sie aufwischen und mir ein gesundes Getränk bringen?“).

Der Ansatz von Google nutzt das in Sprachmodellen („Say“) enthaltene Wissen, um Aktionen zu bestimmen und zu bewerten, die für allgemeine Anweisungen nützlich sind. Es verwendet auch eine Angebotsfunktion („Kann“), die eine reale Erdung ermöglicht und bestimmt, welche Aktionen in einer bestimmten Umgebung ausgeführt werden können. Unter Verwendung des PaLM-Sprachmodells nennt Google das PaLM-SayCan.

Das Roboterlabor von Google verwendet eine Reihe dieser Roboter von Alltagsroboter. Diese Kerle nehmen sich eine wohlverdiente R&R (Ruhe und Aufladen) und sie haben sogar gelernt, wie man sich selbst zum Aufladen einsteckt. Bildnachweis: Haje Kamps (öffnet in einem neuen Fenster) / Tech(öffnet in einem neuen Fenster)

Um den fortgeschritteneren Befehl oben zu lösen, muss der Roboter ihn in eine Reihe von Einzelschritten zerlegen. Ein Beispiel dafür könnte sein:

- Kommen Sie zum Lautsprecher.

- Schauen Sie auf den Boden, finden Sie den Fleck, merken Sie sich, wo er ist.

- Gehen Sie durch die Schubladen, Schränke und Küchentheken und suchen Sie nach einem Mopp, Schwamm oder Papiertuch.

- Wenn Sie ein Reinigungswerkzeug (in der Schublade befindet sich ein Schwamm) gefunden haben, nehmen Sie es auf.

- Schließen Sie die Schublade.

- Gehen Sie zum Verschütten.

- Beseitigen Sie die verschüttete Flüssigkeit und beobachten Sie, ob der Schwamm die gesamte Flüssigkeit aufnehmen kann. Wenn nicht, wringen Sie es in der Spüle aus und kommen Sie zurück.

- Wringe den Schwamm ein weiteres Mal aus, sobald die verschüttete Flüssigkeit entfernt ist.

- Wasserhahn aufdrehen, Schwamm ausspülen, Wasserhahn schließen, Schwamm ein letztes Mal auswringen.

- Schublade öffnen, Schwamm weglegen, Schublade schließen.

- Identifizieren Sie, welche Getränke in der Küche sind, und bestimmen Sie irgendwie, welche Getränke „gesünder“ sind als eine Cola.

- Finden Sie eine Flasche Wasser im Kühlschrank, heben Sie sie auf und bringen Sie sie der Person, die danach gefragt hat – die sich möglicherweise bewegt hat, seit sie die Frage gestellt hat, weil Sie ein langsamer kleiner Roboter sind, der hin und her rollen musste 14 Mal zum Waschbecken, weil Sie dachten, es wäre eine brillante Idee, anstelle von Papiertüchern einen kleinen Küchenschwamm zu verwenden, um 11 Unzen Flüssigkeit aufzuwischen.

Wie auch immer – ich mache mich hier lustig, aber Sie verstehen das Wesentliche; Selbst relativ einfach klingende Anweisungen können tatsächlich eine große Anzahl von Schritten, Logik und Entscheidungen auf dem Weg enthalten. Finden Sie das gesündeste Getränk, oder ist das Ziel, etwas zu bekommen, das gesünder ist als Coca-Cola? Könnte es sinnvoll sein, zuerst das Getränk zu holen und dann die Sauerei aufzuwischen, damit der Mensch seinen Durst stillen kann, während Sie sich um den Rest der Aufgabe kümmern?

Dieser Screenshot zeigt, wie der Roboter eine Abfrage auswerten und herausfinden könnte, was er bei jedem Schritt tun sollte. In diesem Fall hat der Roboter festgestellt, dass er einen Schwamm finden sollte und dass er einen hohen Grad an Erfolg beim Finden, Identifizieren und Manipulieren von Schwämmen hat. Es zeigt auch, dass dieser spezielle Roboter wirklich gut darin ist, „in die Schublade zu gehen“, kommt aber auch zu dem Schluss, dass dies in diesem Fall nicht allzu hilfreich wäre. Bildnachweis: Google

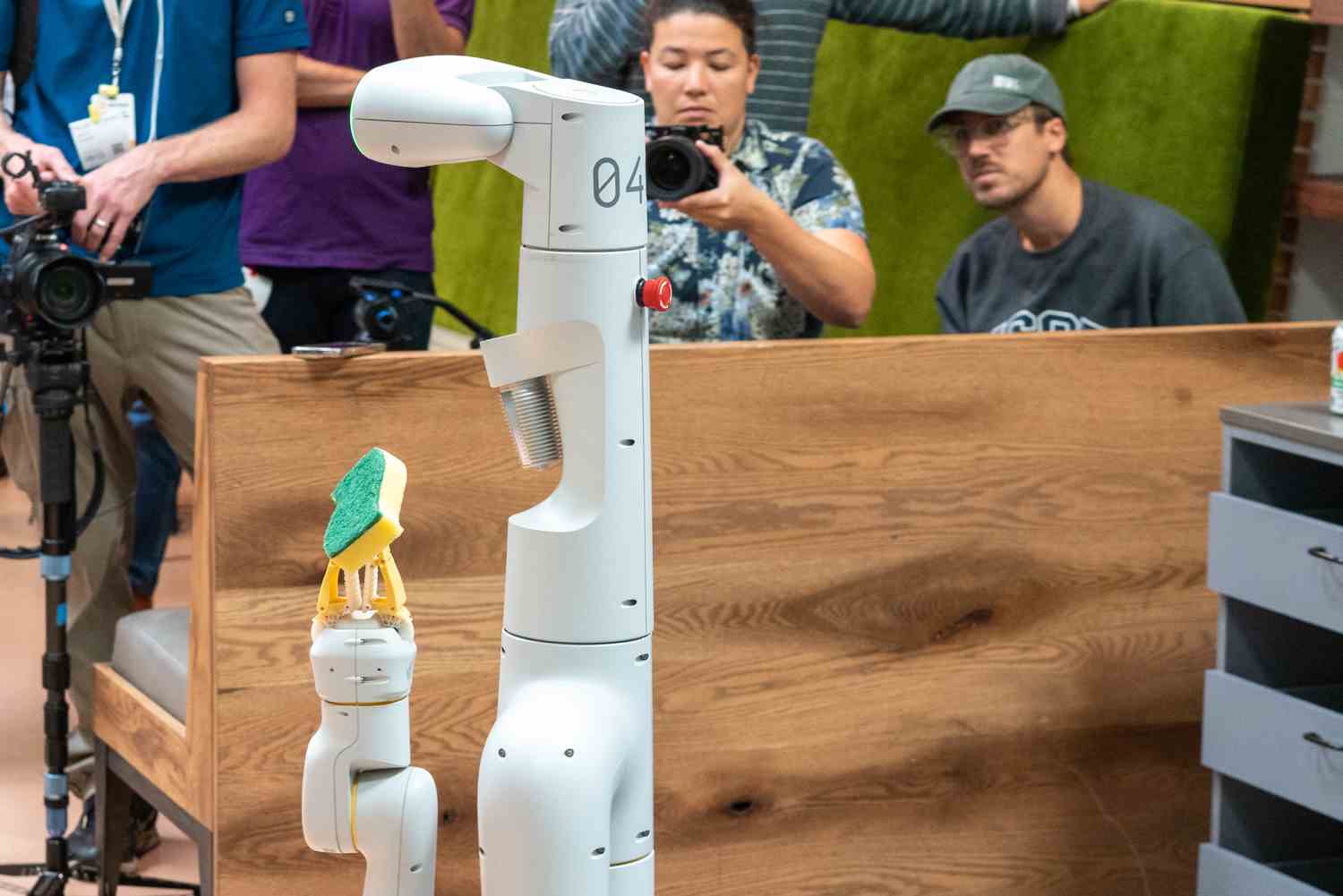

Entscheidend dabei ist, den Robotern beizubringen, was sie können und was nicht und was in verschiedenen Situationen sinnvoll ist. Als ich das Roboterlabor von Google besichtigte, sah ich ungefähr 30 Roboter, beide von Alltagsroboter und mehr speziell gebaute Maschinen, Tischtennis spielen, Lacrosse-Bälle fangen und lernen, Blöcke zu stapeln, Kühlschranktüren zu öffnen und „höflich zu sein“, während sie sich im selben Raum wie Menschen bewegen.

Schöner Fang! Bildnachweis: Haje Kamps (öffnet in einem neuen Fenster) / Tech

Die interessante Herausforderung, vor der die Robotik steht, besteht darin, dass Sprachmodelle nicht inhärent in der physischen Welt verankert sind. Sie werden mit riesigen Textbibliotheken trainiert, aber Textbibliotheken interagieren nicht mit ihrer Umgebung und müssen sich auch nicht zu viele Gedanken darüber machen, Probleme zu verursachen. Es ist irgendwie lustig, wenn Sie Google bitten, Sie zum nächsten Café zu führen, und Maps versehentlich eine 45-tägige Wanderung und ein dreitägiges Schwimmen über einen See kartiert. In der realen Welt haben dumme Fehler echte Konsequenzen.

Wenn Sie beispielsweise gefragt werden: „Ich habe mein Getränk verschüttet, können Sie mir helfen?“ Das Sprachmodell GPT-3 antwortet mit „Sie könnten versuchen, einen Staubsauger zu verwenden.“ Es macht Sinn: Für einige Unordnung ist ein Staubsauger eine gute Wahl, und es liegt nahe, dass ein Sprachmodell einen Staubsauger mit, nun ja, Reinigen verbindet. Wenn der Roboter das tatsächlich tun würde, würde er wahrscheinlich scheitern: Staubsauger sind nicht gut bei verschütteten Getränken, und Wasser und Elektronik vertragen sich nicht, sodass Sie bestenfalls mit einem kaputten Staubsauger oder im schlimmsten Fall mit einem Gerätebrand enden könnten.

Die PaLM-SayCan-fähigen Roboter von Google werden in einer Küchenumgebung platziert und darauf trainiert, in verschiedenen Aspekten der Küchenhilfe besser zu werden. Wenn die Roboter eine Anweisung erhalten, versuchen sie, eine Entscheidung zu treffen. „Wie hoch ist die Wahrscheinlichkeit, dass ich bei dem, was ich ausprobieren möchte, erfolgreich sein werde“ und „wie hilfreich ist dieses Ding wahrscheinlich.“ Irgendwo in der Lücke zwischen diesen beiden Überlegungen werden Roboter von Tag zu Tag deutlich intelligenter.

Die triumphale Rückkehr des schwammholenden Roboters. Bildnachweis: Haje Kamps (öffnet in einem neuen Fenster) / Tech

Affordances – oder die Fähigkeit, etwas zu tun – ist nicht binär. Drei Golfbälle übereinander zu balancieren ist sehr schwer, aber nicht unmöglich. Das Öffnen einer Schublade ist für einen Roboter, dem nicht gezeigt wurde, wie Schubladen funktionieren, fast unmöglich – aber sobald sie trainiert sind und experimentieren können, wie man eine Schublade am besten öffnet, können sie ein immer höheres Maß an Vertrauen in einen Roboter entwickeln Aufgabe. Ein ungeschulter Roboter, schlägt Google vor, ist möglicherweise nicht in der Lage, eine Tüte Kartoffelchips aus einer Schublade zu holen. Aber geben Sie ihm einige Anweisungen und ein paar Tage zum Üben, und die Erfolgschancen steigen erheblich.

Natürlich werden all diese Trainingsdaten gewertet, während der Roboter Dinge ausprobiert. Von Zeit zu Zeit mag ein Roboter eine Aufgabe auf überraschende Weise „lösen“, aber es kann für einen Roboter tatsächlich „einfacher“ sein, es so zu tun.

Durch die Trennung der Sprachmodelle von den Angeboten bedeutet dies, dass der Roboter Befehle in einer Reihe verschiedener Sprachen „verstehen“ kann. Das bewies das Team auch in der Küche, als der Leiter der Robotik Vincent Vanhoucke den Roboter auf Französisch um eine Dose Cola bat; „Wir haben die Sprachkenntnisse kostenlos bekommen“, sagte das Team und hob hervor, wie flexibel die neuronalen Netze sind, die zum Trainieren der Roboter verwendet werden, um (buchstäblich und im übertragenen Sinne) neue Türen für Zugänglichkeit und universellen Zugang zu öffnen.

Die meisten Roboter, die Dinge berühren, öffnen, bewegen und reinigen, sind im Allgemeinen nicht dazu eingeladen, so nah am Menschen zu arbeiten. Wir wurden ermutigt, Abstand zu halten, aber die Forscher schienen sich sehr wohl zu fühlen, wenn die Roboter nur wenige Zentimeter von ihren ungepanzerten menschlichen Körpern entfernt autonom operierten. Bildnachweis: Haje Kamps (öffnet in einem neuen Fenster) / Tech

Keiner der Roboter oder Technologien ist derzeit verfügbar oder notwendigerweise sogar für kommerzielle Produkte bestimmt.

„RNun, es ist ausschließlich Forschung. Wie Sie anhand des heutigen Kenntnisstands sehen können, ist es noch nicht wirklich bereit, in einer kommerziellen Umgebung eingesetzt zu werden. Wir sind Forschungseinrichtungen und lieben es, an Dingen zu arbeiten, die nicht funktionieren“, witzelt Vanhoucke. „Das ist in gewisser Weise die Definition von Forschung, und wir werden weiter Druck machen. Wir arbeiten gerne an Dingen, die nicht skaliert werden müssen, weil wir so mitteilen können, wie die Dinge mit mehr Daten und mehr Computerfähigkeiten skalieren. Sie können einen Trend erkennen, wohin sich die Dinge in Zukunft entwickeln könnten.“

Das Robotiklabor von Google wird eine Weile brauchen, um herauszufinden, welche kommerziellen Auswirkungen seine Experimente, wenn überhaupt, langfristig haben werden, aber selbst in den relativ einfachen Demos, die letzte Woche in Mountain View gezeigt wurden, ist es offensichtlich, dass die Verarbeitung natürlicher Sprache und Robotik gewinnen beide, da die Teams von Google tiefere Fähigkeiten, Kenntnisse und umfangreiche Datensätze zum Trainieren von Robotern aufbauen.