Es ist der Moment, auf den Sie das ganze Jahr gewartet haben: der Google I/O-Keynote-Tag! Google eröffnet seine Entwicklerkonferenz jedes Jahr mit einer Flut von Ankündigungen, darunter viele Enthüllungen der neuesten Dinge, an denen das Unternehmen gearbeitet hat. Brian Es hat uns bereits den Kick gegeben, indem wir uns mitgeteilt haben, was wir erwarten.

Wir wissen, dass Sie heute nicht immer die Zeit haben, sich die gesamte zweistündige Präsentation anzusehen. Deshalb nehmen wir das an und liefern kurze Einblicke in die wichtigsten Neuigkeiten der Keynote, sobald sie angekündigt werden – und das alles in einer leicht verständlichen Form. Übersichtliche, leicht zu überfliegende Liste. Auf geht’s!

Google Play

Google Play erregt unter anderem mit einer neuen Erkennungsfunktion für Apps, neuen Möglichkeiten zur Nutzerakquise, Updates für Play Points und anderen Verbesserungen an entwicklerorientierten Tools wie der Google Play SDK Console und der Play Integrity API einige Aufmerksamkeit.

Von besonderem Interesse für Entwickler ist das sogenannte Engage SDK, das App-Herstellern eine Möglichkeit bietet, Benutzern ihre Inhalte in einem immersiven Vollbilderlebnis zu präsentieren, das auf den einzelnen Benutzer zugeschnitten ist. Laut Google ist dies jedoch derzeit keine für Nutzer sichtbare Oberfläche. Mehr lesen

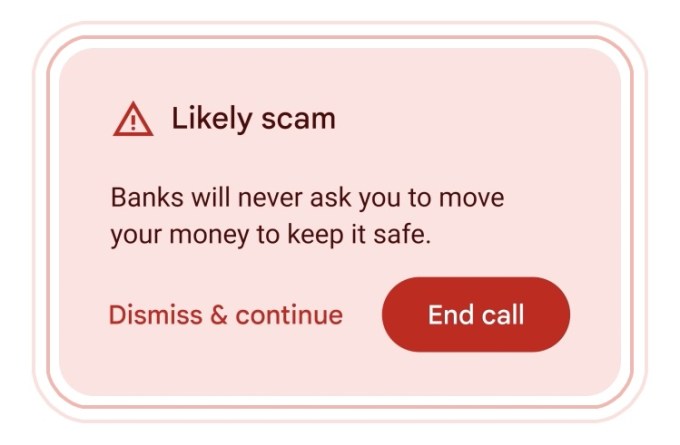

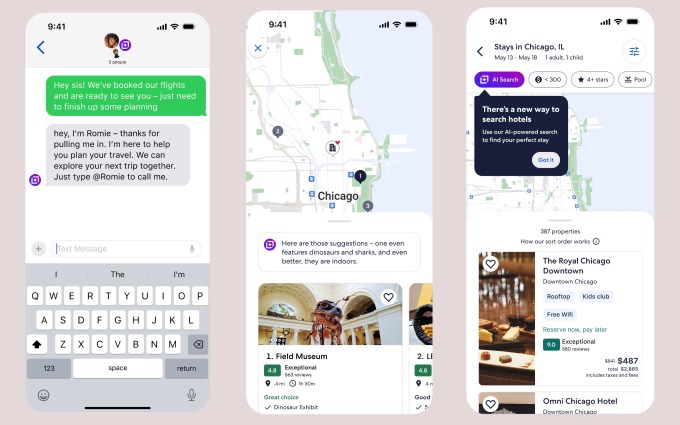

Erkennen von Betrug während eines Anrufs

Am Dienstag stellte Google eine Vorschau einer Funktion vor, von der es glaubt, dass sie Nutzer während des Anrufs auf potenzielle Betrügereien aufmerksam machen wird.

Die Funktion, die in eine zukünftige Version von Android integriert wird, nutzt Gemini Nano, die kleinste Version von Googles generativem KI-Angebot, die vollständig auf dem Gerät ausgeführt werden kann. Das System lauscht effektiv in Echtzeit auf „Gesprächsmuster, die häufig mit Betrug in Verbindung gebracht werden“.

Google nennt als Beispiel jemanden, der sich als „Bankvertreter“ ausgibt. Auch gängige Betrügertaktiken wie Passwortanfragen und Geschenkkarten lösen das System aus. Man weiß, dass dies alles Methoden sind, um Geld von einem zu erpressen, aber viele Menschen auf der Welt sind immer noch anfällig für solche Betrügereien. Sobald es ausgelöst wird, wird eine Benachrichtigung angezeigt, dass der Benutzer möglicherweise Opfer unappetitlicher Charaktere wird. Mehr lesen

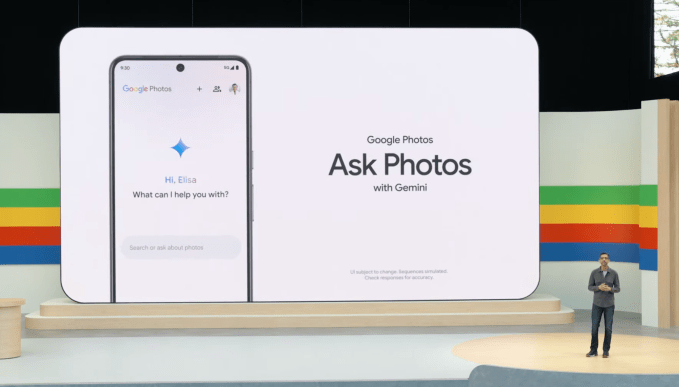

Fragen Sie nach Fotos

Google Fotos erhält eine KI-Infusion mit der Einführung einer experimentellen Funktion, Ask Photos, die auf dem Gemini-KI-Modell von Google basiert. Die neue Ergänzung, die später in diesem Sommer eingeführt wird, ermöglicht es Nutzern, ihre Google Fotos-Sammlung mithilfe von Abfragen in natürlicher Sprache zu durchsuchen, die das Verständnis einer KI für den Inhalt ihrer Fotos und andere Metadaten nutzen.

Bevor Benutzer in ihren Fotos nach bestimmten Personen, Orten oder Dingen suchen konnten, wird das KI-Upgrade dank der Verarbeitung natürlicher Sprache das Auffinden der richtigen Inhalte intuitiver und weniger manuell machen.

Und das Beispiel war auch süß. Wer liebt nicht das Tiger-Stofftier-Golden-Retriever-Band-Duo „Golden Stripes“? Mehr lesen

Alles über Zwillinge

Gemini 1.5 Pro: Ein weiteres Upgrade der generativen KI besteht darin, dass Gemini jetzt längere Dokumente, Codebasen, Videos und Audioaufnahmen als zuvor analysieren kann.

In einer privaten Vorschau einer neuen Version von Gemini 1.5 Pro, dem aktuellen Flaggschiffmodell des Unternehmens, wurde bekannt gegeben, dass es bis zu 2 Millionen Token aufnehmen kann. Das ist das Doppelte des bisherigen Höchstbetrags. Mit diesem Level unterstützt die neue Version von Gemini 1.5 Pro den größten Input aller kommerziell erhältlichen Modelle. Mehr lesen

Zwillinge Live: Das Unternehmen stellte eine neue Erfahrung in Gemini namens Gemini Live vor, die es Benutzern ermöglicht, „ausführliche“ Sprachchats mit Gemini auf ihren Smartphones zu führen. Benutzer können Gemini unterbrechen, während der Chatbot spricht, um klärende Fragen zu stellen, und der Chatbot passt sich in Echtzeit an ihre Sprachmuster an. Und Zwillinge können die Umgebung der Benutzer sehen und darauf reagieren, entweder über Fotos oder Videos, die von den Kameras ihrer Smartphones aufgenommen wurden.

Auf den ersten Blick scheint Live kein drastisches Upgrade gegenüber vorhandener Technologie zu sein. Aber Google behauptet, dass es neuere Techniken aus dem Bereich der generativen KI nutzt, um eine überlegene, weniger fehleranfällige Bildanalyse zu liefern – und diese Techniken mit einer verbesserten Sprach-Engine kombiniert, um konsistentere, emotional ausdrucksstärkere und realistischere Dialoge mit mehreren Runden zu ermöglichen. Mehr lesen

Zwillinge Nano: Nun zu einer kleinen Ankündigung. Google baut außerdem Gemini Nano, das kleinste seiner KI-Modelle, direkt in den Chrome-Desktop-Client ein, beginnend mit Chrome 126. Dadurch, so das Unternehmen, können Entwickler das On-Device-Modell nutzen, um ihre eigenen KI-Funktionen zu betreiben. Google selbst plant, diese neue Funktion zu nutzen, um beispielsweise Funktionen wie das bestehende „Helfen Sie mir zu schreiben“-Tool von Workspace Lab in Gmail zu unterstützen. Mehr lesen

Zwillinge auf Android: Googles Gemini für Android, sein KI-Ersatz für Google Assistant, wird bald von seiner Fähigkeit profitieren, sich tief in das mobile Betriebssystem von Android und die Apps von Google zu integrieren. Benutzer können KI-generierte Bilder per Drag-and-Drop direkt in ihr Gmail, Google Messages und andere Apps ziehen. In der Zwischenzeit können YouTube-Nutzer auf „Dieses Video fragen“ tippen, um bestimmte Informationen in diesem YouTube-Video zu finden, sagt Google. Mehr lesen

Zwillinge auf Google Maps: Gemini-Modellfunktionen kommen für Entwickler auf die Google Maps-Plattform, beginnend mit der Places API. Entwickler können generative KI-Zusammenfassungen von Orten und Gebieten in ihren eigenen Apps und Websites anzeigen. Die Zusammenfassungen basieren auf Geminis Analyse der Erkenntnisse der Google Maps-Community mit mehr als 300 Millionen Mitwirkenden. Was ist besser? Entwickler müssen keine eigenen benutzerdefinierten Ortsbeschreibungen mehr schreiben. Mehr lesen

Tensor Processing Units erhalten einen Leistungsschub

Google hat seine nächste Generation – um genau zu sein die sechste – seiner Tensor Processing Units (TPU) KI-Chips vorgestellt. Sie heißen Trillium und werden später in diesem Jahr auf den Markt kommen. Wenn Sie sich erinnern, hat die Ankündigung der nächsten Generation von TPUs auf der I/O eine gewisse Tradition, auch wenn die Chips erst später im Jahr auf den Markt kommen.

Diese neuen TPUs werden im Vergleich zur fünften Generation eine 4,7-fache Leistungssteigerung bei der Rechenleistung pro Chip bieten. Was jedoch vielleicht noch wichtiger ist, ist, dass Trillium über die dritte Generation von SparseCore verfügt, den Google als „einen spezialisierten Beschleuniger für die Verarbeitung extrem großer Einbettungen, die bei erweiterten Ranking- und Empfehlungs-Workloads üblich sind“ beschreibt. Mehr lesen

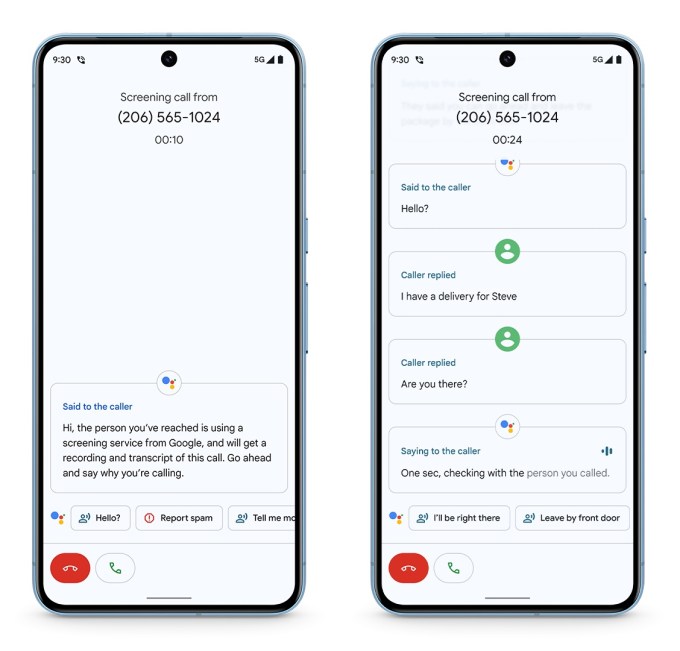

KI auf der Suche

Google fügt seiner Suche mehr KI hinzu und zerstreut damit Zweifel, dass das Unternehmen Marktanteile an Konkurrenten wie ChatGPT und Perplexity verliert. Es führt KI-gestützte Übersichten für Benutzer in den USA ein. Darüber hinaus möchte das Unternehmen Gemini auch als Agent für Dinge wie die Reiseplanung einsetzen. Mehr lesen

Google plant, für einige Suchergebnisse generative KI zu nutzen, um die gesamte Suchergebnisseite zu organisieren. Dies ist eine Ergänzung zur bestehenden KI-Übersichtsfunktion, die einen kurzen Ausschnitt mit aggregierten Informationen zu einem von Ihnen gesuchten Thema erstellt. Die KI-Übersichtsfunktion wird am Dienstag allgemein verfügbar, nach einem Aufenthalt im AI Labs-Programm von Google. Mehr lesen

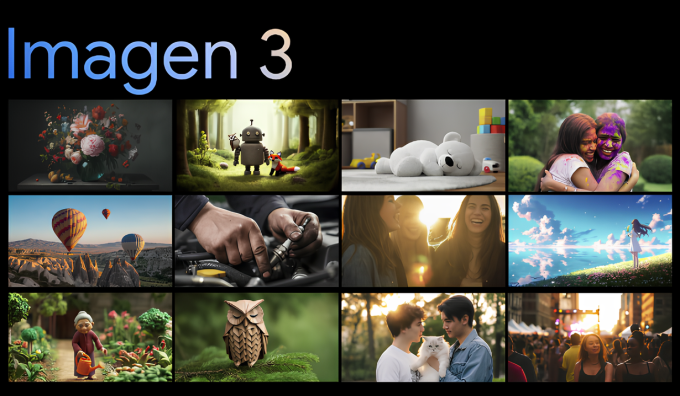

Generative KI-Upgrades

Google kündigte Imagen 3 an, das neueste Mitglied der generativen KI-Modellfamilie Imagen des Technologieriesen.

Demis Hassabis, Leiterin von DeepMind, der KI-Forschungsabteilung von Google, sagte, dass Imagen 3 die Textaufforderungen, die es in Bilder übersetzt, im Vergleich zu seinem Vorgänger Imagen 2 genauer versteht und in seinen Generationen „kreativer und detaillierter“ ist. Darüber hinaus produziere das Modell weniger „störende Artefakte“ und Fehler, sagte er.

„Das ist [also] Unser bisher bestes Modell zum Rendern von Text, was für Bildgenerierungsmodelle eine Herausforderung darstellte“, fügte Hassabis hinzu. Mehr lesen

Gemma 2-Updates

Gemma 2, die nächste Generation der Gemma-Modelle von Google, wird im Juni mit einem 27-Milliarden-Parameter-Modell auf den Markt kommen. Mehr lesen

Projekt IDX

Project IDX, die KI-zentrierte browserbasierte Entwicklungsumgebung der nächsten Generation des Unternehmens, befindet sich jetzt in der offenen Betaphase. Mit diesem Update kommt eine Integration mit der Google Maps Platform in die IDE, die dabei hilft, Geolokalisierungsfunktionen zu seinen Apps hinzuzufügen, sowie Integrationen mit den Chrome Dev Tools und Lighthouse, um das Debuggen von Anwendungen zu unterstützen. Bald wird Google auch die Bereitstellung von Apps auf Cloud Run ermöglichen, der serverlosen Plattform von Google Cloud zum Ausführen von Front- und Back-End-Diensten. Mehr lesen

Veo

Google strebt nach OpenAIs Sora mit Veo, einem KI-Modell, das bei Eingabe einer Textaufforderung etwa eine Minute lange 1080p-Videoclips erstellen kann. Veo kann verschiedene visuelle und filmische Stile erfassen, einschließlich Landschafts- und Zeitrafferaufnahmen, und Bearbeitungen und Anpassungen an bereits erstelltem Filmmaterial vornehmen.

Es baut auch auf Googles vorläufiger kommerzieller Arbeit zur Videogenerierung auf, die im April vorgestellt wurde und bei der die Imagen 2-Familie bildgenerierender Modelle des Unternehmens zum Erstellen von Videoclips in Endlosschleife genutzt wurde. Mehr lesen

Zum Suchen einkreisen

Die KI-gestützte „Circle to Search“-Funktion, die es Android-Benutzern ermöglicht, mithilfe von Gesten wie Kreisen sofort Antworten zu erhalten, wird nun in der Lage sein, komplexere Probleme in den Bereichen Hellseher und Mathematik zu lösen. Es soll es einfacher machen, von überall auf dem Telefon aus mit der Google-Suche zu interagieren, indem man bestimmte Aktionen ausführt – etwa Kreisen, Hervorheben, Kritzeln oder Tippen. Oh, und es ist auch besser, Kindern direkt von unterstützten Android-Telefonen und -Tablets aus bei ihren Hausaufgaben zu helfen. Mehr lesen

Firebase Genkit

Es gibt eine neue Ergänzung zur Firebase-Plattform namens Firebase Genkit, die es Entwicklern einfacher machen soll, KI-gestützte Anwendungen in JavaScript/TypeScript zu erstellen, wobei Go-Unterstützung bald verfügbar sein wird. Es handelt sich um ein Open-Source-Framework, das die Apache 2.0-Lizenz verwendet und es Entwicklern ermöglicht, KI schnell in neue und bestehende Anwendungen zu integrieren.

Zu den Anwendungsfällen für Genkit, die das Unternehmen am Dienstag hervorhebt, gehören viele der Standard-GenAI-Anwendungsfälle: Generierung und Zusammenfassung von Inhalten, Textübersetzung und Generierung von Bildern. Mehr lesen

Pixel 8a

Google konnte nicht bis zur I/O warten, um die neueste Ergänzung der Pixel-Reihe vorzustellen und kündigte letzte Woche das neue Pixel 8a an. Das Mobilteil kostet ab 499 US-Dollar und wird am Dienstag ausgeliefert. Auch die Aktualisierungen entsprechen unseren Erwartungen. Ganz oben auf der Liste steht die Hinzufügung des Tensor G3-Chips. Mehr lesen

Pixel Slate

Googles Pixel-Tablet namens Slate ist jetzt verfügbar. Wenn Sie sich erinnern, hat Brian letztes Jahr ungefähr zur gleichen Zeit das Pixel-Tablet getestet und alles, worüber er gesprochen hat, war die Basis. Interessanterweise ist das Tablet auch ohne erhältlich. Mehr lesen

Wir werden diesen Beitrag im Laufe des Tages aktualisieren …