Google versucht, mit Gemini, seiner Flaggschiff-Suite generativer KI-Modelle, Apps und Dienste, für Aufsehen zu sorgen.

Was sind also Zwillinge? Wie können Sie es nutzen? Und wie schlägt es sich im Vergleich zur Konkurrenz?

Um es einfacher zu machen, über die neuesten Gemini-Entwicklungen auf dem Laufenden zu bleiben, haben wir diesen praktischen Leitfaden zusammengestellt. Wir werden ihn auf dem neuesten Stand halten, sobald neue Gemini-Modelle, Funktionen und Neuigkeiten zu Googles Plänen für Gemini veröffentlicht werden.

Was sind Zwillinge?

Zwillinge gehören Google lange versprochen, GenAI-Modellfamilie der nächsten Generation, entwickelt von Googles KI-Forschungslabors DeepMind und Google Research. Es gibt ihn in drei Geschmacksrichtungen:

- Zwillinge Ultradas leistungsstärkste Gemini-Modell.

- Zwillinge Proein „leichtes“ Gemini-Modell.

- Zwillinge Nanoein kleineres „destilliertes“ Modell, das auf Mobilgeräten wie dem Pixel 8 Pro läuft.

Alle Gemini-Modelle wurden darauf trainiert, „nativ multimodal“ zu sein – mit anderen Worten, sie sind in der Lage, mit mehr als nur Wörtern zu arbeiten und sie zu verwenden. Sie wurden anhand einer Vielzahl von Audio-, Bild- und Videodateien, einer großen Menge an Codebasen und Texten in verschiedenen Sprachen vorab trainiert und verfeinert.

Dies unterscheidet Gemini von Modellen wie Googles eigenem LaMDA, das ausschließlich auf Textdaten trainiert wurde. LaMDA kann nichts anderes als Text verstehen oder generieren (z. B. Aufsätze, E-Mail-Entwürfe), aber das ist bei Gemini-Modellen nicht der Fall.

Was ist der Unterschied zwischen den Gemini-Apps und den Gemini-Modellen?

Bildnachweis: Google

Google hat einmal mehr bewiesen, dass es ihm an einem Gespür für Branding mangelt, und hat nicht von Anfang an deutlich gemacht, dass Gemini von den Gemini-Apps im Web und auf Mobilgeräten (ehemals Bard) getrennt und verschieden ist. Die Gemini-Apps sind lediglich eine Schnittstelle, über die auf bestimmte Gemini-Modelle zugegriffen werden kann – stellen Sie sich das als einen Client für Googles GenAI vor.

Übrigens sind die Gemini-Apps und -Modelle auch völlig unabhängig von Imagen 2, dem Text-zu-Bild-Modell von Google, das in einigen Entwicklungstools und -umgebungen des Unternehmens verfügbar ist.

Was können Zwillinge tun?

Da die Gemini-Modelle multimodal sind, können sie theoretisch eine Reihe multimodaler Aufgaben ausführen, von der Transkription von Sprache über das Untertiteln von Bildern und Videos bis hin zur Erstellung von Kunstwerken. Einige dieser Funktionen haben bereits das Produktstadium erreicht (mehr dazu später), und Google verspricht sie alle – und noch mehr – irgendwann in nicht allzu ferner Zukunft.

Natürlich ist es etwas schwierig, das Unternehmen beim Wort zu nehmen.

Google hat bei der ursprünglichen Einführung von Bard deutlich zu wenig geliefert. Und vor kurzem sorgte ein Video für Aufsehen, das angeblich die Fähigkeiten von Gemini demonstrieren sollte, sich aber als stark manipuliert und mehr oder weniger ehrgeizig herausstellte.

Unter der Annahme, dass Google mit seinen Behauptungen mehr oder weniger wahr ist, können die verschiedenen Gemini-Stufen Folgendes tun, sobald sie ihr volles Potenzial erreicht haben:

Zwillinge Ultra

Google sagt, dass Gemini Ultra dank seiner Multimodalität zum Beispiel bei Physik-Hausaufgaben, der schrittweisen Lösung von Problemen auf einem Arbeitsblatt und dem Hinweis auf mögliche Fehler in bereits ausgefüllten Antworten eingesetzt werden kann.

Gemini Ultra kann laut Google auch auf Aufgaben wie die Identifizierung wissenschaftlicher Arbeiten angewendet werden, die für ein bestimmtes Problem relevant sind – das Extrahieren von Informationen aus diesen Arbeiten und das „Aktualisieren“ eines Diagramms daraus durch Generieren der Formeln, die erforderlich sind, um das Diagramm mit neueren Daten neu zu erstellen .

Gemini Ultra unterstützt die Bilderzeugung technisch, wie bereits erwähnt. Diese Funktion hat jedoch noch keinen Eingang in die Produktversion des Modells gefunden – vielleicht, weil der Mechanismus komplexer ist als die Art und Weise, wie Apps wie ChatGPT Bilder generieren. Anstatt Eingabeaufforderungen an einen Bildgenerator weiterzuleiten (wie DALL-E 3 im Fall von ChatGPT), gibt Gemini Bilder „nativ“ aus, ohne einen Zwischenschritt.

Gemini Ultra ist als API über Vertex AI, Googles vollständig verwaltete KI-Entwicklerplattform, und AI Studio, Googles webbasiertes Tool für App- und Plattformentwickler, verfügbar. Es betreibt auch die Gemini-Apps – allerdings nicht kostenlos. Für den Zugriff auf Gemini Ultra über das, was Google Gemini Advanced nennt, ist ein Abonnement des Google One AI Premium-Plans zum Preis von 20 US-Dollar pro Monat erforderlich.

Der AI Premium-Plan verbindet Gemini auch mit Ihrem umfassenderen Google Workspace-Konto – denken Sie an E-Mails in Gmail, Dokumente in Docs, Präsentationen in Tabellen und Google Meet-Aufzeichnungen. Dies ist beispielsweise nützlich, um E-Mails zusammenzufassen oder Gemini während eines Videoanrufs Notizen machen zu lassen.

Zwillinge Pro

Laut Google stellt Gemini Pro eine Verbesserung gegenüber LaMDA hinsichtlich seiner Argumentations-, Planungs- und Verständnisfähigkeiten dar.

Ein Unabhängiger Studie von Carnegie Mellon und BerriAI-Forscher fanden heraus, dass die erste Version von Gemini Pro tatsächlich längere und komplexere Argumentationsketten besser handhaben konnte als GPT-3.5 von OpenAI. Die Studie ergab jedoch auch, dass diese Version von Gemini Pro, wie alle großen Sprachmodelle, besonders Probleme mit mathematischen Problemen mit mehreren Ziffern hatte und Benutzer Beispiele für schlechtes Denken und offensichtliche Fehler fanden.

Google versprach jedoch Abhilfe – und die erste kam in Form von Gemini 1.5 Pro.

Gemini 1.5 Pro ist als Ersatz konzipiert und weist gegenüber seinem Vorgänger in mehreren Bereichen Verbesserungen auf, vor allem aber hinsichtlich der Datenmenge, die es verarbeiten kann. Gemini 1.5 Pro kann ca. 700.000 Wörter oder ca. 30.000 Codezeilen aufnehmen – das 35-fache der Menge, die Gemini 1.0 Pro verarbeiten kann. Und da das Modell multimodal ist, ist es nicht auf Text beschränkt. Gemini 1.5 Pro kann bis zu 11 Stunden Audio oder eine Stunde Video in verschiedenen Sprachen analysieren, wenn auch langsam (z. B. dauert die Verarbeitung einer Szene in einem einstündigen Video 30 Sekunden bis eine Minute).

Gemini 1.5 Pro wurde im April als öffentliche Vorschau auf Vertex AI vorgestellt.

Ein zusätzlicher Endpunkt, Gemini Pro Vision, kann Text verarbeiten Und Bilder – einschließlich Fotos und Videos – und Ausgabetext nach dem Vorbild des GPT-4 mit Vision-Modells von OpenAI.

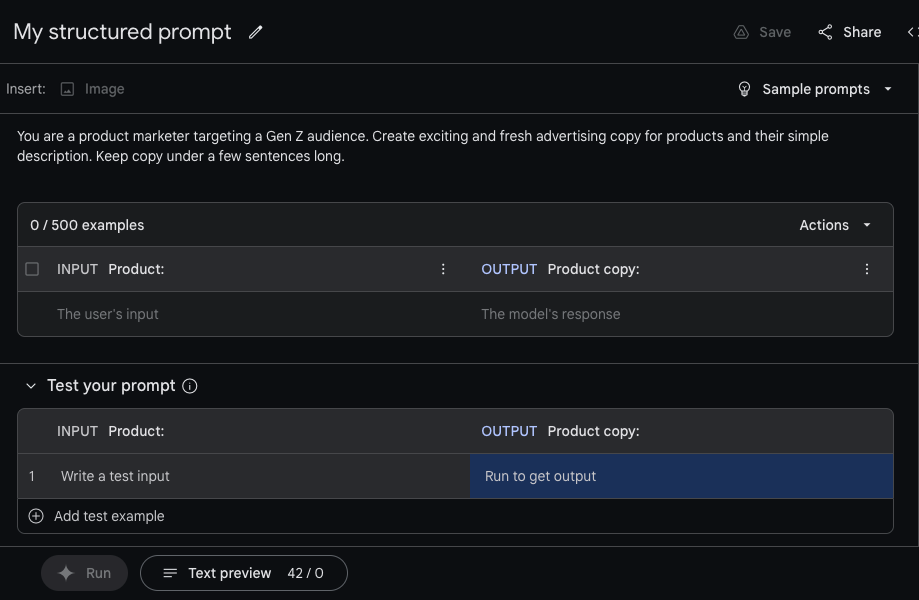

Verwendung von Gemini Pro in Vertex AI. Bildnachweis: Zwillinge

Innerhalb von Vertex AI können Entwickler Gemini Pro mithilfe eines Feinabstimmungs- oder „Grounding“-Prozesses an bestimmte Kontexte und Anwendungsfälle anpassen. Gemini Pro kann auch mit externen APIs von Drittanbietern verbunden werden, um bestimmte Aktionen auszuführen.

In AI Studio gibt es Workflows zum Erstellen strukturierter Chat-Eingabeaufforderungen mit Gemini Pro. Entwickler haben Zugriff auf die Endpunkte Gemini Pro und Gemini Pro Vision und können die Modelltemperatur anpassen, um den kreativen Bereich der Ausgabe zu steuern, Beispiele für Ton- und Stilanweisungen bereitstellen – und auch die Sicherheitseinstellungen optimieren.

Zwillinge Nano

Gemini Nano ist eine viel kleinere Version der Modelle Gemini Pro und Ultra und effizient genug, um direkt auf (einigen) Telefonen ausgeführt zu werden, anstatt die Aufgabe irgendwo an einen Server zu senden. Bisher unterstützt es einige Funktionen auf dem Pixel 8 Pro, Pixel 8 und Samsung Galaxy S24, darunter „Zusammenfassen im Recorder“ und „Smart Reply“ in Gboard.

Die Recorder-App, mit der Benutzer per Knopfdruck Audio aufnehmen und transkribieren können, enthält eine von Gemini bereitgestellte Zusammenfassung Ihrer aufgezeichneten Gespräche, Interviews, Präsentationen und anderen Ausschnitte. Benutzer erhalten diese Zusammenfassungen auch dann, wenn kein Signal oder keine WLAN-Verbindung verfügbar ist – und aus Datenschutzgründen verlassen dabei keine Daten ihr Telefon.

Gemini Nano ist auch in Gboard, der Tastatur-App von Google, enthalten. Dort wird eine Funktion namens „Smart Reply“ aktiviert, die dabei hilft, das nächste Wort vorzuschlagen, das Sie sagen möchten, wenn Sie ein Gespräch in einer Messaging-App führen. Die Funktion funktioniert zunächst nur mit WhatsApp, wird aber im Laufe der Zeit in weiteren Apps verfügbar sein, sagt Google.

Und in der Google Messages-App auf unterstützten Geräten aktiviert Nano Magic Compose, das Nachrichten in Stilen wie „aufgeregt“, „formell“ und „lyrisch“ erstellen kann.

Ist Gemini besser als GPT-4 von OpenAI?

Google hat mehrere Male angepriesen Geminis Überlegenheit bei Benchmarks und behauptet, dass Gemini Ultra die aktuellen Ergebnisse auf dem neuesten Stand der Technik bei „30 der 32 weit verbreiteten akademischen Benchmarks, die in der Forschung und Entwicklung großer Sprachmodelle verwendet werden“ übertrifft. Das Unternehmen gibt an, dass Gemini 1.5 Pro in einigen Szenarien bei Aufgaben wie dem Zusammenfassen von Inhalten, Brainstorming und Schreiben besser geeignet ist als Gemini Ultra; vermutlich wird sich das mit der Veröffentlichung des nächsten Ultra-Modells ändern.

Abgesehen von der Frage, ob Benchmarks wirklich auf ein besseres Modell hinweisen, scheinen die von Google erzielten Ergebnisse nur unwesentlich besser zu sein als die entsprechenden Modelle von OpenAI. Und – wie bereits erwähnt – einige der ersten Eindrücke waren nicht besonders gut, bei den Benutzern und Akademiker weist darauf hin, dass die ältere Version von Gemini Pro dazu neigt, grundlegende Fakten falsch zu verstehen, Schwierigkeiten mit Übersetzungen hat und schlechte Codierungsvorschläge macht.

Wie viel kostet Zwillinge?

Gemini 1.5 Pro kann kostenlos in den Gemini-Apps und derzeit auch in AI Studio und Vertex AI verwendet werden.

Sobald Gemini 1.5 Pro jedoch die Vorschau in Vertex verlässt, kostet das Modell 0,0025 US-Dollar pro Zeichen, während die Ausgabe 0,00005 US-Dollar pro Zeichen kostet. Vertex-Kunden zahlen pro 1.000 Zeichen (ca. 140 bis 250 Wörter) und bei Modellen wie Gemini Pro Vision pro Bild (0,0025 $).

Nehmen wir an, ein Artikel mit 500 Wörtern enthält 2.000 Zeichen. Die Zusammenfassung dieses Artikels mit Gemini 1.5 Pro würde 5 US-Dollar kosten. In der Zwischenzeit würde die Erstellung eines Artikels ähnlicher Länge 0,1 US-Dollar kosten.

Die Ultra-Preise müssen noch bekannt gegeben werden.

Wo kann man Gemini ausprobieren?

Zwillinge Pro

Der einfachste Ort, um Gemini Pro zu erleben, sind die Gemini-Apps. Pro und Ultra beantworten Anfragen in verschiedenen Sprachen.

Gemini Pro und Ultra sind auch in der Vorschau in Vertex AI über eine API zugänglich. Die Nutzung der API ist vorerst „innerhalb der Grenzen“ kostenlos und unterstützt bestimmte Regionen, darunter Europa, sowie Funktionen wie Chat-Funktionalität und Filterung.

An anderer Stelle sind Gemini Pro und Ultra in AI Studio zu finden. Mit dem Dienst können Entwickler Eingabeaufforderungen und Gemini-basierte Chatbots iterieren und dann API-Schlüssel erhalten, um sie in ihren Apps zu verwenden – oder den Code in eine IDE mit umfassenderem Funktionsumfang exportieren.

Code Assist (früher Duet AI für Entwickler), Googles Suite KI-gestützter Hilfstools zur Codevervollständigung und -generierung, verwendet Gemini-Modelle. Entwickler können „groß angelegte“ Änderungen über Codebasen hinweg durchführen, beispielsweise dateiübergreifende Abhängigkeiten aktualisieren und große Codeblöcke überprüfen.

Google hat Gemini-Modelle in seine Entwicklungstools für Chrome und die mobile Entwicklungsplattform Firebase sowie in seine Tools zur Datenbankerstellung und -verwaltung integriert. Und es hat neue Sicherheitsprodukte auf den Markt gebracht, die von Gemini unterstützt werden Gemini in Threat Intelligence, eine Komponente der Mandiant-Cybersicherheitsplattform von Google, die große Teile potenziell bösartigen Codes analysieren und es Benutzern ermöglichen kann, in natürlicher Sprache nach aktuellen Bedrohungen oder Anzeichen einer Gefährdung zu suchen.