„Ich möchte die jüngsten Probleme mit problematischen Text- und Bildantworten in der Gemini-App ansprechen“, schrieb Pichai in einem Brief an die Mitarbeiter, der von der Nachrichten-Website Semafor veröffentlicht wurde.

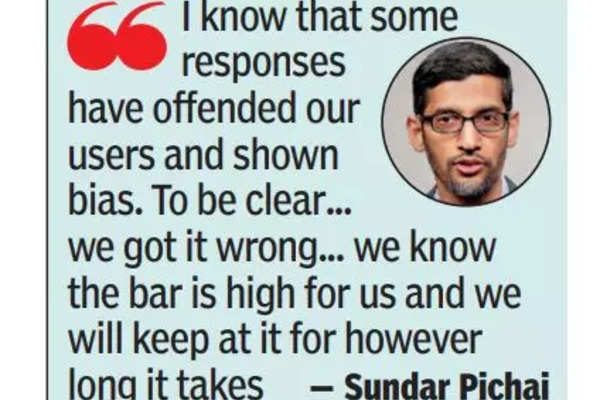

„Ich weiß, dass einige seiner Antworten unsere Nutzer beleidigt und voreingenommen gezeigt haben – um es klarzustellen: Das ist völlig inakzeptabel und wir haben uns geirrt“, fügte er hinzu.

Die Kontroverse entstand innerhalb weniger Wochen, nachdem Google seine KI im ChatGPT-Stil aufsehenerregend in „Gemini“ umbenannt hatte. Social-Media-Nutzer verspotteten und kritisierten das Unternehmen für die historisch ungenauen, von Gemini generierten Bilder, wie etwa US-Senatoren aus dem 19. Jahrhundert, die ethnisch vielfältig waren und Frauen zeigten.

In Indien warnte IT-Minister Ashwini Vaishnaw am vergangenen Montag, Tage nachdem Gemini wegen seiner unbegründeten Anschuldigungen als Reaktion auf eine Anfrage an Premierminister Modi heftig kritisiert wurde, dass die Regierung jegliche rassistischen und anderen Vorurteile beim Betrieb von Plattformen, die auf KI basieren, „nicht tolerieren“ werde .

Die Teams von Google arbeiten rund um die Uhr an der Behebung von Gemini-Problemen: Pichai

Ein Google-Sprecher bestätigte gegenüber AFP, dass Sundar Pichais Brief an die Mitarbeiter authentisch sei.

Pichai sagte, die Google-Teams arbeiteten „rund um die Uhr“, um diese Probleme zu beheben, sagte jedoch nicht, wann die Funktion zur Bildgenerierung wieder verfügbar sein würde. „Keine KI ist perfekt, insbesondere in diesem aufstrebenden Entwicklungsstadium der Branche, aber wir wissen, dass die Messlatte für uns hoch liegt und wir werden daran festhalten, egal wie lange es dauert“, schrieb er.

Indiens Kommunikations- und IT-Minister Ashwini Vaishnaw hatte gewarnt, dass die Regierung jegliche rassistischen und anderen Vorurteile beim Betrieb von Plattformen, die auf KI basieren, „nicht tolerieren“ werde. Er hatte gesagt, dass Unternehmen wie Google, die KI-basierte Lösungen entwickeln, die zugrunde liegenden Modelle, die ihre Plattformen betreiben, „richtig“ trainieren müssen, um Vorurteile und Fehlinformationen zu vermeiden. Die Ansichten des Kabinettsministers folgten einer ähnlichen Kritik des Staatsministers für IT und Elektronik Rajeev Chandrasekhar, der die von Gemini vorgelegten Ergebnisse als „Verstöße“ gegen bestimmte Bestimmungen des IT-Gesetzes sowie des Strafgesetzbuchs bezeichnete.

Technologieunternehmen sehen in generativen Modellen der künstlichen Intelligenz den nächsten großen Schritt in der Datenverarbeitung und bemühen sich darum, sie in alle Bereiche einzubauen, von der Suche im Internet über die Automatisierung des Kundensupports bis hin zur Erstellung von Musik und Kunst.

Aber KI-Modelle, und nicht nur die von Google, stehen seit langem in der Kritik, dass sie in ihren Ergebnissen rassistische und geschlechtsspezifische Vorurteile aufrechterhalten. Google sagte letzte Woche, dass die problematischen Antworten von Gemini auf die Bemühungen des Unternehmens zurückzuführen seien, solche Vorurteile zu beseitigen. „Gemini war darauf ausgerichtet, unterschiedliche Menschen zu zeigen, passte sich aber nicht an Eingabeaufforderungen an, bei denen dies nicht der Fall sein sollte, und wurde auch bei einigen ansonsten harmlosen Anfragen zu vorsichtig“, schrieb Prabhakar Raghavan von Google in einem Blogbeitrag. „Diese beiden Dinge führten dazu, dass das Modell in einigen Fällen überkompensierte und in anderen zu konservativ war, was zu Bildern führte, die peinlich und falsch waren“, sagte er. Seit dem explosiven Erfolg von ChatGPT sind viele Bedenken hinsichtlich der KI aufgetaucht.

Experten und Regierungen haben gewarnt, dass KI auch das Risiko großer wirtschaftlicher Umwälzungen, insbesondere der Verdrängung von Arbeitsplätzen, und Desinformation im industriellen Maßstab birgt, die Wahlen manipulieren und Gewalt auslösen können.