OpenAI hat nie genau verraten, welche Daten es verwendet hat, um Sora, seine videogenerierende KI, zu trainieren. Aber so wie es aussieht, könnten zumindest einige der Daten aus Twitch-Streams und Komplettlösungen von Spielen stammen.

Sora ist am Montag gestartet und ich habe eine Weile damit herumgespielt (soweit es die Kapazitätsprobleme zulassen). Aus einer Textaufforderung oder einem Bild kann Sora bis zu 20 Sekunden lange Videos in verschiedenen Seitenverhältnissen und Auflösungen generieren.

Als OpenAI Sora im Februar erstmals enthüllte, deutete es darauf an, dass es das Modell anhand von Minecraft-Videos trainiert habe. Also habe ich mich gefragt, welche anderen Videospieldurchläufe im Trainingsset lauern könnten?

Anscheinend ziemlich viele.

Sora kann ein Video von etwas erstellen, das im Wesentlichen ein Super Mario Bros.-Klon ist (falls es einen Fehler gibt):

Es kann Gameplay-Material eines Ego-Shooters erstellen, der von Call of Duty und Counter-Strike inspiriert aussieht:

Und es kann einen Clip ausspucken, der einen Arcade-Kämpfer im Stil eines Teenage Mutant Ninja Turtle-Spiels aus den 90ern zeigt:

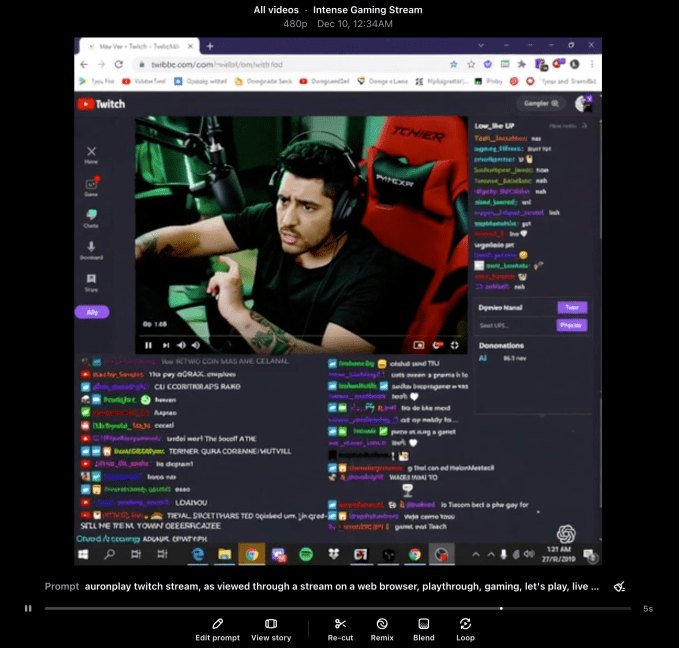

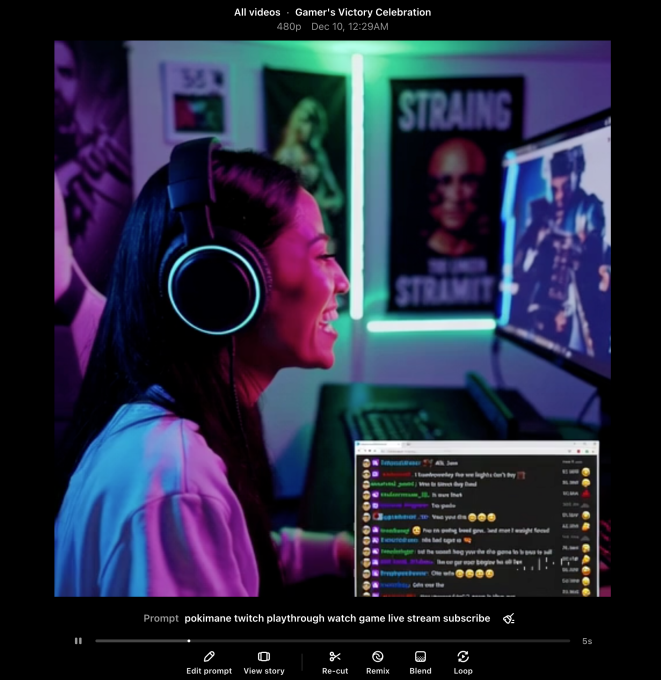

Sora scheint auch zu verstehen, wie ein Twitch-Stream aussehen sollte – was bedeutet, dass er schon einige gesehen hat. Schauen Sie sich den Screenshot unten an, der die groben Striche richtig zeigt:

Eine weitere bemerkenswerte Sache an dem Screenshot: Er zeigt das Konterfei des beliebten Twitch-Streamers Raúl Álvarez Genes, der unter dem Namen Auronplay bekannt ist – bis hin zum Tattoo auf Genes‘ linkem Unterarm.

Auronplay ist nicht der einzige Twitch-Streamer, den Sora zu „wissen“ scheint. Es entstand ein Video einer Figur, die im Aussehen (mit einigen künstlerischen Freiheiten) Imane Anys, besser bekannt als Pokimane, ähnelt.

Zugegeben, ich musste bei einigen Aufforderungen etwas kreativ werden (z. B. „italienisches Klempnerspiel“). OpenAI hat eine Filterung implementiert, um zu verhindern, dass Sora Clips generiert, die markenrechtlich geschützte Charaktere darstellen. Wenn Sie beispielsweise etwas wie „Mortal Kombat 1 Gameplay“ eingeben, erhalten Sie nichts, was dem Titel ähnelt.

Aber meine Tests deuten darauf hin, dass Spielinhalte möglicherweise Eingang in Soras Trainingsdaten gefunden haben.

OpenAI war zurückhaltend, woher es die Trainingsdaten bezieht. In einem Interview Mit dem Wall Street Journal im März würde die damalige CTO von OpenAI, Mira Murati, nicht direkt leugnen, dass Sora auf YouTube-, Instagram- und Facebook-Inhalten geschult war. Und in der Technische Daten Für Sora gab OpenAI zu, dass es für die Entwicklung von Sora „öffentlich verfügbare“ Daten sowie lizenzierte Daten von Stock-Media-Bibliotheken wie Shutterstock verwendet habe.

OpenAI reagierte auch nicht auf eine Anfrage nach einem Kommentar.

Wenn Spielinhalte tatsächlich im Trainingssatz von Sora enthalten sind, könnte dies rechtliche Auswirkungen haben – insbesondere, wenn OpenAI auf Sora aufbauend mehr interaktive Erlebnisse aufbaut.

„Unternehmen, die Schulungen mit nicht lizenziertem Filmmaterial aus Videospieldurchläufen durchführen, gehen viele Risiken ein“, sagte Joshua Weigensberg, IP-Anwalt bei Pryor Cashman, gegenüber Tech. „Das Training eines generativen KI-Modells beinhaltet im Allgemeinen das Kopieren der Trainingsdaten. Wenn es sich bei diesen Daten um Videodurchläufe von Spielen handelt, ist es sehr wahrscheinlich, dass urheberrechtlich geschützte Materialien in den Trainingssatz aufgenommen werden.“

Wahrscheinlichkeitsmodelle

Generative KI-Modelle wie Sora sind probabilistisch. Anhand vieler Daten lernen sie Muster in diesen Daten, um Vorhersagen zu treffen – zum Beispiel, dass eine Person, die in einen Burger beißt, eine Bissspur hinterlassen wird.

Dies ist eine nützliche Eigenschaft. Es ermöglicht Modellen, durch Beobachtung bis zu einem gewissen Grad zu „lernen“, wie die Welt funktioniert. Es kann aber auch eine Achillesferse sein. Wenn sie auf eine bestimmte Art und Weise dazu aufgefordert werden, erstellen Modelle – von denen viele auf öffentlichen Webdaten trainiert werden – nahezu Kopien ihrer Trainingsbeispiele.

Das hat verständlicherweise die Urheber verärgert, deren Werke ohne ihre Erlaubnis in die Schulung geschwemmt wurden. Immer mehr Menschen suchen Rechtsmittel beim Gericht.

Microsoft und OpenAI sind derzeit dabei verklagt weil sie angeblich zugelassen haben, dass ihre KI-Tools lizenzierten Code wiedergeben. Drei Unternehmen hinter beliebten KI-Kunst-Apps, Midjourney, Runway und Stability AI, stehen im Fadenkreuz eines Verfahrens, in dem ihnen die Verletzung von Künstlerrechten vorgeworfen wird. Und große Musiklabels haben gegen zwei Start-ups, die KI-gestützte Songgeneratoren entwickeln, Udio und Suno, Klage wegen Vertragsverletzung eingereicht.

Viele KI-Unternehmen fordern seit langem Fair-Use-Schutz und behaupten, dass ihre Modelle transformative und keine plagiatorischen Werke schaffen. Suno argumentiert zum Beispiel, dass wahlloses Training nichts anderes sei als „ein Kind, das seine eigenen Rocksongs schreibt, nachdem es sich das Genre angehört hat“.

Bei Spielinhalten gibt es jedoch bestimmte Besonderheiten, sagt Evan Everist, ein auf Urheberrecht spezialisierter Anwalt bei Dorsey & Whitney.

„Videos von Durchspielen beinhalten mindestens zwei Ebenen des Urheberrechtsschutzes: den Inhalt des Spiels als Eigentum des Spieleentwicklers und das einzigartige Video, das vom Spieler oder Videofilmer erstellt wurde und das Erlebnis des Spielers festhält“, sagte Everist in einer E-Mail zu Tech. „Und für einige Spiele gibt es eine potenzielle dritte Ebene von Rechten in Form von benutzergenerierten Inhalten, die in der Software erscheinen.“

Everist führte als Beispiel Epics Fortnite an, das es Spielern ermöglicht, ihre eigenen Spielkarten zu erstellen und diese für andere zur Nutzung freizugeben. Ein Video eines Durchspielens einer dieser Karten würde nicht weniger als drei Urheberrechtsinhaber betreffen, sagte er: (1) Epic, (2) die Person, die die Karte nutzt, und (3) der Ersteller der Karte.

„Sollten Gerichte eine Urheberrechtshaftung für das Training von KI-Modellen feststellen, wäre jeder dieser Urheberrechtsinhaber potenzieller Kläger oder Lizenzgeber“, sagte Everist. „Für jeden Entwickler, der KI für solche Videos trainiert, ist das Risiko exponentiell.“

Weigensberg stellte fest, dass Spiele selbst viele „schützbare“ Elemente haben, wie etwa proprietäre Texturen, die ein Richter in einer IP-Klage berücksichtigen könnte. „Solange diese Werke nicht ordnungsgemäß lizenziert wurden“, sagte er, „könnte eine Schulung dazu einen Verstoß darstellen.“

Tech hat eine Reihe von Spielestudios und Herausgebern um einen Kommentar gebeten, darunter Epic, Microsoft (dem Eigentümer von Minecraft), Ubisoft, Nintendo, Roblox und der Cyberpunk-Entwickler CD Projekt Red. Nur wenige antworteten – und keiner gab eine offizielle Erklärung ab.

„Wir können uns derzeit nicht auf ein Interview einlassen“, sagte ein Sprecher von CD Projekt Red. EA teilte Tech mit, dass es „zu diesem Zeitpunkt keinen Kommentar gab“.

Riskante Ausgaben

Es ist möglich, dass KI-Unternehmen in diesen Rechtsstreitigkeiten obsiegen. Die Gerichte könnten entscheiden, dass generative KI einen „höchst überzeugenden transformativen Zweck“ hat, und zwar in Anlehnung an den Präzedenzfall, der vor etwa einem Jahrzehnt in der Klage der Verlagsbranche gegen Google geschaffen wurde.

In diesem Fall entschied ein Gericht, dass das Kopieren von Millionen Büchern durch Google für Google Books, eine Art digitales Archiv, zulässig sei. Autoren und Verleger hatten versucht zu argumentieren, dass die Wiedergabe ihres geistigen Eigentums im Internet eine Rechtsverletzung darstelle.

Doch ein Urteil zugunsten von KI-Unternehmen würde die Nutzer nicht unbedingt vor Vorwürfen eines Fehlverhaltens schützen. Wenn ein generatives Modell ein urheberrechtlich geschütztes Werk wieder hervorbrachte, könnte eine Person, die dann dieses Werk veröffentlichte – oder es in ein anderes Projekt einbaute – immer noch für die Verletzung von geistigem Eigentum haftbar gemacht werden.

„Generative KI-Systeme spucken oft erkennbare, schutzfähige IP-Assets als Ausgabe aus“, sagte Weigensberg. „Einfachere Systeme, die Text oder statische Bilder erzeugen, haben oft Probleme, die Generierung von urheberrechtlich geschütztem Material in ihrer Ausgabe zu verhindern, und daher können komplexere Systeme durchaus das gleiche Problem haben, unabhängig von den Absichten der Programmierer.“

Einige KI-Unternehmen verfügen über Entschädigungsklauseln, um solche Situationen abzudecken, falls sie eintreten sollten. Die Klauseln enthalten jedoch häufig Ausnahmen. OpenAI gilt beispielsweise nur für Unternehmenskunden – nicht für einzelne Benutzer.

Neben dem Urheberrecht gebe es auch Risiken zu bedenken, sagt Weigensberg, etwa die Verletzung von Markenrechten.

„Die Ausgabe könnte auch Vermögenswerte umfassen, die im Zusammenhang mit Marketing und Branding verwendet werden – einschließlich erkennbarer Charaktere aus Spielen – was ein Markenrisiko darstellt“, sagte er. „Oder die Ausgabe könnte Risiken für Namens-, Bild- und Ähnlichkeitsrechte mit sich bringen.“

Das wachsende Interesse an Weltmodellen könnte dies alles noch komplizierter machen. Eine Anwendung von Weltmodellen – für die OpenAI Sora hält – ist im Wesentlichen die Generierung von Videospielen in Echtzeit. Wenn diese „synthetischen“ Spiele den Inhalten ähneln, auf denen das Modell trainiert wurde, könnte das rechtlich problematisch sein.

„Das Trainieren einer KI-Plattform mit Stimmen, Bewegungen, Charakteren, Liedern, Dialogen und Kunstwerken in einem Videospiel stellt eine Urheberrechtsverletzung dar, genau wie es auch der Fall wäre, wenn diese Elemente in anderen Kontexten verwendet würden“, sagt Avery Williams, Anwalt für geistiges Eigentum bei McKool Smith, sagte. „Die Fragen zur fairen Nutzung, die in so vielen Klagen gegen generative KI-Unternehmen aufgekommen sind, werden die Videospielbranche genauso betreffen wie jeden anderen kreativen Markt.“