Mit einer so schnelllebigen Branche wie der KI Schritt zu halten, ist eine große Herausforderung. Bis eine KI dies für Sie erledigen kann, finden Sie hier eine praktische Zusammenfassung der neuesten Geschichten aus der Welt des maschinellen Lernens sowie bemerkenswerte Forschungsergebnisse und Experimente, die wir nicht alleine behandelt haben.

Letzte Woche hat Meta während seiner jährlichen Connect-Konferenz eine Reihe neuer KI-gestützter Chatbots für seine Messaging-Apps vorgestellt – WhatsApp, Messenger und Instagram-DMs. Die Bots sind für ausgewählte Benutzer in den USA verfügbar und darauf abgestimmt, bestimmte Persönlichkeiten zu kanalisieren und Prominente wie Kendall Jenner, Dwyane Wade, MrBeast, Paris Hilton, Charli D’Amelio und Snoop Dogg nachzuahmen.

Die Bots sind Metas jüngster Versuch, das Engagement auf seiner gesamten Plattformfamilie zu steigern, insbesondere bei einer jüngeren Bevölkerungsgruppe. (Laut einem Pew Research Center aus dem Jahr 2022 Umfragenur etwa 32 % der Internetnutzer im Alter von 13 bis 17 Jahren geben an, jemals Facebook zu nutzen, ein Rückgang von über 50 % im Vergleich zum Vorjahr.) Aber die KI-gestützten Persönlichkeiten spiegeln auch einen umfassenderen Trend wider: die wachsende Beliebtheit von „charaktergesteuerte“ KI.

Betrachten Sie Character.AI, das anpassbare KI-Begleiter mit unterschiedlichen Persönlichkeiten bietet, wie Charli D’Amelio als Tanzbegeisterte oder Chris Paul als Profigolfer. In diesem Sommer verzeichnete die mobile App von Character.AI in weniger als einer Woche über 1,7 Millionen Neuinstallationen, während die Web-App mehr als 200 Millionen Besuche pro Monat verzeichnete. Character.AI behauptete außerdem, dass Benutzer im Mai durchschnittlich 29 Minuten pro Besuch verbrachten – eine Zahl, die nach Angaben des Unternehmens die ChatGPT-Nutzung von OpenAI um 300 % übertraf abgelehnt.

Diese Viralität zog Unterstützer an, darunter Andreessen Horowitz, der weit über 100 Millionen US-Dollar an Risikokapital in Character.AI steckte, das zuletzt einen Wert von 1 Milliarde US-Dollar hatte.

An anderer Stelle gibt es Replika, die umstrittene KI-Chatbot-Plattform, die im März rund 2 Millionen Nutzer hatte – davon 250.000 zahlende Abonnenten.

Das ist nicht zu erwähnen Inworld, eine weitere Erfolgsgeschichte von KI-gesteuerten Charakteren, die eine Plattform für die Erstellung dynamischerer NPCs in Videospielen und anderen interaktiven Erlebnissen entwickelt. Bisher hat Inworld nicht viel über Nutzungsmetriken mitgeteilt. Aber das Versprechen ausdrucksstärkerer, organischer Charaktere, die durch KI gesteuert werden, hat zu Inworld-Investitionen von Disney und Zuschüssen von Fortnite und dem Unreal Engine-Entwickler Epic Games geführt.

Es ist also klar, dass KI-gestützte Chatbots mit Persönlichkeiten etwas zu bieten haben. Aber was ist es?

Ich würde wetten, dass Chatbots wie ChatGPT und Claude zwar unbestreitbar in ausgesprochen professionellen Kontexten nützlich sind, aber nicht den gleichen Reiz haben wie „Charaktere“. Ehrlich gesagt sind sie nicht so interessant – und das ist keine Überraschung. Allzweck-Chatbots wurden entwickelt, um bestimmte Aufgaben zu erledigen und nicht, um ein belebendes Gespräch zu führen.

Aber die Frage ist: Werden KI-gestützte Charaktere einen langen Atem haben? Das hofft Meta sicherlich, wenn man bedenkt, welche Ressourcen es in seine neue Bot-Sammlung investiert. Ich bin mir selbst nicht sicher – wie bei den meisten Technologien besteht eine gute Chance, dass die Neuheit irgendwann nachlässt. Und dann geht es weiter mit dem nächsten großen Ding – was auch immer das letztendlich sein wird.

Hier sind einige andere bemerkenswerte KI-Geschichten der letzten Tage:

- Spotify testet KI-generierte Playlists: Hinweise, die im Code der Spotify-App entdeckt wurden, deuten darauf hin, dass das Unternehmen möglicherweise generative KI-Wiedergabelisten entwickelt, die Benutzer mithilfe von Eingabeaufforderungen erstellen könnten, berichtet Sarah.

- Wie viel verdienen Künstler mit generativer KI? Wer weiß? Einige Anbieter generativer KI, wie etwa Adobe, haben Fonds- und Umsatzbeteiligungsvereinbarungen eingerichtet, um Künstler und andere Mitwirkende für die Datensätze zu bezahlen, die zum Trainieren ihrer generativen KI-Modelle verwendet werden. Aber es ist nicht klar, wie viel diese Künstler tatsächlich verdienen können, erfuhr TC.

- Google erweitert KI-gestützte Suche: Google öffnete sein generatives KI-Sucherlebnis für Teenager und führte eine neue Funktion ein, um den Inhalten, die Nutzer sehen, Kontext hinzuzufügen, sowie ein Update, um das KI-Modell des Sucherlebnisses zu trainieren, um falsche oder anstößige Suchanfragen besser zu erkennen.

- Amazon führt Bedrock in Georgia ein und bringt CodeWhisperer ins Unternehmen: Amazon gab bekannt die allgemeine Verfügbarkeit von Grundgestein, seine verwaltete Plattform, die über eine API eine Auswahl generativer KI-Modelle von Amazon selbst und Drittpartnern bietet. Das Unternehmen hat außerdem eine Unternehmensebene für CodeWhisperer eingeführt, den KI-gestützten Dienst von Amazon zum Generieren und Vorschlagen von Code.

- OpenAI unterhält Hardware: The Information berichtet, dass der berühmte ehemalige Apple-Produktdesigner Jony Ive Gespräche mit OpenAI-CEO Sam Altman über ein mysteriöses KI-Hardwareprojekt führt. In der Zwischenzeit könnte OpenAI – das plant, bald eine leistungsstärkere Version seines GPT-4-Modells mit Bildanalysefunktionen herauszubringen – seinen Sekundärmarktwert auf 90 Milliarden US-Dollar steigern.

- ChatGPT erhält eine Stimme: In anderen OpenAI-Nachrichten hat sich ChatGPT zu viel mehr als einer textbasierten Suchmaschine entwickelt, wie OpenAI ankündigt Vor kurzem wurde bekannt gegeben, dass es dem Mix neue sprach- und bildbasierte Smarts hinzufügt.

- Der Autorenstreik und die KI: Nach fast fünf Monaten einigte sich die Writers Guild of America mit den Hollywood-Studios auf ein Ende des Schriftstellerstreiks. Während des historischen Streiks erwies sich die KI als zentraler Streitpunkt zwischen den Autoren und den Studios. Amanda erläutert die relevanten neuen Vertragsbestimmungen.

- Getty Images führt einen Bildgenerator ein: Getty Images, einer der größten Anbieter von Archivbildern, redaktionellen Fotos, Videos und Musik, wurde gegründet ein generatives KI-Kunstwerkzeug, von dem es behauptet, es sei „kommerziell sicherer“ als andere Konkurrenzlösungen auf dem Markt. Vor der Einführung seines eigenen Tools war Getty ein lautstarker Kritiker generativer KI-Produkte wie Stable Diffusion, das auf einer Teilmenge seiner Bildinhaltsbibliothek trainiert wurde.

- Adobe bringt Gen-KI ins Web: Adobe hat Photoshop für das Web offiziell für alle Benutzer mit kostenpflichtigen Plänen eingeführt. Die Webversion, das sich fast zwei Jahre in der Betaphase befandist jetzt mit Firefly-basierten KI-Tools wie generativem Füllen und generativer Erweiterung verfügbar.

- Amazon investiert Milliarden in Anthropic: Amazon habe zugestimmt, bis zu 4 Milliarden US-Dollar in das KI-Startup Anthropic zu investieren, sagten die beiden Unternehmen, da der E-Commerce-Konzern seine Rivalität mit Microsoft, Meta, Google und Nvidia im schnell wachsenden KI-Sektor verschärft.

Mehr maschinelles Lernen

Als ich mit Anthropic-CEO Dario Amodei über die Fähigkeiten der KI sprach, schien er der Meinung zu sein, dass es, soweit wir wissen, keine harten Grenzen gibt – nicht, dass es überhaupt keine gäbe, aber dass er bisher noch kein (vernünftiges) Problem mit LLMs hatte waren nicht in der Lage, zumindest eine respektable Anstrengung zu unternehmen. Ist es Optimismus oder weiß er, wovon er spricht? Nur die Zeit kann es verraten.

In der Zwischenzeit wird noch viel geforscht. Dieses Projekt von der University of Edinburgh führt neuronale Netze zurück zu ihren Wurzeln: den Neuronen. Nicht die komplexen, subtilen Nervenkomplexe des Menschen, sondern die einfacheren (und dennoch hochwirksamen) der Insekten.

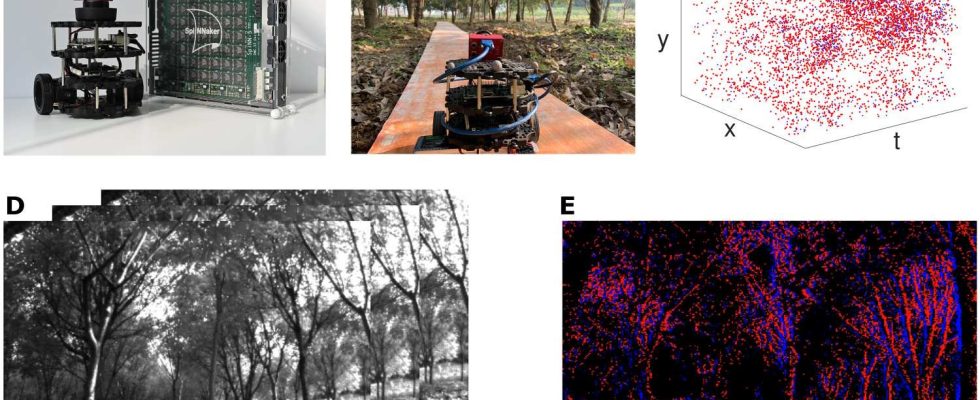

Aus dem Papier ein Diagramm, das Ansichten des Roboters und einige seiner Bildverarbeitungssystemdaten zeigt. Bildnachweis: Universität von Edinburgh

Ameisen und andere kleine Insekten sind trotz ihrer eher rudimentären Seh- und Gedächtnisfähigkeiten bemerkenswert gut darin, sich in komplexen Umgebungen zurechtzufinden. Das Team baute ein digitales Netzwerk auf der Grundlage beobachteter neuronaler Netze von Insekten auf und stellte fest, dass es in der Lage war, einen kleinen Roboter mit sehr wenig Ressourcen erfolgreich visuell zu navigieren. Systeme, in denen Leistung und Größe besonders begrenzt sind, können die Methode möglicherweise rechtzeitig nutzen. Von der Natur kann man immer etwas lernen!

Die Farbwissenschaft ist ein weiterer Bereich, in dem Menschen Maschinen anführen, mehr oder weniger per Definition: Wir sind ständig bestrebt, das, was wir sehen, mit größerer Wiedergabetreue nachzubilden, aber manchmal scheitert dies auf eine Weise, die im Nachhinein vorhersehbar erscheint. Beispielsweise wird der Hautton von Systemen, die auf helle Haut ausgelegt sind, nur unzureichend erfasst – insbesondere, wenn ML-Systeme mit voreingenommenen Trainingssätzen ins Spiel kommen. Wenn ein Bildgebungssystem die Hautfarbe nicht versteht, kann es die Belichtung und Farbe nicht richtig belichten und anpassen.

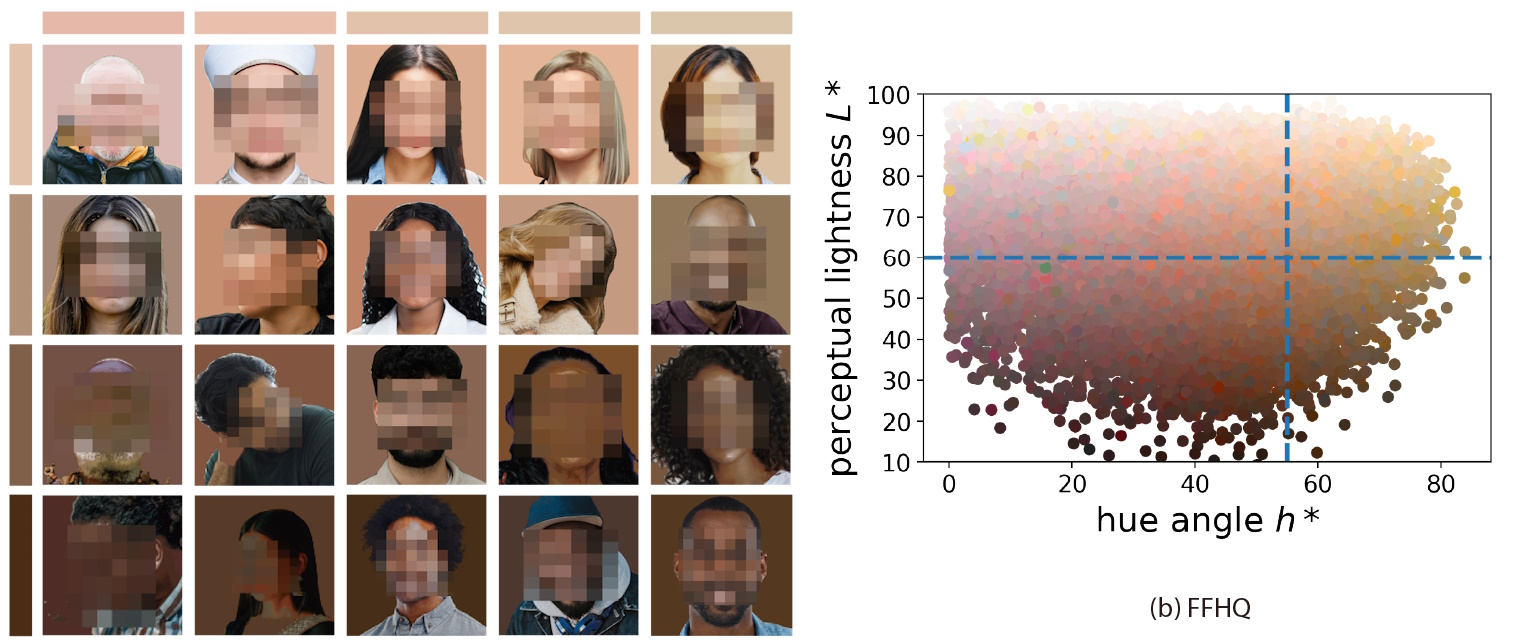

Bilder aus der Sony-Forschung zur umfassenderen Hautfarbenschätzung. Bildnachweis: Sony

Sony möchte diese Systeme mit einer neuen Metrik für die Hautfarbe verbessern, die diese anhand einer Farbskala sowie wahrgenommener Hell-/Dunkelwerte umfassender, aber effizienter definiert. Dabei zeigten sie, dass sich die Voreingenommenheit in bestehenden Systemen nicht nur auf die Helligkeit, sondern auch auf den Hautton erstreckt.

Apropos Reparieren von Fotos: Google verfügt mit ziemlicher Sicherheit über eine neue Technik, die (in einer verfeinerten Form) für seine Pixel-Geräte bestimmt ist, die sich stark auf die Computerfotografie konzentrieren. RealFill ist ein generatives Plug-in, das ein Bild mit „dem, was dort hätte sein sollen“ füllen kann. Wenn bei der besten Aufnahme einer Geburtstagsfeier beispielsweise die Luftballons herausgeschnitten werden, geben Sie dem System die gute Aufnahme und einige andere aus derselben Szene. Es stellt fest, dass sich oben an den Schnüren einige Luftballons befinden „sollten“, und fügt diese mithilfe der Informationen aus den anderen Bildern hinzu.

Bildnachweis: Google

Es ist alles andere als perfekt (es sind immer noch Halluzinationen, nur gut informierte Halluzinationen), aber mit Bedacht eingesetzt könnte es ein wirklich hilfreiches Werkzeug sein. Ist es aber immer noch ein „echtes“ Foto? Nun, darauf wollen wir jetzt nicht näher eingehen.

Schließlich könnten sich Modelle des maschinellen Lernens bei der Vorhersage der Anzahl der Nachbeben nach einem großen Erdbeben als genauer als Menschen erweisen. Deutlich sein (wie die Forscher betonen), geht es hier nicht um die „Vorhersage“ von Erdbeben, sondern darum, sie genau zu charakterisieren, wenn sie auftreten, sodass Sie erkennen können, ob es sich bei der Stärke 5,8 um die Art handelt, die innerhalb einer Stunde zu drei weiteren kleineren Beben führt oder nach 20 Minuten nur zu einem weiteren. Und auch die neuesten Modelle sind immer noch nur unter bestimmten Umständen gut darin – aber falsch liegen sie nicht, und sie können große Datenmengen schnell verarbeiten. Mit der Zeit könnten diese Modelle Seismologen helfen, Erdbeben und Nachbeben besser vorherzusagen, aber wie die Wissenschaftler anmerken, ist es weitaus wichtiger, vorbereitet zu sein; Denn selbst wenn man weiß, dass jemand kommt, kann das nicht verhindern, dass es passiert.