Mit einer so schnelllebigen Branche wie der KI Schritt zu halten, ist eine große Herausforderung. Bis eine KI dies für Sie erledigen kann, finden Sie hier eine praktische Zusammenfassung der Geschichten der letzten Woche in der Welt des maschinellen Lernens sowie bemerkenswerte Forschungsergebnisse und Experimente, die wir nicht alleine behandelt haben.

YouTube hat damit begonnen, mit KI-generierten Zusammenfassungen für Videos auf den Wiedergabe- und Suchseiten zu experimentieren, allerdings nur für eine begrenzte Anzahl englischsprachiger Videos und Zuschauer.

Sicherlich könnten die Zusammenfassungen für die Entdeckung – und Zugänglichkeit – nützlich sein. Nicht jeder Videokünstler kann sich die Mühe machen, eine Beschreibung zu schreiben. Aber ich mache mir Sorgen über das Potenzial für Fehler und Vorurteile, die die KI mit sich bringt.

Selbst die besten KI-Modelle neigen heutzutage zu „Halluzinationen“. OpenAI gibt freimütig zu, dass sein neuestes Textgenerierungs- und -zusammenfassungsmodell, GPT-4, große Denkfehler macht und „Fakten“ erfindet. Patrick Hymel, ein Unternehmer in der Gesundheitstechnologiebranche, geschrieben über die Art und Weise, wie GPT-4 Referenzen, Fakten und Zahlen ohne erkennbaren Bezug zu echten Quellen zusammenstellt. Und schnelle Gesellschaft hat die Fähigkeiten von ChatGPT getestet Artikel zusammenzufassen, es zu finden … ziemlich schlecht.

Angesichts der zusätzlichen Herausforderung, den in den Videos enthaltenen Inhalt zu analysieren, kann man sich vorstellen, dass KI-generierte Videozusammenfassungen übertrieben sind. Es ist schwierig, die Qualität der KI-generierten Zusammenfassungen von YouTube zu beurteilen. Aber es ist allgemein bekannt, dass KI nicht besonders gut darin ist, zusammenzufassen Text Inhalt.

YouTube erkennt unterschwellig an, dass KI-generierte Beschreibungen kein Ersatz für die Realität sind. Auf der Support-Seite heißt es: „Wir hoffen zwar, dass diese Zusammenfassungen hilfreich sind und Ihnen einen schnellen Überblick darüber geben, worum es in einem Video geht, sie ersetzen jedoch nicht die Videobeschreibungen (die von den Erstellern verfasst werden!).“

Wir hoffen, dass die Plattform die Funktion nicht zu voreilig einführt. Aber angesichts der unausgegorenen KI-Produkteinführungen von Google in letzter Zeit (siehe den Versuch gegen einen ChatGPT-Rivalen, Bard), bin ich nicht allzu zuversichtlich.

Hier sind einige andere bemerkenswerte KI-Geschichten der letzten Tage:

Dario Amodei kommt zu Disrupt: Wir werden den Mitbegründer von Anthropic darüber interviewen, wie es ist, so viel Geld zu haben. Und KI-Sachen auch.

Die Google-Suche erhält neue KI-Funktionen: Google fügt kontextbezogene Bilder und Videos zu seinem AI-powered Search Generative Experiment hinzu, der generativen AI-gestützten Suchfunktion, die auf der I/O-Konferenz im Mai angekündigt wurde. Mit den Updates zeigt SGE nun Bilder oder Videos an, die sich auf die Suchanfrage beziehen. Berichten zufolge stellt das Unternehmen sein Assistant-Projekt auch auf eine Bard-ähnliche generative KI um.

Microsoft tötet Cortana: In Anlehnung an die Ereignisse der Halo-Spieleserie, aus der der Name stammt, wurde Cortana zerstört. Glücklicherweise handelte es sich hierbei nicht um eine abtrünnige allgemeine KI, sondern um einen ebenfalls geführten digitalen Assistenten, dessen Zeit gekommen war.

Meta setzt auf generative KI-Musik: Meta wurde diese Woche angekündigt AudioCraftein Framework zur Generierung von „hochwertigem“, „realistischem“ Audio und Musik aus kurzen Textbeschreibungen oder Eingabeaufforderungen.

Google zieht AI Test Kitchen zurück: Google hat seine AI Test Kitchen-App aus dem Play Store und dem App Store entfernt, um sich ausschließlich auf die Webplattform zu konzentrieren. Das Unternehmen hat letztes Jahr das AI Test Kitchen-Erlebnis eingeführt, um Benutzern die Interaktion mit Projekten zu ermöglichen, die auf verschiedenen KI-Modellen wie LaMDA 2 basieren.

Roboter lernen aus kleinen Datenmengen: Was Google betrifft: DeepMind, das KI-fokussierte Forschungslabor des Technologieriesen, hat ein System entwickelt, das es Robotern angeblich ermöglicht, anhand relativ kleiner Datensätze erlernte Konzepte effektiv auf verschiedene Szenarien zu übertragen.

Kickstarter erlässt neue Regeln rund um generative KI: Kickstarter gab diese Woche bekannt, dass Projekte auf seiner Plattform, die KI-Tools zur Generierung von Inhalten verwenden, offenlegen müssen, wie der Projektinhaber die KI-Inhalte in seiner Arbeit verwenden möchte. Darüber hinaus schreibt Kickstarter vor, dass neue Projekte, die die Entwicklung von KI-Technologie betreffen, detaillierte Informationen zu den Trainingsdatenquellen angeben, die der Projektinhaber verwenden möchte.

China geht hart gegen generative KI vor: Mehrere generative KI-Apps wurden diese Woche aus dem China App Store von Apple entfernt, da neue Regeln vorsehen, dass in China betriebene KI-Apps eine Verwaltungslizenz benötigen.

Stable Diffusion veröffentlicht neues Modell: Stability AI brachte Stable Diffusion XL 1.0 auf den Markt, ein Text-zu-Bild-Modell, das das Unternehmen als seine bisher „fortschrittlichste“ Version bezeichnet. Stability behauptet, dass die Bilder des Modells im Vergleich zu den Grafiken des Vorgängers „lebendigere“ und „genauere“ Farben sowie bessere Kontraste, Schatten und Beleuchtung aufweisen.

Die Zukunft der KI ist Video: Zumindest ist es ein großer Teil des generativen KI-Geschäfts, wie Haje es ausdrückt.

AI.com ist von OpenAI auf X.ai umgestiegen: Es ist äußerst unklar, ob es verkauft, vermietet oder Teil eines laufenden Programms ist, aber die begehrte zweibuchstabige Domain (wahrscheinlich im Wert von 5 bis 10 Millionen US-Dollar) weist nun auf Elon Musks X.ai-Forschungseinrichtung und nicht auf die ChatGPT-Schnittstelle hin .

Andere maschinelles Lernen

KI dringt in unzählige wissenschaftliche Bereiche vor, wie ich hier regelmäßig dokumentiere, aber man könnte es verzeihen, wenn man nicht ohne Weiteres mehr als ein paar konkrete Anwendungen aufzählen kann. Diese Literaturübersicht bei Nature ist eine so umfassende Darstellung der Bereiche und Methoden, in denen KI wirksam wird, wie Sie sie wahrscheinlich nirgendwo finden werden, sowie der Fortschritte, die sie ermöglicht haben. Leider ist es kostenpflichtig, aber Sie können wahrscheinlich einen Weg finden, an eine Kopie zu kommen.

Es gibt einen tieferen Einblick in das Potenzial von KI, den globalen Kampf gegen Infektionskrankheiten zu verbessern hier bei Scienceund ein paar Imbissbuden in UPenns Zusammenfassung. Ein interessanter Aspekt ist, dass Modelle zur Vorhersage von Arzneimittelwechselwirkungen auch dazu beitragen könnten, „komplizierte Wechselwirkungen zwischen infektiösen Organismen und dem Immunsystem des Wirts aufzuklären“. Die Pathologie einer Krankheit kann lächerlich kompliziert sein, daher werden Epidemiologen und Ärzte wahrscheinlich jede Hilfe in Anspruch nehmen, die sie bekommen können.

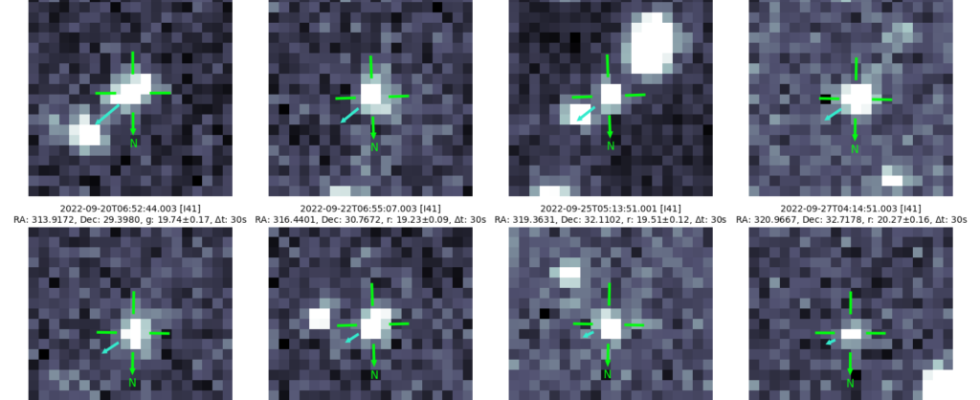

Asteroid gesichtet, Ma’am.

Ein weiteres interessantes Beispiel, mit dem Vorbehalt, dass nicht jeder Algorithmus als KI bezeichnet werden sollte, ist diese multiinstitutionelle Arbeit Algorithmen zur Identifizierung „potenziell gefährlicher“ Asteroiden. Himmelsdurchmusterungen erzeugen eine Menge Daten und diese nach schwachen Signalen wie denen von Asteroiden zu durchsuchen, ist eine harte Arbeit, die sehr anfällig für Automatisierung ist. Der 600 Fuß lange 2022 SF289 wurde bei einem Test des Algorithmus gefunden ATLAS Daten. „Dies ist nur ein kleiner Vorgeschmack darauf, was uns in weniger als zwei Jahren mit dem Rubin-Observatorium erwartet, wenn HelioLinc3D jede Nacht ein Objekt wie dieses entdecken wird“, sagte Mario Jurić von der UW. Ich kann es kaum erwarten!

Eine Art Heiligenschein um die Welt der KI-Forschung ist die durchgeführte Forschung An KI – wie sie funktioniert und warum. Normalerweise sind diese Studien für Nicht-Experten ziemlich schwer zu analysieren, und dieses hier von ETH-Forschern ist keine Ausnahme. Aber auch Hauptautor Johannes von Oswald habe ein Interview gemacht einige der Konzepte in einfachem Englisch erklären. Es ist eine Lektüre wert, wenn Sie neugierig auf den „Lernprozess“ sind, der in Modellen wie ChatGPT abläuft.

Auch die Verbesserung des Lernprozesses ist wichtig, und wie diese Duke-Forscher feststellen, lautet die Antwort nicht immer „mehr Daten“. Tatsächlich können mehr Daten ein maschinelles Lernmodell behindern, sagte Duke-Professor Daniel Reker: „Es ist, als ob man einen Algorithmus darauf trainiert hätte, Bilder von Hunden und Katzen zu unterscheiden, ihm aber eine Milliarde Fotos von Hunden zum Lernen gegeben hätte und nur einhundert.“ Fotos von Katzen. Der Algorithmus wird so gut darin sein, Hunde zu identifizieren, dass alles wie ein Hund aussieht und alles andere auf der Welt vergisst.“ Ihr Ansatz nutzte eine Technik des „aktiven Lernens“, die solche Schwachstellen im Datensatz identifizierte und sich bei der Verwendung von nur 1/10 der Daten als effektiver erwies.

Eine Studie des University College London ergab, dass Menschen nur reale von synthetischer Sprache unterscheiden konnten 73 Prozent der Zeit, sowohl auf Englisch als auch auf Mandarin. Wahrscheinlich werden wir darin alle besser werden, aber in naher Zukunft wird die Technologie unsere Fähigkeit, sie zu erkennen, wahrscheinlich übersteigen. Bleiben Sie frostig da draußen.