Mit einer so schnelllebigen Branche wie der KI Schritt zu halten, ist eine große Herausforderung. Bis eine KI dies für Sie erledigen kann, finden Sie hier eine praktische Zusammenfassung der neuesten Geschichten aus der Welt des maschinellen Lernens sowie bemerkenswerte Forschungsergebnisse und Experimente, die wir nicht alleine behandelt haben.

Diese Woche hat OpenAI im Bereich KI seinen ersten Hochschulkunden gewonnen: die Arizona State University.

Die ASU wird mit OpenAI zusammenarbeiten, um ChatGPT, den KI-gestützten Chatbot von OpenAI, den Forschern, Mitarbeitern und Lehrkräften der Universität zugänglich zu machen. Im Februar veranstaltet sie eine offene Herausforderung, bei der Lehrkräfte und Mitarbeiter aufgefordert werden, Ideen für die Nutzung von ChatGPT einzureichen.

Der OpenAI-ASU-Deal verdeutlicht die wechselnden Meinungen über KI im Bildungsbereich, da die Technologie schneller voranschreitet, als die Lehrpläne mithalten können. Letzten Sommer beeilten sich Schulen und Hochschulen, ChatGPT aus Angst vor Plagiaten und Fehlinformationen zu verbieten. Seitdem haben es einige getan umgedreht ihre Verbote, während andere damit begonnen haben, Workshops zu GenAI-Tools und ihrem Lernpotenzial zu veranstalten.

Die Debatte über die Rolle von GenAI in der Bildung wird wahrscheinlich nicht so schnell beigelegt. Aber – was das wert ist – ich befinde mich zunehmend im Lager der Unterstützer.

Ja, GenAI ist ein Schlechte Zusammenfassung. Es ist voreingenommen und giftig. Es erfindet Dinge. Aber es kann auch gut genutzt werden.

Überlegen Sie, wie ein Tool wie ChatGPT Schülern helfen könnte, die mit einer Hausaufgabe zu kämpfen haben. Es könnte eine mathematische Aufgabe Schritt für Schritt erklären oder eine Aufsatzskizze erstellen. Oder es könnte die Antwort auf eine Frage ans Licht kommen, die bei Google weitaus länger dauern würde.

Nun gibt es berechtigte Bedenken hinsichtlich des Betrugs – oder zumindest dessen, was im Rahmen der heutigen Lehrpläne als Betrug angesehen werden könnte. Ich habe anekdotisch von Studenten gehört, insbesondere von Studenten, die ChatGPT nutzten, um große Mengen an Aufsätzen und Aufsatzfragen zu Tests zum Mitnehmen zu schreiben.

Dies ist kein neues Problem – kostenpflichtige Essay-Schreibdienste gibt es schon seit Ewigkeiten. Einige Pädagogen argumentieren jedoch, dass ChatGPT die Eintrittsbarriere erheblich senkt.

Es gibt Beweis um darauf hinzuweisen, dass diese Befürchtungen übertrieben sind. Aber wenn wir das für einen Moment beiseite lassen, sage ich, dass wir einen Schritt zurücktreten und darüber nachdenken sollten, was Schüler überhaupt zum Betrügen treibt. Schüler werden oft für Noten belohnt, nicht für Mühe oder Verständnis. Die Anreizstruktur ist verzerrt. Ist es dann verwunderlich, dass Kinder Schulaufgaben eher als Kästchen betrachten, die sie ankreuzen müssen, und nicht als Gelegenheiten zum Lernen?

Geben Sie den Schülern also GenAI – und lassen Sie die Lehrkräfte Wege erproben, wie sie diese neue Technologie nutzen können, um die Schüler dort zu erreichen, wo sie sind. Ich habe keine große Hoffnung auf eine drastische Bildungsreform. Aber vielleicht dient GenAI als Ausgangspunkt für Unterrichtspläne, die Kinder für Themen begeistern, mit denen sie sich vorher nie beschäftigt hätten.

Hier sind einige andere bemerkenswerte KI-Geschichten der letzten Tage:

Der Leselehrer von Microsoft: Microsoft hat diese Woche Reading Coach entwickelt, sein KI-Tool, das Lernenden personalisierte Leseübungen bietet. verfügbar kostenlos für alle mit einem Microsoft-Konto.

Algorithmische Transparenz in der Musik: EU-Regulierungsbehörden fordern Gesetze, um Musik-Streaming-Plattformen mehr algorithmische Transparenz aufzuzwingen. Sie wollen auch KI-generierte Musik – und Deepfakes – bekämpfen.

Die Roboter der NASA: Die NASA hat kürzlich eine selbstorganisierende Roboterstruktur vorgestellt, die laut Devin möglicherweise ein entscheidender Bestandteil bei der Abwanderung vom Planeten sein könnte.

Samsung Galaxy, jetzt KI-betrieben: Bei der Einführungsveranstaltung des Samsung Galaxy S24 stellte das Unternehmen die verschiedenen Möglichkeiten vor, wie KI das Smartphone-Erlebnis verbessern könnte, unter anderem durch Live-Übersetzung von Anrufen, vorgeschlagene Antworten und Aktionen sowie eine neue Möglichkeit der Google-Suche mithilfe von Gesten.

Der Geometrielöser von DeepMind: DeepMind, das KI-Forschungs- und Entwicklungslabor von Google, stellte diese Woche AlphaGeometry vor, ein KI-System, das nach Angaben des Labors genauso viele Geometrieprobleme lösen kann wie der durchschnittliche Goldmedaillengewinner der Internationalen Mathematikolympiade.

OpenAI und Crowdsourcing: In anderen OpenAI-Nachrichten bildet das Startup ein neues Team, Collective Alignment, um Ideen aus der Öffentlichkeit umzusetzen, wie sichergestellt werden kann, dass seine zukünftigen KI-Modelle „an den Werten der Menschheit ausgerichtet“ sind. Gleichzeitig ändert es seine Politik, um militärische Anwendungen seiner Technologie zu ermöglichen. (Apropos Mixed Messaging.)

Ein Pro-Plan für Copilot: Microsoft hat einen verbraucherorientierten kostenpflichtigen Plan für Copilot, die Dachmarke für sein Portfolio an KI-gestützten, inhaltsgenerierenden Technologien, eingeführt und die Zulassungsvoraussetzungen für Copilot-Angebote auf Unternehmensebene gelockert. Außerdem wurden neue Funktionen für kostenlose Benutzer eingeführt, darunter eine Copilot-Smartphone-App.

Täuschende Modelle: Die meisten Menschen erlernen die Fähigkeit, andere Menschen zu täuschen. Können KI-Modelle also dasselbe lernen? Ja, die Antwort scheint – und erschreckenderweise sind sie außergewöhnlich gut darin. Laut einer neuen Studie des KI-Startups Anthropic.

Teslas inszenierte Robotik-Demo: Elon Musks humanoider Roboter Optimus von Tesla macht noch mehr – dieses Mal faltet er ein T-Shirt auf einem Tisch in einer Entwicklungseinrichtung. Doch wie sich herausstellt, ist der Roboter derzeit alles andere als autonom.

Mehr maschinelles Lernen

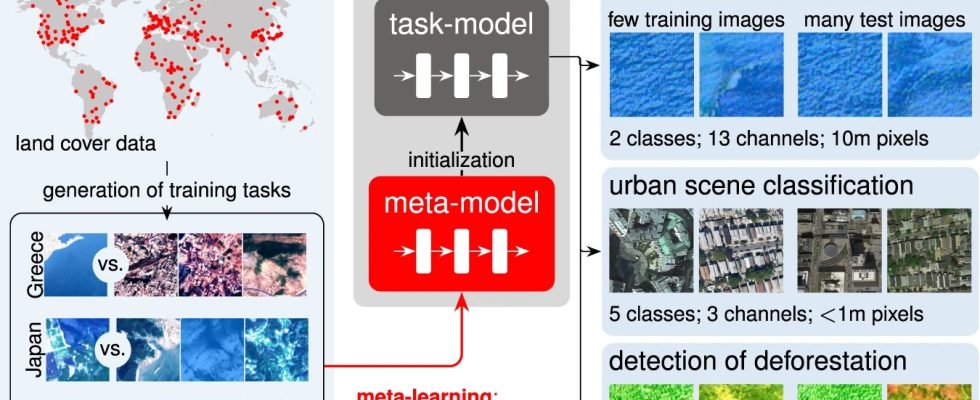

Eines der Dinge, die breitere Anwendungen von Dingen wie der KI-gestützten Satellitenanalyse behindern, ist die Notwendigkeit, Modelle zu trainieren, um eine möglicherweise ziemlich esoterische Form oder ein ziemlich esoterisches Konzept zu erkennen. Den Umriss eines Gebäudes erkennen: einfach. Trümmerfelder nach Überschwemmungen identifizieren: Gar nicht so einfach! Schweizer Forscher der EPFL hoffen, dies einfacher zu machen ein Programm, das sie METEOR nennen.

Bildnachweis: EPFL

„Das Problem in der Umweltwissenschaft besteht darin, dass es oft unmöglich ist, einen ausreichend großen Datensatz zu erhalten, um KI-Programme für unsere Forschungsbedürfnisse zu trainieren“, sagte Marc Rußwurm, einer der Projektleiter. Ihre neue Trainingsstruktur ermöglicht es, einen Erkennungsalgorithmus mit nur vier oder fünf repräsentativen Bildern für eine neue Aufgabe zu trainieren. Die Ergebnisse sind vergleichbar mit Modellen, die auf weitaus mehr Daten trainiert wurden. Ihr Plan besteht darin, das System vom Labor zum Produkt mit einer Benutzeroberfläche weiterzuentwickeln, damit es von normalen Menschen (d. h. nicht auf KI spezialisierten Forschern) verwendet werden kann. Du kannst lesen das Papier, das sie hier veröffentlicht haben.

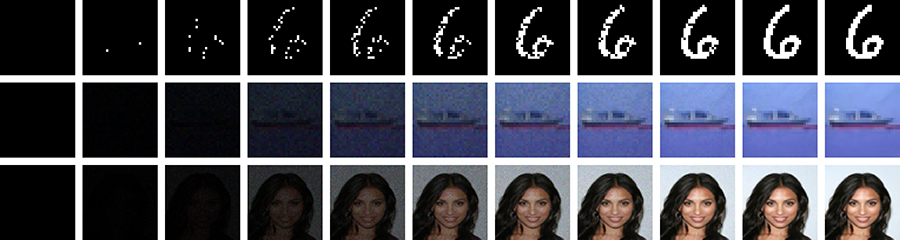

Der umgekehrte Weg – die Erstellung von Bildern – ist ein Bereich intensiver Forschung, da eine effiziente Vorgehensweise die Rechenlast für generative KI-Plattformen reduzieren könnte. Die gebräuchlichste Methode ist die sogenannte Diffusion, bei der eine reine Rauschquelle schrittweise in ein Zielbild verfeinert wird. Das Los Alamos National Lab hat einen neuen Ansatz, den sie Blackout Diffusion nennendas stattdessen von einem rein schwarzen Bild ausgeht.

Dadurch entfällt zunächst die Notwendigkeit von Rauschen, aber der eigentliche Fortschritt liegt darin, dass das Framework in „diskreten Räumen“ und nicht kontinuierlich stattfindet, was die Rechenlast erheblich reduziert. Sie sagen, dass es eine gute Leistung erbringt und zu geringeren Kosten erhältlich ist, aber es ist definitiv noch weit von einer breiten Veröffentlichung entfernt. Ich bin nicht in der Lage, die Wirksamkeit dieses Ansatzes zu bewerten (die Berechnung ist mir bei weitem nicht möglich), aber nationale Labore neigen nicht dazu, so etwas ohne Grund zu übertreiben. Ich werde die Forscher um weitere Informationen bitten.

KI-Modelle tauchen überall in den Naturwissenschaften auf, wo ihre Fähigkeit, Signale aus dem Rauschen herauszufiltern, sowohl neue Erkenntnisse liefert als auch Geld für die Dateneingabestunden von Doktoranden spart.

Australien bewirbt sich Die Waldbranderkennungstechnologie von Pano AI im „Grünen Dreieck“, einer wichtigen Forstregion. Ich freue mich, wenn Startups auf diese Weise eingesetzt werden – es könnte nicht nur dabei helfen, Brände zu verhindern, sondern es liefert auch wertvolle Daten für Forst- und Naturressourcenbehörden. Bei Waldbränden (oder Buschbränden, wie sie dort unten genannt werden) zählt jede Minute, daher können frühzeitige Benachrichtigungen den Unterschied zwischen Zehntausenden Hektar Schaden ausmachen.

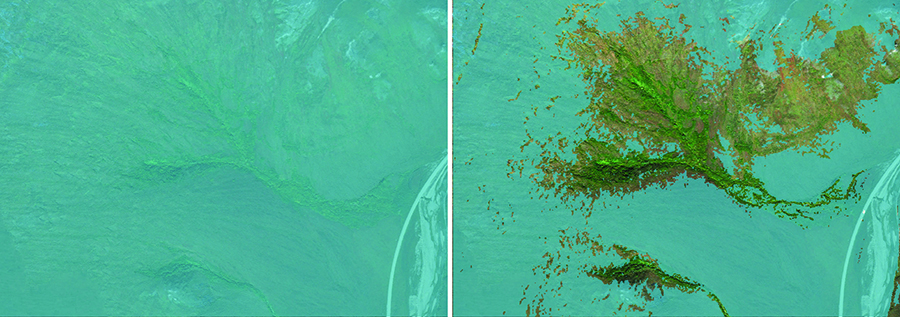

Permafrost-Reduktion, gemessen mit dem alten Modell (links) und dem neuen Modell (rechts).

Los Alamos wird ein zweites Mal erwähnt (das ist mir erst beim Durchgehen meiner Notizen aufgefallen), da sie auch an einem neuen KI-Modell für arbeiten Schätzung des Rückgangs des Permafrosts. Bestehende Modelle hierfür haben eine geringe Auflösung und prognostizieren Permafrostniveaus in Brocken von etwa 1/3 Quadratmeile. Das ist sicherlich nützlich, aber mit mehr Details erhalten Sie weniger irreführende Ergebnisse für Gebiete, die im größeren Maßstab wie 100 % Permafrost aussehen könnten, aber bei näherer Betrachtung deutlich weniger davon sind. Da der Klimawandel fortschreitet, müssen diese Messungen exakt sein!

Biologen finden interessante Möglichkeiten, KI oder KI-angrenzende Modelle in den vielen Teilbereichen dieses Bereichs zu testen und zu nutzen. Auf einer kürzlichen Konferenz Geschrieben von meinen Freunden bei GeekWireIn Postersitzungen wurden Werkzeuge zur Verfolgung von Zebras, Insekten und sogar einzelnen Zellen gezeigt.

Und auf der physikalischen und chemischen Seite untersuchen Forscher in Argonne NL, wie Wasserstoff am besten für die Verwendung als Kraftstoff verpackt werden kann. Freier Wasserstoff ist bekanntermaßen schwer einzudämmen und zu kontrollieren, daher wird er durch die Bindung an ein spezielles Helfermolekül gezähmt. Das Problem ist, dass Wasserstoff an so ziemlich alles bindet, daher gibt es Milliarden und Abermilliarden Möglichkeiten für Helfermoleküle. Aber das Sortieren großer Datenmengen ist eine Spezialität des maschinellen Lernens.

„Wir waren auf der Suche nach organischen Flüssigkeitsmolekülen, die Wasserstoff über einen langen Zeitraum festhalten, aber nicht so stark, dass sie bei Bedarf nicht einfach entfernt werden könnten“, sagte Hassan Harb vom Projekt. Ihr System sortierte 160 Milliarden Moleküle, und mithilfe einer KI-Screening-Methode konnten sie 3 Millionen pro Sekunde durchsehen – der gesamte Endprozess dauerte also etwa einen halben Tag. (Natürlich verwendeten sie einen ziemlich großen Supercomputer.) Sie identifizierten 41 der besten Kandidaten, was für die Versuchsmannschaft eine unbedeutende Zahl ist, die sie im Labor testen kann. Hoffentlich finden sie etwas Nützliches – ich möchte mich bei meinem nächsten Auto nicht mit Wasserstofflecks herumschlagen müssen.

Zum Schluss noch ein Wort der Vorsicht: ein Studium der Naturwissenschaften fanden heraus, dass maschinelle Lernmodelle zur Vorhersage, wie Patienten auf bestimmte Behandlungen reagieren würden, innerhalb der Stichprobengruppe, an der sie geschult wurden, sehr genau waren. In anderen Fällen haben sie im Grunde überhaupt nicht geholfen. Das bedeutet nicht, dass sie nicht verwendet werden sollten, aber es bestätigt, was viele Leute in der Branche gesagt haben: KI ist kein Allheilmittel und muss in jeder neuen Population und Anwendung, in der sie eingesetzt wird, gründlich getestet werden Zu.