Mit einer so schnelllebigen Branche wie der KI Schritt zu halten, ist eine große Herausforderung. Bis eine KI dies für Sie erledigen kann, finden Sie hier eine praktische Zusammenfassung der neuesten Geschichten aus der Welt des maschinellen Lernens sowie bemerkenswerte Forschungsergebnisse und Experimente, die wir nicht alleine behandelt haben.

Diese Woche hat Microsoft in AI ein neues Standard-PC-Tastaturlayout mit einer „Copilot“-Taste vorgestellt. Sie haben richtig gehört: In Zukunft werden Windows-Rechner über eine spezielle Taste zum Starten des KI-gestützten Assistenten Copilot von Microsoft verfügen, die die rechte Steuertaste ersetzt.

Man kann sich vorstellen, dass dieser Schritt ein Zeichen für die Ernsthaftigkeit der Investitionen von Microsoft im Wettlauf um die KI-Dominanz bei Verbrauchern (und Unternehmen) sein soll. Es ist das erste Mal seit etwa 30 Jahren, dass Microsoft das Windows-Tastaturlayout geändert hat. Laptops und Tastaturen mit der Copilot-Taste sollen bereits Ende Februar ausgeliefert werden.

Aber ist das alles nur Lärm? Tun Windows-Benutzer wirklich wollen eine KI-Abkürzung – oder Microsofts Variante der KI-Ära?

Microsoft hat mit Sicherheit eine Show daraus gemacht, fast alle seine alten und neuen Produkte mit der „Copilot“-Funktionalität auszustatten. Mit auffälligen Keynotes, raffinierten Demos und nun auch einem KI-Schlüssel stellt das Unternehmen seine KI-Technologie in den Vordergrund – und setzt darauf, die Nachfrage anzukurbeln.

Die Nachfrage ist keine sichere Sache. Aber um fair zu sein. Einigen Anbietern ist es gelungen, virale KI-Hits in Erfolge zu verwandeln. Schauen Sie sich OpenAI an, den Hersteller von ChatGPT angeblich Gegen Ende des Jahres 2023 lag der Jahresumsatz bei über 1,6 Milliarden US-Dollar. Auch die generative Kunstplattform Midjourney ist offenbar profitabel – und hat noch keinen Cent an Fremdkapital aufgenommen.

Betonung ein paar, obwohl. Die meisten Anbieter mussten aufgrund der Kosten für Schulung und Betrieb modernster KI-Modelle immer größere Kapitaltranchen beschaffen, um über Wasser zu bleiben. Ein typisches Beispiel dafür ist Anthropic erziehen 750 Millionen US-Dollar in einer Runde, wodurch sich die Gesamteinnahme auf über 8 Milliarden US-Dollar belaufen würde.

Microsoft hofft zusammen mit seinen Chippartnern AMD und Intel, dass die KI-Verarbeitung immer mehr von teuren Rechenzentren auf lokale Chips verlagert und dabei KI kommerzialisiert wird – und das könnte durchaus richtig sein. Intels neue Palette an Consumer-Chips enthält speziell entwickelte Kerne für die Ausführung von KI. Darüber hinaus könnten neue Rechenzentrumschips wie der von Microsoft das Modelltraining zu einem kostengünstigeren Unterfangen machen, als es derzeit der Fall ist.

Aber es gibt keine Garantie. Der eigentliche Test wird sein, ob Windows-Benutzer und Unternehmenskunden, die mit Copilot-Werbung bombardiert werden, Appetit auf die Technologie zeigen – und dafür bezahlen. Wenn nicht, dauert es möglicherweise nicht lange, bis Microsoft die Windows-Tastatur noch einmal neu gestalten muss.

Hier sind einige andere bemerkenswerte KI-Geschichten der letzten Tage:

- Copilot kommt aufs Handy: In weiteren Copilot-Neuigkeiten brachte Microsoft stillschweigend Copilot-Clients zusammen mit iPadOS auf Android und iOS.

- GPT-Store: OpenAI kündigte Pläne an, einen Store für GPTs zu eröffnen, benutzerdefinierte Apps, die auf seinen textgenerierenden KI-Modellen basieren (z. B. GPT-4).), innerhalb der nächsten Woche. Der GPT Store wurde letztes Jahr während der ersten jährlichen Entwicklerkonferenz von OpenAI, dem DevDay, angekündigt, verzögerte sich jedoch im Dezember – mit ziemlicher Sicherheit aufgrund des Führungswechsels, der im November unmittelbar nach der ersten Ankündigung stattfand.

- OpenAI verringert das Registrierungsrisiko: In anderen OpenAI-Nachrichten versucht das Startup, sein regulatorisches Risiko in der EU zu verringern, indem es einen Großteil seines Auslandsgeschäfts über ein irisches Unternehmen abwickelt. Natasha schreibt, dass der Schritt die Fähigkeit einiger Datenschutzwächter in der Union einschränken wird, einseitig auf Bedenken zu reagieren.

- Trainingsroboter: Das DeepMind Robotics-Team von Google erforscht Möglichkeiten, Robotern ein besseres Verständnis dafür zu vermitteln, was genau wir Menschen von ihnen erwarten, schreibt Brian. Das neue System des Teams kann eine Flotte zusammenarbeitender Roboter verwalten und Aufgaben vorschlagen, die von der Hardware der Roboter ausgeführt werden können.

- Intels neues Unternehmen: Intel bricht aus ein neues Plattformunternehmen, Articul8 AI, mit Unterstützung des in Boca Raton, Florida, ansässigen Vermögensverwalters und Investors DigitalBridge. Wie ein Intel-Sprecher erklärt, bietet die Plattform von Articul8 „KI-Funktionen, die Kundendaten, Schulungen und Schlussfolgerungen innerhalb des Sicherheitsbereichs des Unternehmens halten“ – eine attraktive Perspektive für Kunden in stark regulierten Branchen wie dem Gesundheitswesen und Finanzdienstleistungen.

- Dunkle Fischereiindustrie, aufgedeckt: Satellitenbilder und maschinelles Lernen bieten einen neuen, weitaus detaillierteren Einblick in die maritime Industrie, insbesondere in die Anzahl und Aktivitäten von Fischerei- und Transportschiffen auf See. Es stellt sich heraus, dass es welche gibt Weg mehr davon, als öffentlich verfügbare Daten vermuten lassen – eine Tatsache, die aus einer neuen, in Nature veröffentlichten Studie eines Teams von Global Fishing Watch und mehreren kooperierenden Universitäten hervorgeht.

- KI-gestützte Suche: Perplexity AI, eine Plattform, die KI auf die Websuche anwendet, sammelte in einer Finanzierungsrunde 73,6 Millionen US-Dollar und bewertete das Unternehmen mit 520 Millionen US-Dollar. Im Gegensatz zu herkömmlichen Suchmaschinen bietet Perplexity eine Chatbot-ähnliche Oberfläche, über die Benutzer Fragen in natürlicher Sprache stellen können (z. B. „Verbrennen wir beim Schlafen Kalorien?“, „Welches ist das am wenigsten besuchte Land?“ usw.).

- Klinische Notizen, automatisch geschrieben: Weitere Finanzierungsnachrichten: Das in Paris ansässige Startup Nabla hat stolze 24 Millionen US-Dollar gesammelt. Das Unternehmen, das a Partnerschaft mit der Permanente Medical Groupeine Abteilung des US-amerikanischen Gesundheitsriesen Kaiser Permanente, arbeitet an einem „KI-Copiloten“ für Ärzte und anderes klinisches Personal, der automatisch Notizen macht und medizinische Berichte verfasst.

Mehr maschinelles Lernen

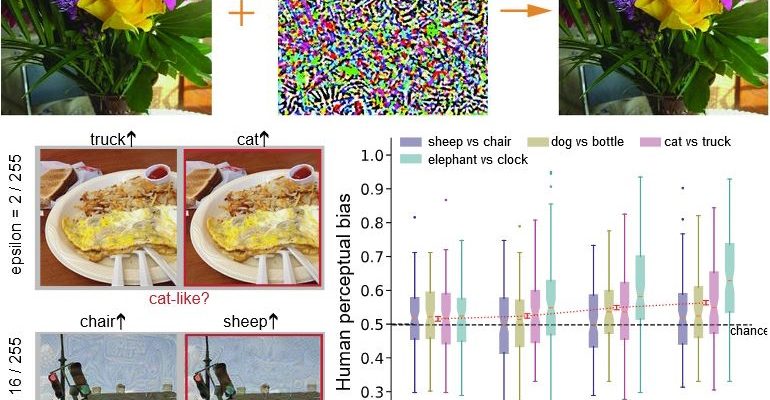

Sie erinnern sich vielleicht an verschiedene Beispiele interessanter Arbeiten im letzten Jahr, bei denen es um geringfügige Änderungen an Bildern ging, die dazu führen, dass Modelle für maschinelles Lernen verwechseln, beispielsweise ein Bild eines Hundes mit einem Bild eines Autos. Dazu fügen sie „Störungen“, also geringfügige Änderungen an den Pixeln des Bildes, in einem Muster hinzu, das nur das Modell wahrnehmen kann. Oder zumindest sie Gedanke Nur das Modell konnte es wahrnehmen.

Ein Experiment von Google DeepMind-Forschern zeigte, dass, wenn ein Bild mit Blumen so gestört wurde, dass es für die KI eher katzenartig wirkte, Menschen dieses Bild eher als katzenartig beschrieben, obwohl es definitiv nicht mehr wie eine Katze aussieht. Das Gleiche gilt für andere alltägliche Gegenstände wie Lastwagen und Stühle.

Bildnachweis: Google DeepMind

Warum? Wie? Die Forscher wissen es nicht wirklich, und alle Teilnehmer hatten das Gefühl, dass sie nur zufällig ausgewählt haben (tatsächlich ist der Einfluss zwar zuverlässig, aber kaum über dem Zufall). Es scheint, dass wir einfach scharfsinniger sind, als wir denken – aber das hat auch Auswirkungen auf die Sicherheit und andere Maßnahmen, da es darauf hindeutet, dass sich unterschwellige Signale tatsächlich durch Bilder verbreiten könnten, ohne dass es jemand bemerkt.

Ein weiteres interessantes Experiment zur menschlichen Wahrnehmung kam diese Woche vom MIT, bei dem maschinelles Lernen zum Einsatz kam helfen, ein bestimmtes System des Sprachverständnisses zu erläutern. Im Grunde erfordern einige einfache Sätze wie „Ich ging zum Strand“ kaum Gehirnleistung, um sie zu entschlüsseln, während komplexe oder verwirrende Sätze wie „In wessen aristokratischem System es eine düstere Revolution auslöst“ eine stärkere und umfassendere Aktivierung bewirken, wie durch fMRT gemessen.

Das Team verglich die Aktivierungswerte von Menschen, die eine Vielzahl solcher Sätze lasen, mit der Art und Weise, wie dieselben Sätze das Äquivalent kortikaler Bereiche in einem großen Sprachmodell aktivierten. Dann erstellten sie ein zweites Modell, das lernte, wie die beiden Aktivierungsmuster einander entsprachen. Dieses Modell war in der Lage, für neuartige Sätze vorherzusagen, ob sie die menschliche Wahrnehmung beanspruchen würden oder nicht. Es mag etwas geheimnisvoll klingen, aber es ist auf jeden Fall super interessant, glauben Sie mir.

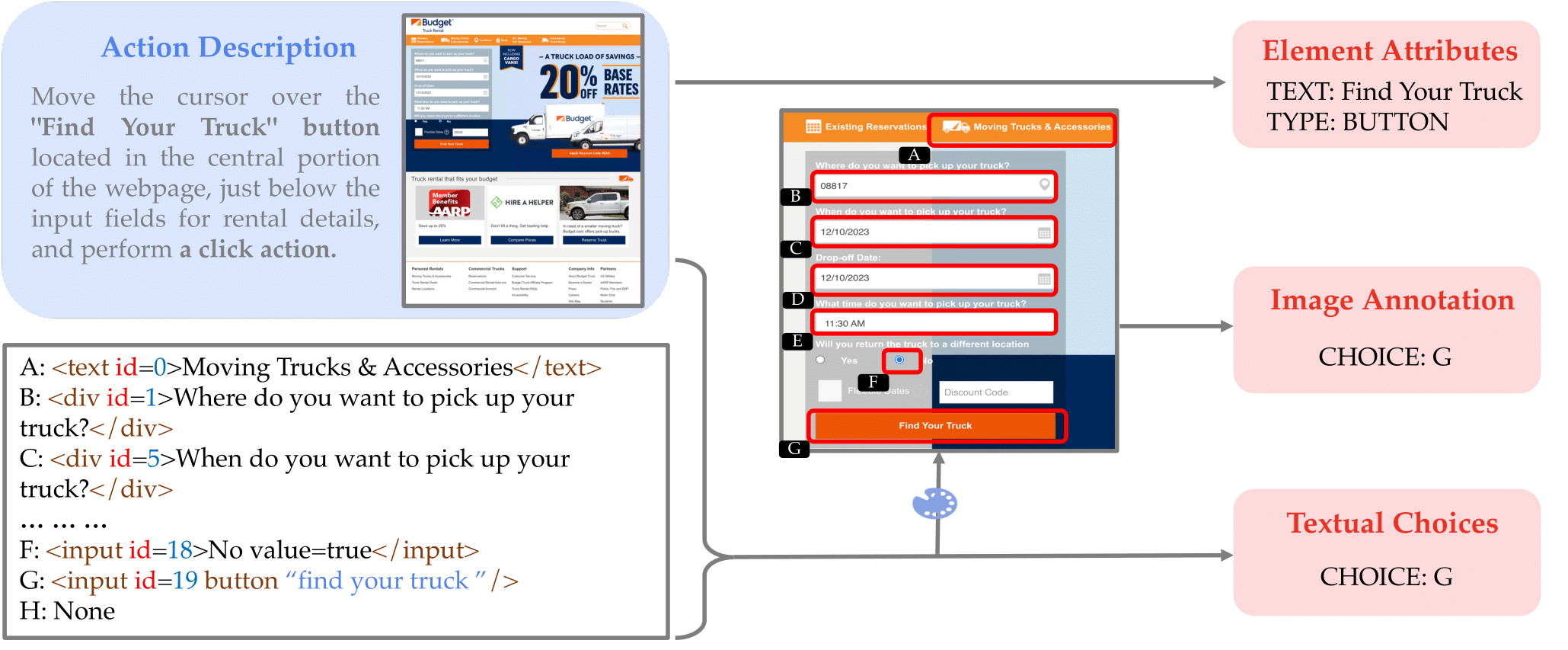

Ob maschinelles Lernen die menschliche Kognition in komplexeren Bereichen wie der Interaktion mit Computerschnittstellen imitieren kann, ist noch immer eine offene Frage. Es gibt jedoch zahlreiche Forschungsergebnisse, und es lohnt sich immer, einen Blick darauf zu werfen. Diese Woche haben wir SieheAktein System von Forschern des US-Bundesstaates Ohio, das die Interpretation möglicher Handlungen eines LLM mühsam anhand von Beispielen aus der Praxis begründet.

Bildnachweis: Ohio State Universität

Im Grunde kann man ein System wie GPT-4V bitten, eine Reservierung auf einer Website zu erstellen, und es erhält, was seine Aufgabe ist und dass es auf die Schaltfläche „Reservierung durchführen“ klicken muss, aber es weiß nicht wirklich, wie das geht . Indem es die Art und Weise verbessert, wie es Schnittstellen mit expliziten Bezeichnungen und Weltwissen wahrnimmt, kann es viel besser machen, auch wenn es immer noch nur in einem Bruchteil der Fälle gelingt. Diese Agentenmodelle haben noch einen langen Weg vor sich, aber dieses Jahr erwarten Sie trotzdem viele große Ansprüche! Ich habe heute erst einige gehört.

Schauen Sie sich als Nächstes diese interessante Lösung für ein Problem an, von dessen Existenz ich nichts wusste, das aber durchaus Sinn macht. Autonome Schiffe sind ein vielversprechender Bereich der Automatisierung, aber wenn das Meer wütend ist, ist es schwierig sicherzustellen, dass sie auf dem richtigen Weg sind. GPS und Gyros reichen nicht aus, und auch die Sicht kann schlecht sein – aber was noch wichtiger ist, die Systeme, die sie steuern, sind nicht allzu ausgefeilt. Wenn sie es nicht besser wissen, können sie also völlig vom Ziel abweichen oder Kraftstoff verschwenden, indem sie große Umwege fahren, was ein großes Problem darstellt, wenn Sie mit Batteriestrom unterwegs sind. Darüber habe ich noch nie nachgedacht!

Koreas Maritime und Ozean-Universität (eine weitere Sache, die ich heute erfahren habe) schlägt ein leistungsfähigeres Wegfindungsmodell vor, das auf der Simulation von Schiffsbewegungen in einem rechnergestützten Fluiddynamikmodell basiert. Sie schlagen vor, dass dieses bessere Verständnis der Wellenwirkung und ihrer Auswirkungen auf Rümpfe und Antrieb die Effizienz und Sicherheit des autonomen Seetransports erheblich verbessern könnte. Es könnte sogar sinnvoll sein, es in von Menschen geführten Schiffen einzusetzen, deren Kapitäne nicht ganz sicher sind, welcher Anstellwinkel für eine bestimmte Böen- oder Wellenform der beste ist!

Wenn Sie abschließend einen guten Rückblick auf die großen Fortschritte in der Informatik des letzten Jahres wünschen, die sich im Jahr 2023 massiv mit der ML-Forschung überschnitten haben, Schauen Sie sich Quantas hervorragende Rezension an.