Google setzt voll auf KI – und möchte, dass Sie das wissen. Während der Keynote des Unternehmens auf seiner I/O-Entwicklerkonferenz am Dienstag erwähnte Google „KI“ mehr als 120 Mal. Das ist eine Menge!

Doch nicht alle KI-Ankündigungen von Google waren per se bedeutsam. Einige waren inkrementell. Andere wurden wieder aufgewärmt. Um die Spreu vom Weizen zu trennen, haben wir die besten neuen KI-Produkte und -Funktionen zusammengestellt, die auf der Google I/O 2024 vorgestellt wurden.

Generative KI in der Suche

Google plant, generative KI zu nutzen, um ganze Google-Suchergebnisseiten zu organisieren.

Wie werden KI-organisierte Seiten aussehen? Nun, es kommt auf die Suchanfrage an. Aber sie könnten KI-generierte Zusammenfassungen von Rezensionen, Diskussionen von Social-Media-Seiten wie Reddit und KI-generierte Listen mit Vorschlägen anzeigen, sagte Google.

Derzeit plant Google, KI-gestützte Ergebnisseiten anzuzeigen, wenn es erkennt, dass ein Nutzer nach Inspiration sucht – beispielsweise bei der Reiseplanung. In Kürze werden diese Ergebnisse auch angezeigt, wenn Benutzer nach Speisemöglichkeiten und Rezepten suchen, mit Ergebnissen für Filme, Bücher, Hotels, E-Commerce und mehr.

Projekt Astra und Gemini Live

Google verbessert seinen KI-gestützten Chatbot Gemini, damit er die Welt um ihn herum besser verstehen kann.

Das Unternehmen stellte eine neue Erfahrung in Gemini namens Gemini Live vor, die es Benutzern ermöglicht, „ausführliche“ Sprachchats mit Gemini auf ihren Smartphones zu führen. Benutzer können Gemini unterbrechen, während der Chatbot spricht, um klärende Fragen zu stellen, und der Chatbot passt sich in Echtzeit an ihre Sprachmuster an. Und Zwillinge können die Umgebung der Benutzer sehen und darauf reagieren, entweder über Fotos oder Videos, die von den Kameras ihrer Smartphones aufgenommen wurden.

Gemini Live – das erst später in diesem Jahr auf den Markt kommt – kann Fragen zu Dingen beantworten, die sich im Sichtfeld (oder kürzlich im Sichtfeld) der Kamera eines Smartphones befinden, etwa in welcher Nachbarschaft sich ein Benutzer möglicherweise befindet oder wie ein Teil eines kaputten Fahrrads heißt. Die technischen Innovationen, die Live vorantreiben, stammen zum Teil aus Project Astra, einer neuen Initiative innerhalb von DeepMind zur Entwicklung KI-gestützter Apps und „Agenten“ für multimodales Verständnis in Echtzeit.

Google Veo

Google strebt nach OpenAIs Sora mit Veo, einem KI-Modell, das bei Eingabe einer Textaufforderung etwa eine Minute lange 1080p-Videoclips erstellen kann.

Veo kann verschiedene visuelle und filmische Stile erfassen, einschließlich Landschaftsaufnahmen und Zeitrafferaufnahmen, und Bearbeitungen und Anpassungen an bereits erstelltem Filmmaterial vornehmen. Das Modell versteht Kamerabewegungen und VFX recht gut anhand von Eingabeaufforderungen (denken Sie an Deskriptoren wie „Schwenken“, „Zoom“ und „Explosion“). Und Veo hat ein gewisses Verständnis für die Physik – Dinge wie Fluiddynamik und Schwerkraft – was zum Realismus der von ihm generierten Videos beiträgt.

Veo unterstützt auch die maskierte Bearbeitung für Änderungen an bestimmten Bereichen eines Videos und kann Videos aus einem Standbild generieren, ähnlich generativen Modellen wie Stability AIs Stable Video. Am faszinierendsten ist vielleicht, dass Veo bei einer Abfolge von Eingabeaufforderungen, die zusammen eine Geschichte erzählen, längere Videos generieren kann – Videos mit einer Länge von mehr als einer Minute.

Fragen Sie nach Fotos

Google Fotos erhält eine KI-Infusion mit der Einführung einer experimentellen Funktion, Ask Photos, die auf der Gemini-Familie generativer KI-Modelle von Google basiert.

„Ask Photos“, das später in diesem Sommer eingeführt wird, ermöglicht es Nutzern, ihre Google Fotos-Sammlung mithilfe von Abfragen in natürlicher Sprache zu durchsuchen, die Geminis Verständnis des Inhalts ihrer Fotos – und anderer Metadaten – nutzen.

Anstatt beispielsweise nach einer bestimmten Sache auf einem Foto zu suchen, wie zum Beispiel „One World Trade“, können Benutzer viel umfassendere und komplexere Suchvorgänge durchführen, wie zum Beispiel das „beste Foto aus jedem der Nationalparks, die ich besucht habe“. ” In diesem Beispiel würde Gemini Signale wie Beleuchtung, Unschärfe und fehlende Hintergrundverzerrung verwenden, um zu bestimmen, was ein Foto in einem bestimmten Satz zum „Besten“ macht, und dies mit einem Verständnis der Geolokalisierungsinformationen und -daten kombinieren, um die relevanten Bilder zurückzugeben.

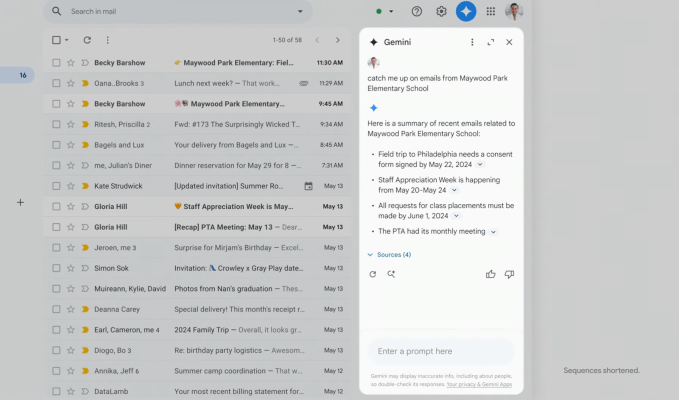

Zwillinge in Gmail

Dank Gemini können Gmail-Nutzer bald E-Mails durchsuchen, zusammenfassen und verfassen – und außerdem E-Mails bearbeiten, um komplexere Aufgaben zu erledigen, beispielsweise bei der Bearbeitung von Retouren.

In einer Demo auf der I/O zeigte Google, wie ein Elternteil, der sich über die Vorgänge in der Schule seines Kindes informieren wollte, Gemini bitten konnte, alle aktuellen E-Mails der Schule zusammenzufassen. Zusätzlich zum Text der E-Mails selbst analysiert Gemini auch Anhänge, wie z. B. PDFs, und spuckt eine Zusammenfassung mit wichtigen Punkten und Aktionspunkten aus.

Über eine Seitenleiste in Gmail können Benutzer Gemini bitten, ihnen beim Organisieren von Belegen aus ihren E-Mails zu helfen und sie sogar in einem Google Drive-Ordner abzulegen, oder Informationen aus den Belegen extrahieren und in eine Tabelle einfügen. Wenn Sie das häufig tun – zum Beispiel als Geschäftsreisender, um Ausgaben zu verfolgen – kann Gemini auch anbieten, den Workflow für die zukünftige Nutzung zu automatisieren.

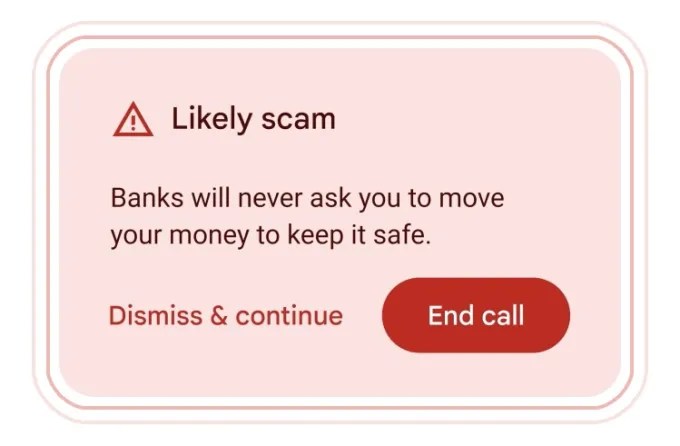

Erkennen von Betrug während eines Anrufs

Google hat eine Vorschau einer KI-gestützten Funktion gezeigt, um Benutzer während eines Anrufs auf potenzielle Betrügereien aufmerksam zu machen.

Die Funktion, die in eine zukünftige Version von Android integriert werden soll, nutzt Gemini Nano, die kleinste Version des generativen KI-Angebots von Google, die vollständig auf dem Gerät ausgeführt werden kann, um in Echtzeit auf „Konversationsmuster zu achten, die häufig mit Betrug in Verbindung gebracht werden“. .

Für die Funktion wurde kein konkretes Veröffentlichungsdatum festgelegt. Wie bei vielen dieser Dinge prognostiziert Google, wie viel Gemini Nano irgendwann in der Lage sein wird. Wir wissen jedoch, dass die Funktion optional sein wird – was eine gute Sache ist. Während die Verwendung von Nano bedeutet, dass das System Audio nicht automatisch in die Cloud hochlädt, hört das System dennoch effektiv den Gesprächen der Benutzer zu – ein potenzielles Risiko für die Privatsphäre.

KI für Barrierefreiheit

Google erweitert seine TalkBack-Barrierefreiheitsfunktion für Android mit ein wenig generativer KI-Magie.

Bald wird TalkBack Gemini Nano nutzen, um akustische Beschreibungen von Objekten für sehbehinderte und blinde Benutzer zu erstellen. TalkBack könnte sich beispielsweise auf ein Kleidungsstück beziehen als „Nahaufnahme eines schwarz-weißen Gingham-Kleides.“ Das Kleid ist kurz, mit Kragen und langen Ärmeln. Es wird in der Taille mit einer großen Schleife gebunden.“

Laut Google stoßen TalkBack-Nutzer täglich auf etwa 90 unbeschriftete Bilder. Mithilfe von Nano wird das System in der Lage sein, Einblicke in den Inhalt zu gewähren – möglicherweise ohne dass jemand diese Informationen manuell eingeben muss.