Gleich nach dem Ende des AI-Action-Gipfels in Paris bezeichnete Anthropics Mitbegründer und CEO Dario Amodei die Veranstaltung als „verpasste Gelegenheit“. Er fügte hinzu, dass „größerer Fokus und Dringlichkeit zu mehreren Themen erforderlich sind, da die Technologie in der Technologie voranschreitet“ Erklärung veröffentlicht am Dienstag.

Die KI-Firma veranstaltete in Zusammenarbeit mit dem französischen Startup eine Entwickler-Veranstaltung in Paris Staubund Tech hatte die Möglichkeit, Amodei auf der Bühne zu interviewen. Bei der Veranstaltung erklärte er seine Gedankenlinie und verteidigte einen dritten Weg, der weder reiner Optimismus noch reine Kritik an den Themen der KI -Innovation bzw. Governance ist.

„Früher war ich ein Neurowissenschaftler, wo ich im Grunde genommen in echten Gehirnen schaute, um meinen Lebensunterhalt zu verdienen. Und jetzt schauen wir in künstliche Gehirne, um ihren Lebensunterhalt zu verdienen. In den nächsten Monaten werden wir also einige aufregende Fortschritte im Bereich der Interpretierbarkeit erzielen – wo wir wirklich beginnen zu verstehen, wie die Modelle funktionieren “, sagte Amodei gegenüber Tech.

„Aber es ist definitiv ein Rennen. Es ist ein Rennen zwischen den Models mächtiger, was für uns unglaublich schnell ist und für andere unglaublich schnell – Sie können nicht wirklich langsamer werden, oder? … Unser Verständnis muss mit unserer Fähigkeit, Dinge aufzubauen, Schritt halten. Ich denke, das ist der einzige Weg “, fügte er hinzu.

Seit dem ersten KI -Gipfel in Bletchley in Großbritannien hat sich der Ton der Diskussion um die KI -Governance erheblich verändert. Es ist teilweise auf die derzeitige geopolitische Landschaft zurückzuführen.

„Ich bin heute Morgen nicht hier, um über KI -Sicherheit zu sprechen, was vor ein paar Jahren der Titel der Konferenz war“, sagte der US -Vizepräsident JD Vance am Dienstag auf dem AI Action Summit. „Ich bin hier, um über KI -Gelegenheit zu sprechen.“

Interessanterweise versucht Amodei, diese Antagonisierung zwischen Sicherheit und Chancen zu vermeiden. Tatsächlich glaubt er, dass sich ein verstärkter Schwerpunkt auf Sicherheit konzentriert Ist eine Gelegenheit.

„Auf dem ursprünglichen Gipfel, dem britischen Bletchley Summit, gab es viele Diskussionen über Tests und Messungen für verschiedene Risiken. Und ich glaube nicht, dass diese Dinge die Technologie überhaupt sehr verlangsamt haben “, sagte Amodei bei der anthropischen Veranstaltung. „Wenn überhaupt, hat uns unsere Modelle besser verstehen, was uns letztendlich besser zu verstehen, was zu besseren Modellen produziert wird.“

Und jedes Mal, wenn Amodei den Schwerpunkt auf Sicherheit legt, erinnert er auch gerne alle daran, dass Anthropic immer noch sehr darauf ausgerichtet ist, Frontier -KI -Modelle zu bauen.

„Ich möchte nichts tun, um das Versprechen zu verringern. Wir stellen jeden Tag Modelle an, auf denen Menschen aufbauen können und die verwendet werden, um erstaunliche Dinge zu tun. Und wir sollten definitiv nicht aufhören, das zu tun “, sagte er.

„Wenn die Leute viel über die Risiken sprechen, ärgere ich das Gespräch.

Die Schulungskosten von Deepseek sind „einfach nicht genau“

Als sich das Gespräch auf die jüngsten Modelle von Chinese LLM-Hersteller Deepseek verlagert, spielte Amodei die technischen Errungenschaften herunter und sagte, er habe das Gefühl, die öffentliche Reaktion sei „anorganisch“.

„Ehrlich gesagt war meine Reaktion sehr wenig. Wir hatten im Dezember V3, das Basismodell für Deepseek R1, gesehen. Und das war ein beeindruckendes Modell “, sagte er. „Das im Dezember veröffentlichte Modell stand auf dieser Art von sehr normalen Kostenreduzierungskurve, die wir in unseren Modellen und anderen Modellen gesehen haben.“

Bemerkenswert war, dass das Modell nicht aus den in den USA ansässigen „drei oder vier Grenzlabors“ stieg, in denen er Google, OpenAI und Anthrop als einige der Frontier Labs auflistete, die im Allgemeinen den Umschlag mit neuen Modellveröffentlichungen vorantreiben.

„Und das war mir eine Frage der geopolitischen Sorge. Ich wollte nie, dass autoritäre Regierungen diese Technologie dominieren “, sagte er.

Was Deepseeks angebliche Trainingskosten betrifft, entließ er die Idee, dass die Ausbildung von Deepseek V3 im Vergleich zu den Trainingskosten in den USA 100 -fache billiger war. [it] ist einfach nicht genau und basiert nicht auf Fakten “, sagte er.

Bevorstehende Claude -Modelle mit Argumentation

Während Amodei bei Mittwoch kein neues Modell angekündigt hat, neckte er einige der bevorstehenden Veröffentlichungen des Unternehmens – und ja, es enthält einige Argumentationskapazitäten.

„Wir konzentrieren uns im Allgemeinen darauf, unsere eigenen Argumentationsmodelle, die besser differenziert sind, zu versuchen, unsere eigenen Argumentationsmodelle zu machen. Wir machen uns Sorgen darüber, dass wir über genügend Kapazitäten verfügen, dass die Modelle schlauer werden, und wir machen uns um Sicherheits Dinge Sorgen “, sagte Amodei.

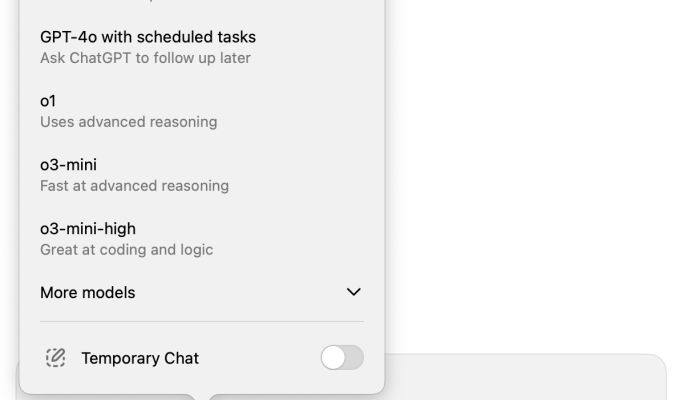

Eines der Probleme, die Anthropic zu lösen versucht, ist das Modellauswahl -Rätsel. Wenn Sie zum Beispiel ein ChatGPT Plus-Konto haben, kann es schwierig sein, zu wissen, welches Modell Sie im Popup der Modellauswahl für Ihre nächste Nachricht auswählen sollten.

Gleiches gilt für Entwickler, die APIs mit großer Sprachmodell (LLM) für ihre eigenen Anwendungen verwenden. Sie wollen die Dinge zwischen Genauigkeit, Geschwindigkeit von Antworten und Kosten ausgleichen.

„Wir waren ein bisschen verwirrt über die Idee, dass es normale Modelle gibt und Argumentationsmodelle sind und dass sie sich voneinander unterscheiden“, sagte Amodei. „Wenn ich mit dir spreche, hast du nicht zwei Gehirne und einer von ihnen antwortet sofort und mag die andere eine längere Zeit.“

Ihm zufolge sollte es abhängig von der Eingabe einen glatteren Übergang zwischen vorgebliebenen Modellen wie Claude 3.5 Sonett oder GPT-4O und Modellen geben, die mit Verstärkungslernen trainiert wurden und die Kette der Gedanken (COT) wie OpenAIs O1 oder die Kette des Nachdenkens erzeugen können Deepseeks R1.

„Wir denken, dass diese als Teil einer einzigen kontinuierlichen Einheit existieren sollten. Und wir sind vielleicht noch nicht da, aber Anthropic will die Dinge wirklich in diese Richtung bewegen “, sagte Amodei. „Wir sollten einen reibungsloseren Übergang von vorbereiteten Modellen haben-und nicht hier ist das Ding A und hier ist die Sache B“, fügte er hinzu.

Da große KI -Unternehmen wie Anthropic weiterhin bessere Modelle veröffentlichen, ist Amodei der Ansicht, dass es einige großartige Möglichkeiten eröffnen wird, die großen Unternehmen der Welt in jeder Branche zu stören.

„Wir arbeiten mit einigen Pharmaunternehmen zusammen, um Claude zu verwenden, um klinische Studien zu schreiben, und sie konnten die Zeit verkürzen, die für das Schreiben des klinischen Studienberichts von 12 Wochen bis drei Tagen benötigt wird“, sagte Amodei.

„Jenseits der Biomediziner gibt es legale, finanzielle, versicherung, produktivität, software und spielerische Energie. Ich denke, es wird – im Grunde – eine Renaissance disruptiver Innovationen im AI -Anwendungsraum geben. Und wir wollen ihm helfen, wir wollen alles unterstützen “, schloss er.

Lesen Sie unsere vollständige Berichterstattung über den Gipfel der künstlichen Intelligenz in Paris.