Generative KI ist disruptiv Branchen – mit verständlicher Kontroverse.

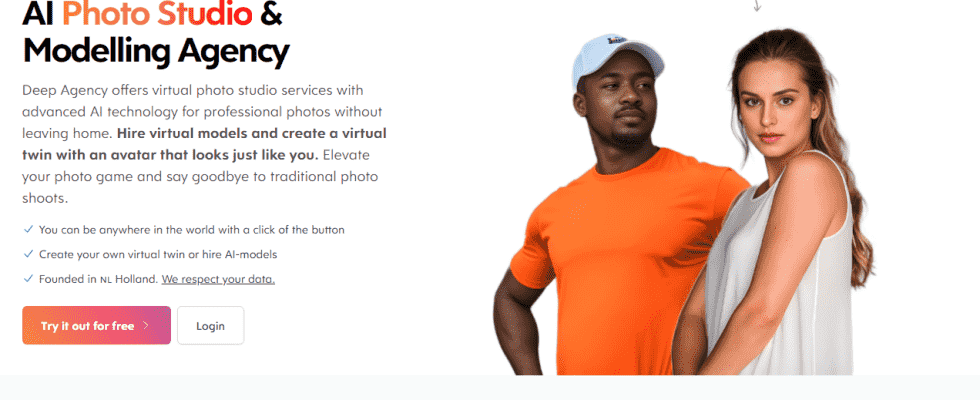

Anfang dieses Monats kündigte Danny Postma, der Gründer von Headlime, einem KI-gestützten Marketingkopie-Startup, das kürzlich von Jasper übernommen wurde, an Tiefe Agentur, eine Plattform, die er als „KI-Fotostudio und Modelagentur“ beschreibt. Mit kunstgenerierender KI erstellt und bietet Deep Agency „virtuelle Modelle“ zum Mieten ab 29 US-Dollar pro Monat (für eine begrenzte Zeit) an, sodass Kunden die Modelle vor digitalen Kulissen platzieren können, um ihre Fotoshootings zu realisieren.

„Was ist Deep Agency? Es ist ein Fotostudio, mit ein paar großen Unterschieden“, erklärte Postma in a Reihe von Tweets. „Keine Kamera. Keine echten Menschen. Kein physischer Standort … Wozu ist das gut? Unzählige Dinge, wie die Automatisierung von Inhalten für Social-Media-Influencer, Modelle für Werbeanzeigen von Marketeers und E-Commerce-Produktfotografie.“

Deep Agency befindet sich sehr stark in der Proof-of-Concept-Phase, das heißt… ein bisschen langweilig. Es gibt viele Artefakte in den Gesichtern der Models, und die Plattform platziert Leitplanken – absichtlich oder nicht – um die herum Körper erzeugt werden können. Gleichzeitig ist die Modellerstellung von Deep Agency seltsam schwer zu kontrollieren; Versuchen Sie, ein weibliches Modell zu erstellen, das in einem bestimmten Outfit gekleidet ist, wie das eines Polizisten, und Deep Agency kann es einfach nicht.

Trotzdem war die Reaktion auf den Start schnell – und gemischt.

Einige Twitter-Nutzer applaudierte die Technologie und bekundete Interesse daran, sie zum Modellieren von Kleidung und Bekleidungsmarken zu verwenden. Andere beschuldigt Postma, ein „zutiefst unethisches“ Geschäftsmodell zu verfolgen, die Fotografien und Ähnlichkeiten anderer Leute zu kratzen und sie mit Gewinn zu verkaufen.

Die Kluft spiegelt die breitere Debatte über generative KI wider, die weiterhin erstaunliche Finanzmittel anzieht und gleichzeitig eine Vielzahl moralischer, ethischer und rechtlicher Fragen aufwirft. Nach Laut PitchBook werden die Investitionen in generative KI im Jahr 2023 42,6 Milliarden US-Dollar erreichen und bis 2026 auf 98,1 Milliarden US-Dollar explodieren. Aber Unternehmen wie OpenAI, Midjourney und Stability AI sind derzeit in Rechtsstreitigkeiten wegen ihrer generativen KI-Technologien verwickelt, denen einige vorwerfen, die Werke von Künstlern zu replizieren ohne sie angemessen zu entschädigen.

Bildnachweis: Tiefe Agentur

Deep Agency scheint wegen der Anwendung – und Auswirkungen – seines Produkts besonders einen Nerv getroffen zu haben.

Postma, die auf eine Bitte um Stellungnahme nicht reagiert hat, scheut sich nicht, dass die Plattform mit realen Models und Fotografen konkurrieren und möglicherweise deren Lebensgrundlage gefährden könnte. Während einige Plattformen wie Shutterstock Mittel geschaffen haben, um Einnahmen aus KI-generierter Kunst mit Künstlern zu teilen, hat Deep Agency keinen solchen Schritt unternommen – und nicht signalisiert, dass sie dies beabsichtigt.

Zufälligerweise kündigte Levi’s nur wenige Wochen nach dem Debüt von Deep Agency an, dass es mit dem Designstudio LaLaLand.ai zusammenarbeiten würde, um maßgeschneiderte KI-generierte Modelle zu erstellen, um „die Vielfalt der Modelle zu erhöhen, die Käufer beim Tragen seiner Produkte sehen können“. Levi’s betonte, dass es vorhabe, die synthetischen Modelle neben menschlichen Modellen zu verwenden, und dass der Schritt seine Einstellungspläne nicht beeinträchtigen würde. Aber es warf die Frage auf, warum die Marke nicht mehr Models mit den unterschiedlichen Eigenschaften, die sie sucht, rekrutiert hat, angesichts der Schwierigkeiten, die diese Models in der Vergangenheit hatten, Chancen in der Modebranche zu finden. (Laut einem Umfrageab 2016 waren 78 % der Models in Modeanzeigen weiß.)

In einem E-Mail-Interview mit Tech machte Os Keyes, ein Doktorand an der University of Washington, der sich mit ethischer KI befasst, die Beobachtung, dass Modellierung und Fotografie – und die Künste im Allgemeinen – Bereiche sind, die besonders anfällig für generative KI sind, da es Fotografen und Künstlern an Struktur mangelt Leistung. Sie sind weitgehend schlecht bezahlte, unabhängige Auftragnehmer großer Unternehmen, die Kosten senken wollen, bemerkt Keyes. Models sind es zum Beispiel oft Am Haken für hohe Agenturprovisionsgebühren (~20 %) sowie Geschäftsausgaben, die Flugtickets, Gruppenunterkünfte und die Werbematerialien umfassen können, die erforderlich sind, um Jobs bei Kunden an Land zu ziehen.

„Die App von Postma ist – wenn sie funktioniert – in der Tat so konzipiert, dass sie den ohnehin schon prekären Kreativarbeitern den Stuhl entzieht und das Geld stattdessen an Postma schickt“, sagte Keyes. „Das ist nicht wirklich zu begrüßen, aber es ist auch nicht sehr überraschend … Tatsache ist, dass Tools wie dieses aus sozioökonomischer Sicht darauf ausgelegt sind, den Gewinn weiter zu entkernen und zu konzentrieren.“

Andere Kritiker kritisieren die zugrunde liegende Technologie. Hochmoderne Bilderzeugungssysteme, wie sie Deep Agency verwendet, sind sogenannte „Diffusionsmodelle“, die lernen, Bilder aus Textaufforderungen (z. B. „eine Skizze eines Vogels, der auf einer Fensterbank sitzt“) so zu erstellen, wie sie sind sich durch webgekratzte Trainingsdaten arbeiten. In den Köpfen der Künstler geht es um die Tendenz von Diffusionsmodellen, im Wesentlichen Bilder – einschließlich urheberrechtlich geschützter Inhalte – aus den Daten zu kopieren und einzufügen, mit denen sie trainiert wurden.

Bildnachweis: Tiefe Agentur

Unternehmen, die Verbreitungsmodelle kommerzialisieren, behaupten seit langem, dass „Fair Use“ sie schützt, falls ihre Systeme auf lizenzierte Inhalte trainiert wurden. (Die im US-Recht verankerte Fair-Use-Doktrin erlaubt die begrenzte Nutzung von urheberrechtlich geschütztem Material, ohne zuvor die Erlaubnis des Rechteinhabers einholen zu müssen.) Künstler behaupten jedoch, dass die Modelle ihre Rechte verletzen, teilweise weil die Trainingsdaten ohne ihre Genehmigung oder Zustimmung bezogen wurden .

„Die Legalität eines Startups wie dieses ist nicht ganz klar, aber klar ist, dass es darauf abzielt, viele Menschen arbeitslos zu machen“, sagt Mike Cook, ein KI-Ethiker und Mitglied der offenen Forschungsgruppe Knives and Paintbrushes. sagte Tech in einem E-Mail-Interview. „Es ist schwer, über die Ethik solcher Tools zu sprechen, ohne sich mit tieferen Fragen in Bezug auf Wirtschaft, Kapitalismus und Unternehmen zu befassen.“

Es gibt keinen Mechanismus für Künstler, die vermuten, dass ihre Kunst verwendet wurde, um das Modell von Deep Agency zu trainieren, um diese Kunst aus dem Trainingsdatensatz zu entfernen. Das ist noch schlimmer als Plattformen wie DeviantArt und Stability AI, die Künstlern die Möglichkeit bieten, sich gegen das Beitragen von Kunst zum Trainieren von kunstgenerierender KI zu entscheiden.

Deep Agency hat auch nicht gesagt, ob sie erwägen wird, eine Umsatzbeteiligung für Künstler und andere einzurichten, deren Arbeit zur Erstellung des Plattformmodells beigetragen hat. Andere Anbieter wie Shutterstock experimentieren damit und greifen auf einen kombinierten Pool zurück, um Schöpfer zu entschädigen, deren Arbeit zum Trainieren von KI-Kunstmodellen verwendet wird.

Cook weist auf ein weiteres Problem hin: Datenschutz.

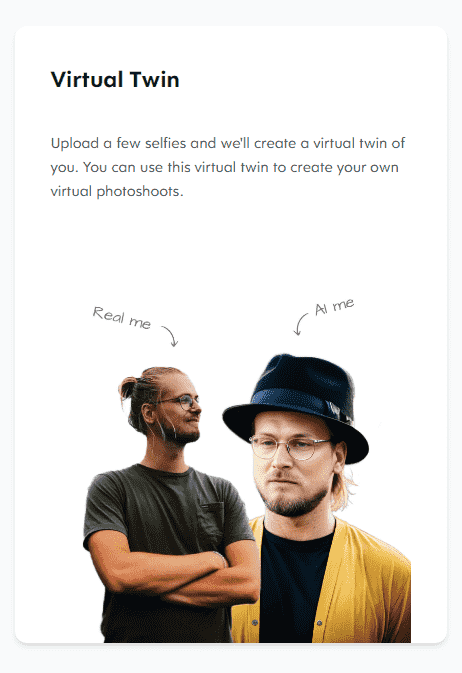

Deep Agency bietet Kunden die Möglichkeit, ein „digitales Zwillingsmodell“ zu erstellen, indem sie etwa 20 Bilder einer Person in verschiedenen Posen hochladen. Aber das Hochladen von Fotos zu Deep Agency fügt sie auch zu den Trainingsdaten für die übergeordneten Modelle der Plattform hinzu, es sei denn, die Benutzer löschen sie danach explizit, wie in den Nutzungsbedingungen beschrieben.

Die Datenschutzrichtlinie von Deep Agency sagt nicht genau aus, wie die Plattform tatsächlich mit von Benutzern hochgeladenen Fotos umgeht oder wo sie sie speichert. Und es gibt scheinbar keine Möglichkeit, abtrünnige Schauspieler daran zu hindern, ohne ihre Erlaubnis einen virtuellen Zwilling von jemandem zu erstellen – eine berechtigte Befürchtung angesichts der nicht einvernehmlichen Deepfake-Akte, für deren Erstellung Modelle wie Stable Diffusion verwendet wurden.

Bildnachweis: Tiefe Agentur

„Ihre Nutzungsbedingungen besagen tatsächlich: ‚Sie verstehen und erkennen an, dass ähnliche oder identische Generationen von anderen Personen mit ihren eigenen Eingabeaufforderungen erstellt werden können.‘ Das finde ich ziemlich amüsant, denn die Prämisse des Produkts ist, dass jeder maßgeschneiderte KI-Modelle haben kann, die jedes Mal einzigartig sind“, sagte Cook. „In Wirklichkeit erkennen sie die Möglichkeit an, dass Sie möglicherweise genau dasselbe Bild erhalten wie jemand anderes, und dass Ihre Fotos auch an andere zur potenziellen Verwendung weitergegeben werden. Ich kann mir nicht vorstellen, dass viele große Unternehmen die Aussicht auf eines dieser Dinge mögen.“

Ein weiteres Problem mit den Trainingsdaten von Deep Agency ist die mangelnde Transparenz rund um das ursprüngliche Set, sagt Keyes. Das heißt, es ist nicht klar, mit welchen Bildern das Modell, das Deep Agency antreibt, trainiert wurde (obwohl die durcheinandergebrachte Wasserzeichen in seinen Bildern Hinweise geben) – was die Möglichkeit einer algorithmischen Verzerrung offen lässt.

Eine wachsende Zahl von Forschung hat rassische, ethnische, geschlechtsspezifische und andere Formen der Stereotypisierung in der bilderzeugenden KI aufgetaucht, einschließlich im beliebten Stable Diffusion-Modell, das mit Unterstützung von Stability AI entwickelt wurde. Erst diesen Monat veröffentlichten Forscher des KI-Startups Hugging Face und der Universität Leipzig a Werkzeug Dies zeigt, dass Modelle wie Stable Diffusion und DALL-E 2 von OpenAI dazu neigen, Bilder von Menschen zu produzieren, die weiß und männlich aussehen, insbesondere wenn sie gebeten werden, Personen in Autoritätspositionen darzustellen.

Nach Laut Chloe Xiang von Vice generiert Deep Agency nur Bilder von Frauen, es sei denn, Sie kaufen ein kostenpflichtiges Abonnement – eine problematische Tendenz von Anfang an. Darüber hinaus, schreibt Xiang, neigt die Plattform dazu, etwas zu kreieren blonde weiße weibliche Models, auch wenn Sie im vorgenerierten Katalog ein Bild einer Frau einer anderen Rasse oder Ähnlichkeit auswählen. Um das Aussehen eines Modells zu ändern, müssen zusätzliche, nicht so offensichtliche Anpassungen vorgenommen werden.

„Bildgenerierende KI ist grundlegend fehlerhaft, weil sie von der Repräsentativität der Daten abhängt, auf denen die bildgenerierende KI trainiert wurde“, sagte Keyes. „Wenn es überwiegend weiße, asiatische und hellhäutige Schwarze umfasst, wird alle Synthese der Welt keine Repräsentation für dunkelhäutige Menschen bieten.“

Trotz der eklatanten Probleme mit Deep Agency sieht Cook nicht, dass es oder ähnliche Tools in absehbarer Zeit verschwinden werden. Es sei einfach zu viel Geld im Raum, sagt er – und er hat nicht Unrecht. Jenseits von Deep Agency und LaLaLand.ai sichern sich Startups wie ZMO.ai und Surreal große VC-Investitionen für Technologien, die virtuelle Models generieren, Ethik sei verdammt.

„Die Tools sind noch nicht wirklich gut genug, wie jeder sehen kann, der die Deep Agency Beta verwendet. Aber es ist nur eine Frage der Zeit“, sagte Cook. „Unternehmer und Investoren werden sich so lange gegen solche Gelegenheiten wehren, bis sie einen Weg finden, eine davon zum Laufen zu bringen.“