Auf seiner re:Invent-Konferenz am Dienstag kündigte Amazon Web Services (AWS), die Cloud-Computing-Abteilung von Amazon, eine neue Familie multimodaler generativer KI-Modelle an, die sie Nova nennt.

Insgesamt gibt es vier textgenerierende Modelle: Micro, Lite, Pro und Premier. Micro, Lite und Pro sind am Dienstag für AWS-Kunden verfügbar, während Premier Anfang 2025 eintreffen wird, sagte Amazon-CEO Andy Jassy auf der Bühne.

Darüber hinaus gibt es ein Bildgenerierungsmodell, Nova Canvas, und ein Videogenerierungsmodell, Nova Reel. Beide wurden heute Morgen auch auf AWS gestartet.

„Wir haben weiter an unseren eigenen Grenzmodellen gearbeitet“, sagte Jassy, „und diese Grenzmodelle haben in den letzten vier bis fünf Monaten enorme Fortschritte gemacht.“ Und wir dachten, wenn wir einen Wert daraus ziehen würden, würden Sie wahrscheinlich auch einen Wert daraus ziehen.“

Micro, Lite, Pro und Premier

Die textgenerierenden Nova-Modelle, die sind optimiert für 15 Sprachen (aber hauptsächlich Englisch) verfügen über sehr unterschiedliche Größen und Fähigkeiten.

Micro kann nur Text aufnehmen und ausgeben, bietet aber die geringste Latenz von allen – es verarbeitet Text am schnellsten und generiert Antworten.

Lite kann Bild-, Video- und Texteingaben einigermaßen schnell verarbeiten. Pro bietet eine ausgewogene Kombination aus Genauigkeit, Geschwindigkeit und Kosten für eine Reihe von Aufgaben. Und Premier ist am leistungsfähigsten und für komplexe Arbeitslasten konzipiert.

Pro und Premier können wie Lite Text, Bilder und Videos analysieren. Alle drei eignen sich gut für Aufgaben wie das Verdauen von Dokumenten und das Zusammenfassen von Diagrammen, Besprechungen und Diagrammen. AWS positioniert Premier jedoch eher als „Lehrer“-Modell für die Erstellung abgestimmter benutzerdefinierter Modelle und nicht als alleiniges Modell.

Micro verfügt über ein Kontextfenster mit 128.000 Token, was bedeutet, dass es bis zu etwa 100.000 Wörter verarbeiten kann. Lite und Pro verfügen über Kontextfenster mit 300.000 Token, was etwa 225.000 Wörtern, 15.000 Zeilen Computercode oder 30 Minuten Filmmaterial entspricht.

Anfang 2025 werden die Kontextfenster bestimmter Nova-Modelle erweitert, um über 2 Millionen Token zu unterstützen, sagt AWS.

Jassy behauptet, dass die Nova-Modelle zu den schnellsten ihrer Klasse gehören – und zu den kostengünstigsten im Betrieb. Sie sind in AWS Bedrock, der KI-Entwicklungsplattform von Amazon, verfügbar, wo sie auf Text, Bilder und Videos abgestimmt und für eine verbesserte Geschwindigkeit und höhere Effizienz destilliert werden können.

„Wir haben diese Modelle für die Zusammenarbeit mit proprietären Systemen und APIs optimiert, sodass Sie mit diesen Modellen viel einfacher mehrere orchestrierte automatische Schritte – Agentenverhalten – durchführen können“, fügte Jassy hinzu. „Deshalb finde ich diese sehr überzeugend.“

Leinwand und Rolle

Canvas und Reel sind AWS‘ bisher stärkstes Spiel für generative Medien.

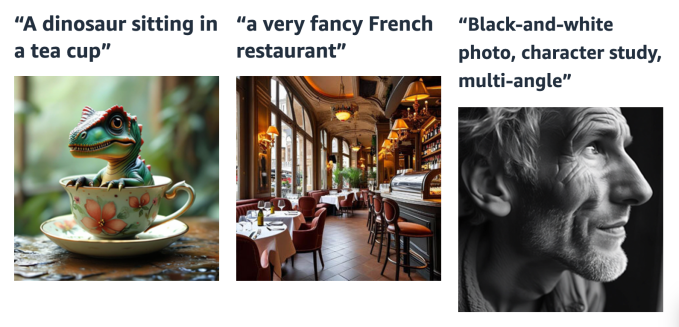

Mit Canvas können Benutzer Bilder anhand von Eingabeaufforderungen erstellen und bearbeiten (z. B. zum Entfernen von Hintergründen) und bietet Steuerelemente für die Farbschemata und Layouts der generierten Bilder. Reel, das ambitioniertere der beiden Modelle, erstellt aus Eingabeaufforderungen oder optional Referenzbildern Videos mit einer Länge von bis zu sechs Sekunden. Mit Reel können Benutzer die Kamerabewegung anpassen, um Videos mit Schwenks, 360-Grad-Drehungen und Zoom zu erstellen.

Reel ist derzeit auf sechs Sekunden lange Videos beschränkt (deren Generierung etwa drei Minuten dauert), aber eine Version, die zwei Minuten lange Videos erstellen kann, ist laut AWS „bald verfügbar“.

Hier ist ein Beispiel:

Und noch eins:

Und hier sind Bilder von Canvas:

Jassy betonte, dass sowohl Canvas als auch Reel über „integrierte“ Kontrollen für eine verantwortungsvolle Nutzung verfügen, einschließlich Wasserzeichen und Inhaltsmoderation. „[We’re trying] um die Erzeugung schädlicher Inhalte zu begrenzen“, sagte er.

AWS hat die Schutzmaßnahmen in a erweitert BlogbeitragEr sagt, dass Nova „sich ausdehnt [its] Sicherheitsmaßnahmen zur Bekämpfung der Verbreitung von Fehlinformationen, Material über sexuellen Missbrauch von Kindern sowie chemischen, biologischen, radiologischen oder nuklearen Risiken.“ Es ist jedoch nicht klar, was dies in der Praxis bedeutet – oder welche Formen diese Maßnahmen annehmen.

Auch darüber, welche Daten genau zum Trainieren aller generativen Modelle verwendet werden, bleibt AWS weiterhin unklar. Das Unternehmen teilte Tech zuvor lediglich mit, dass es sich um eine Kombination aus proprietären und lizenzierten Daten handele.

Nur wenige Anbieter geben solche Informationen bereitwillig preis. Sie betrachten Trainingsdaten als Wettbewerbsvorteil und halten diese – und die damit verbundenen Informationen – daher streng geheim. Trainingsdatendetails sind auch eine potenzielle Quelle für Klagen im Zusammenhang mit geistigem Eigentum, ein weiterer Anreiz, viel preiszugeben.

Anstelle von Transparenz bietet AWS eine Entschädigungsrichtlinie an, die Kunden für den Fall abdeckt, dass eines seiner Modelle ein möglicherweise urheberrechtlich geschütztes Standbild wieder ausspuckt (d. h. eine Spiegelkopie davon ausspuckt).

Was kommt also als nächstes für Nova? Laut Jassy arbeitet AWS für das erste Quartal 2025 an einem Speech-to-Speech-Modell – einem Modell, das Sprache aufnimmt und eine transformierte Version davon ausgibt – und für etwa Mitte 2025 an einem „Any-to-Any“-Modell .

Das Speech-to-Speech-Modell wird laut Amazon auch in der Lage sein, verbale und nonverbale Hinweise wie Ton und Kadenz zu interpretieren und natürliche, „menschenähnliche“ Stimmen zu liefern. Was das Any-to-Any-Modell betrifft, so wird es theoretisch Anwendungen von Übersetzern über Inhaltseditoren bis hin zu KI-Assistenten unterstützen.

Das setzt natürlich voraus, dass es keine Rückschläge erleidet.

„Sie können Text, Sprache, Bilder oder Videos eingeben und Text, Sprache, Bilder oder Videos ausgeben“, sagte Jassy über das Any-to-Any-Modell. „Das ist die Zukunft, in der Grenzmodelle gebaut und konsumiert werden.“