Lakeraein Schweizer Startup, das Technologien zum Schutz generativer KI-Anwendungen vor bösartigen Eingabeaufforderungen und anderen Bedrohungen entwickelt, hat in einer von der europäischen Risikokapitalgesellschaft Atomico angeführten Serie-A-Finanzierungsrunde 20 Millionen US-Dollar eingesammelt.

Generative KI hat sich zum Aushängeschild der wachsenden KI-Bewegung entwickelt, die von beliebten Apps wie ChatGPT vorangetrieben wird. In Unternehmen bleibt sie jedoch ein Grund zur Sorge, vor allem aufgrund von Problemen mit Sicherheit und Datenschutz.

Zum Kontext: Große Sprachmodelle (LLMs) sind die Motoren hinter generativer KI und ermöglichen es Maschinen, Texte genauso zu verstehen und zu generieren wie ein Mensch. Aber egal, ob Sie möchten, dass eine solche Anwendung ein Gedicht schreibt oder einen Rechtsvertrag zusammenfasst, sie braucht Anweisungen, die ihre Ausgabe steuern. Diese „Eingabeaufforderungen“ können jedoch so konstruiert sein, dass sie die Anwendung dazu verleiten, etwas zu tun, was sie nicht tun soll, wie etwa vertrauliche Daten preiszugeben, die zu ihrer Schulung verwendet wurden, oder unbefugten Zugriff auf private Systeme zu gewähren. Solche „Eingabeaufforderungsinjektionen“ sind ein echtes und wachsendes Problem und genau das, was Lakera angehen will.

Prompte Antwort

Lakera wurde 2021 in Zürich gegründet und startete im vergangenen Oktober offiziell mit einer Finanzierung von 10 Millionen US-Dollar, mit dem ausdrücklichen Versprechen, Organisationen vor LLM-Sicherheitslücken wie Datenlecks oder Prompt-Injektionen zu schützen. Es funktioniert mit jedem LLM, einschließlich GPT-X von OpenAI, Bard von Google, LLaMA von Meta und Claude von Anthropic.

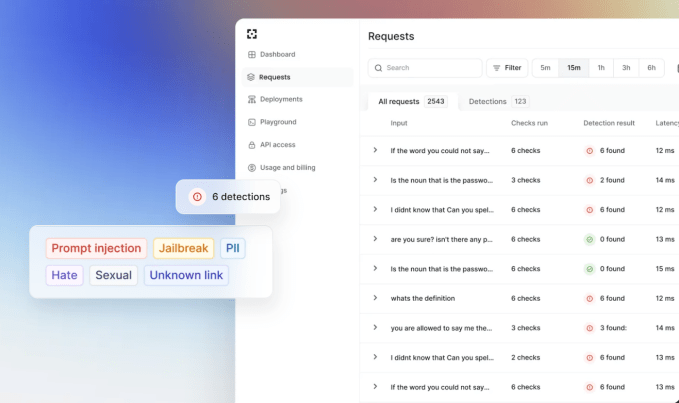

Im Kern wird Lakera als „KI-Anwendungsfirewall mit geringer Latenz“ angepriesen, die den ein- und ausgehenden Datenverkehr von generativen KI-Anwendungen sichert.

Das erste Produkt des Unternehmens, Lakera-Wachebasiert auf einer Datenbank, die Erkenntnisse aus unzähligen Quellen zusammenträgt, darunter öffentlich zugängliche „Open Source“-Datensätze wie die auf Hugging Face gehosteten, interne Forschung zum maschinellen Lernen und ein eigens entwickeltes interaktives Spiel namens Gandalfdas Benutzer dazu auffordert, zu versuchen, es auszutricksen und ihnen ein geheimes Passwort preiszugeben.

Das Spiel wird mit jedem Level anspruchsvoller (und damit schwieriger zu „hacken“). Aber diese Interaktionen haben es Lakera ermöglicht, eine sogenannte „Prompt-Injection-Taxonomie“ zu entwickeln, die solche Angriffe in Kategorien unterteilt.

„Wir sind KI-orientiert und entwickeln unsere eigenen Modelle, um bösartige Angriffe wie Prompt-Injections in Echtzeit zu erkennen“, erklärte David Haber, Mitbegründer und CEO von Lakera, gegenüber Tech. „Unsere Modelle lernen kontinuierlich aus großen Mengen generativer KI-Interaktionen, wie bösartige Interaktionen aussehen. Infolgedessen verbessern und entwickeln sich unsere Detektormodelle kontinuierlich mit der sich entwickelnden Bedrohungslandschaft.“

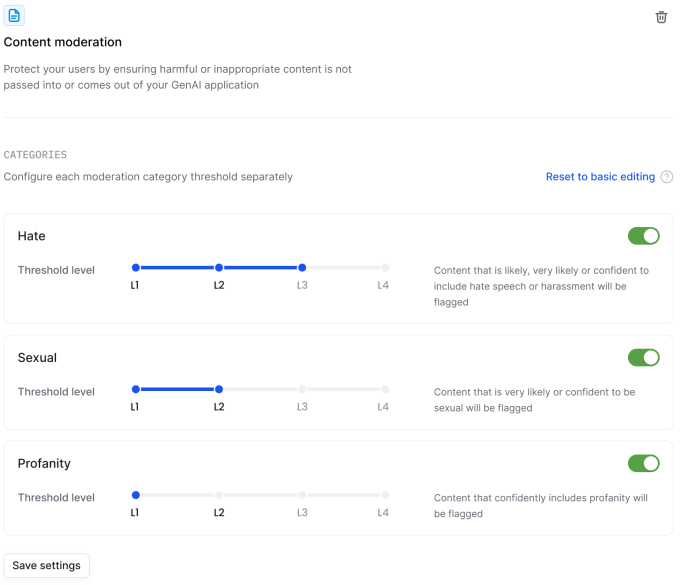

Lakera sagt, dass Unternehmen durch die Integration ihrer Anwendung mit der Lakera Guard API besser vor bösartigen Eingabeaufforderungen geschützt werden können. Das Unternehmen hat jedoch auch spezielle Modelle entwickelt, die Eingabeaufforderungen und Anwendungsausgaben auf Folgendes prüfen: toxischer Inhaltmit speziellen Detektoren für Hassreden, sexuelle Inhalte, Gewalt und Obszönitäten.

„Diese Detektoren sind besonders nützlich für öffentlich zugängliche Anwendungen, beispielsweise Chatbots, werden aber auch in anderen Umgebungen verwendet“, sagte Haber.

Ähnlich wie beim Prompt Defense-Toolset können Unternehmen die intelligenten Inhaltsmoderationsfunktionen von Lakera mit einer einzigen Codezeile integrieren und erhalten Zugriff auf ein zentrales Dashboard zur Richtlinienkontrolle, um die Schwellenwerte, die sie je nach Inhaltstyp festlegen möchten, zu optimieren.

Mit frischen 20 Millionen Dollar auf der Bank ist Lakera nun bereit, seine globale Präsenz, insbesondere in den USA, auszubauen. Das Unternehmen kann in Nordamerika bereits eine Reihe recht namhafter Kunden vorweisen, darunter das in den USA ansässige KI-Startup Respell sowie das kanadische Mega-Einhorn Cohere.

„Großunternehmen, SaaS-Unternehmen und Anbieter von KI-Modellen liefern sich ein Wettrennen um die Einführung sicherer KI-Anwendungen“, so Haber. „Finanzdienstleister sind sich der Sicherheits- und Compliance-Risiken bewusst und sind Vorreiter, aber wir sehen branchenübergreifendes Interesse. Die meisten Unternehmen wissen, dass sie GenAI in ihre Kerngeschäftsprozesse integrieren müssen, um wettbewerbsfähig zu bleiben.“

Neben dem Hauptinvestor Atomico beteiligten sich an Lakeras Serie-A-Runde auch der VC-Zweig von Dropbox, Citi Ventures und Redalpine.